Nell’era dell’informazione senza confini, la democratizzazione del contenuto attraverso Internet ha rappresentato una rivoluzione epocale, ma ha anche aperto le porte a un problema complesso e insidioso: la disinformazione. Chiunque, con un dispositivo connesso, può creare e diffondere contenuti istantaneamente. Blog, post sui social media e video si propagano a velocità mai viste prima, alimentati da algoritmi che privilegiano la viralità e che, spesso, amplificano titoli sensazionalistici, affermazioni scioccanti e storie emozionalmente cariche.

Questo panorama, già di per sé saturo di informazioni spesso in conflitto tra loro, è stato ulteriormente complicato dall’avvento dell’intelligenza artificiale generativa. Gli stessi sistemi di IA che generano articoli, post, video e immagini possono ingannare gli occhi di un utente medio con contenuti convincenti ma falsi. Il risultato è un pericolo concreto per il dibattito pubblico, la stabilità politica e sociale e la capacità collettiva di distinguere i fatti dalle falsità.

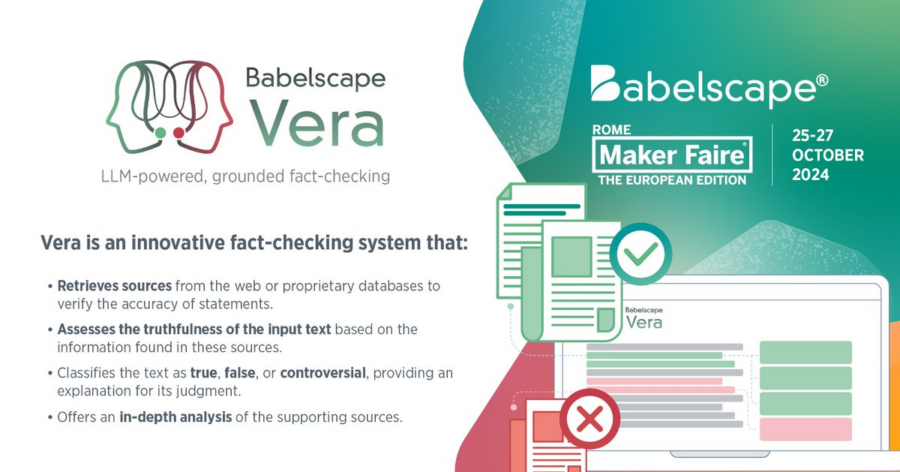

In questo contesto critico, Babelscape presenta Vera, una piattaforma di fact-checking che rappresenta un passo avanti rivoluzionario. Alimentata da modelli linguistici di ampia scala (LLM) e supportata da fonti reali, Vera non si limita a identificare il vero dal falso; essa agisce come un arbitro neutrale e potente in un mare di contenuti incerti.