Microsoft è il principale fornitore di cloud pubblico pronto a trarre vantaggio dalla crescita dell’intelligenza artificiale (IA). Non perché il loro cloud generi grandi profitti, ma perché l’ecosistema di Microsoft, oltre al cloud, può sfruttare l’IA per guadagnare. Ad esempio, GitHub Copilot e l’assistenza Copilot sono servizi a pagamento che rappresentano fonti di guadagno nel breve e medio termine.

Tag: microsoft Pagina 3 di 4

Secondo Reuters, Microsoft si trova sotto i riflettori per i suoi costi, mentre cresce la preoccupazione per il lento ritorno sugli investimenti nell’intelligenza artificiale (AI).

Un’importante interruzione di servizio di Microsoft ha causato la comparsa della “schermata blu della morte” su diversi sistemi Windows, impedendo agli utenti di tutto il mondo di accedere ai servizi di Microsoft 365.

L’interruzione è stata provocata da un problema tecnico in un aggiornamento della piattaforma di sicurezza informatica Falcon Sensor di CrowdStrike. Microsoft ha dichiarato di aver risolto il problema durante la notte. Microsoft ha comunicato su X, che “tutte le app e i servizi di Microsoft 365 precedentemente interessati sono stati ripristinati”.

Microsoft ha risolto la maggior parte delle interruzioni dei suoi servizi cloud nella regione degli Stati Uniti centrali, che sono iniziate giovedì alle 18:00 ET. Tuttavia, un piccolo numero di servizi sta ancora registrando effetti residui.

“Un flusso di lavoro di gestione del cluster back-end ha implementato una modifica alla configurazione che ha causato il blocco dell’accesso back-end tra un sottoinsieme di cluster di Azure Storage e le risorse di elaborazione nella regione”,

ha comunicato Microsoft .

Secondo il Financial Times, mercoledì Microsoft ha rinunciato al suo ruolo di osservatore nel consiglio di amministrazione di OpenAI, mentre Apple non assumerà una posizione simile.

Secondo Morgan Stanley, Microsoft prevede di quasi raddoppiare le spese in conto capitale, passando da 32 miliardi di dollari nel 2023 a 63 miliardi di dollari nel 2025. Gran parte di questo nuovo CAPEX sarà destinato all’intelligenza artificiale generativa. Tuttavia, alcuni investitori si chiedono quale sarà il ritorno su questo investimento. Morgan Stanley prevede che la spesa per la capacità dei data center aumenterà da 16 a 23 miliardi per supportare l’espansione dei flussi di entrate GenAI da Azure AI Services, M365 Copilot e GitHub Copilot.

L’investimento di 1,5 miliardi di dollari di Microsoft nella società di intelligenza artificiale G42 con sede negli Emirati Arabi Uniti è considerato “generalmente positivo” in quanto indebolisce i legami tra Medio Oriente e Cina, ha affermato lunedì la Casa Bianca.

Il presidente giapponese di Microsoft, Miki Tsusaka, ha dichiarato che il Giappone è tra i più veloci nell’adottare strumenti di intelligenza artificiale e ha il potenziale per rilanciare la propria economia e il settore tecnologico, secondo Bloomberg News. Tsusaka ha affermato che il paese ha recuperato il ritardo iniziale. “I giapponesi hanno recuperato. Credo che continueranno ad accelerare perché la tecnologia permette cose che prima non potevamo fare,” ha detto Tsusaka in un’intervista, Bloomberg.

Microsoft non rilascerà la nuova funzionalità di intelligenza artificiale “Recall” per Windows sui nuovi PC la prossima settimana. Invece, sarà disponibile solo per un’anteprima con un gruppo ristretto per ragioni di privacy.

Il Dipartimento di Giustizia degli Stati Uniti e la Federal Trade Commission (FTC) avvieranno indagini antitrust su Microsoft, OpenAI e Nvidia nel campo dell’intelligenza artificiale.

Giovedì è stato riportato che la FTC esaminerà la condotta di OpenAI e la collaborazione di Microsoft, che ha investito 13 miliardi di dollari in OpenAI e detiene una partecipazione del 49%.

La nuova linea di PC Microsoft Windows Copilot+ con intelligenza artificiale include Recall, che cattura schermate casuali delle attività dell’utente per recuperare dati persi. Subito sono emerse preoccupazioni su Recall che potrebbe catturare password e informazioni sensibili.

Dopo settimane di critiche, Microsoft ha annunciato venerdì che imporrà limiti più rigidi alla funzione “Recall” basata sull’intelligenza artificiale, presentata alla sua conferenza annuale degli sviluppatori a maggio.

“La crescita esplosiva dell’intelligenza artificiale generativa è sulla buona strada per sbloccare trilioni di valore economico, ma il suo destino dipende dalla risoluzione di una crescente crisi informatica ed energetica”,

CEO Segal Touchcast

Touchcast è un’applicazione di comunicazione video in realtà mista completamente integrata con Microsoft Teams. Touchcast mette in contatto persone da tutto il mondo attraverso esperienze coinvolgenti autentiche e stimolanti.

Microsoft ha investito nella Touchcast di New York, una startup che memorizza le query comuni di intelligenza artificiale generativa e sta raccogliendo 100 milioni di dollari dai finanziatori, secondo Bloomberg. Gli sforzi di Touchcast per archiviare le domande frequenti sull’intelligenza artificiale migliorano l’efficienza riducendo la potenza e l’energia necessarie ai modelli per rispondere, afferma il rapporto. Accenture plc è un altro importante sostenitore di Touchcast, che ora ha una valutazione di 350 milioni di dollari, secondo il CEO di Touchcast Edo Segal. Touchcast distribuisce le query archiviate nei data center cloud di Microsoft Azure. Gli alti costi di energia e potenza di calcolo per fornire risposte di base all’intelligenza artificiale sono ben documentati.

Microsoft e Hitachi hanno avviato una collaborazione di tre anni per promuovere l’uso dell’intelligenza artificiale generativa.

La società di Tokyo ha dichiarato che questa partnership farà crescere la sua attività Lumada, con un fatturato previsto di 2,65 trilioni di yen (18,9 miliardi di dollari) nel 2024, migliorando anche l’efficienza e la produttività per i 270.000 dipendenti di Hitachi.

REDMOND, Wash. Microsoft Corp. e LinkedIn hanno rilasciato il 2024 Work Trend Index, un rapporto congiunto sullo stato dell’IA nel mondo del lavoro intitolato “L’IA al lavoro è qui. Ora arriva la parte difficile.”

La ricerca, basata su un sondaggio condotto su 31.000 persone in 31 paesi, sulle tendenze del lavoro e delle assunzioni su LinkedIn, su trilioni di segnali di produttività di Microsoft 365 e su studi con clienti Fortune 500, mostra come, in appena un anno, l’IA stia influenzando il modo in cui le persone lavorano, guidano e assumono in tutto il mondo.

Onestamente in Rivista.AI ci aspettavamo questa reazione.

Il vicepresidente e presidente di Microsoft Brad Smith, ha affermato che l’accordo dell’azienda con la società di intelligenza artificiale G42, sostenuta dagli Emirati Arabi Uniti, potrebbe alla fine portare al trasferimento di chip e apparecchiature avanzati, una misura che un anziano membro del Congresso repubblicano ha osservato potrebbe avere problemi di sicurezza nazionale, ha riferito la Reuters.

Microsoft e la società di intelligenza artificiale G42 con sede negli Emirati Arabi Uniti (a cui Rivista.AI ha dedicato un articolo) prevedono di investire almeno 1 miliardo di dollari per costruire un data center in Kenya.

Microsoft ha affermato che si tratta del più grande investimento digitale del settore privato mai realizzato nella storia della nazione. G42 costruirà il data center per eseguire Microsoft Azure nella sua nuova regione cloud dell’Africa orientale.

Satya Nadella, CEO di Microsoft, ha dichiarato che l’obiettivo principale dell’intelligenza artificiale è migliorare l’accessibilità, durante il suo discorso inaugurale su Build 2024 martedì scorso. Il gigante della tecnologia sembra aver fatto un passo significativo verso questo traguardo con l’annuncio di GitHub Copilot Workspace, uno strumento che permetterà a chiunque, anche con una conoscenza minima o nulla dei linguaggi di programmazione, di creare il proprio software.

Microsoft ha fatto diverse rivelazioni lunedì, incluso quello che il CEO Satya Nadella ha definito “il PC più veloce e pronto per l’intelligenza artificiale mai costruito”.

Durante un evento riservato alla stampa, Nadella ha affermato che i nuovi computer si chiamano Copilot Plus PC. I relativi chip sono sviluppati da Qualcomm, AMD e Intel.

La conferenza Build 2024 inizia martedì con un keynote a mezzogiorno EDT martedì. Dura fino a giovedì. La registrazione è disponibile qui .

Microsoft prende la scena alla conferenza degli sviluppatori Build 2024 a Seattle questa settimana, seguendo la presentazione delle ultime innovazioni basate su Gemini di Google la scorsa settimana. Anche OpenAI ha fatto notizia la scorsa settimana, svelando GPT-4 e introducendo nuove funzionalità di intelligenza artificiale per utenti e sviluppatori.

La Francia è riuscita ad ottenere la cifra record di 15 miliardi di euro di investimenti nell’ambito del suo programma “Choose France”, l’iniziativa che punta a promuovere gli investimenti esteri nel Paese. Ad annunciarlo è stato lo stesso presidente Emmanuel Macron che ha sottolineato il successo dell’edizione 2024 dell’iniziativa che si è chiusa registrando ben 56 progetti di investimento, concentrati su Intelligenza Artificiale, ricerca, innovazione e decarbonizzazione.

Microsoft ha annunciato giovedì che intende offrire ai clienti del suo servizio di cloud computing una piattaforma di chip AI sviluppata da Advanced Micro Devices (AMD), in competizione con i prodotti Nvidia, secondo quanto riportato da Reuters.

I dettagli saranno rivelati durante la conferenza degli sviluppatori Build la prossima settimana. In occasione dell’evento, l’azienda presenterà anche un’anteprima dei nuovi processori personalizzati Cobalt 100, secondo quanto riportato.

I cluster di chip AI MI300X di AMD saranno disponibili attraverso il servizio cloud Azure di Microsoft, offrendo un’alternativa alla linea di GPU H100 di Nvidia, molto richiesta e dominante nel mercato dei chip per data center per l’intelligenza artificiale.

AMD prevede entrate per circa 4 miliardi di dollari dai chip AI nel 2024 e ha sottolineato che i chip sono altamente efficaci per addestrare ed eseguire modelli IA di grandi dimensioni.

Microsoft, inoltre, vende l’accesso ai suoi chip AI autoprodotti chiamati Maia. Separatamente, Microsoft ha dichiarato che i processori Cobalt 100, che saranno presentati in anteprima la prossima settimana, offrono prestazioni superiori del 40% rispetto ad altri processori basati sulla tecnologia Arm.

Secondo il rapporto, aziende come Snowflake hanno già iniziato a utilizzarli. Microsoft aveva annunciato i chip Cobalt a novembre e attualmente sono in fase di valutazione per potenziare il servizio di messaggistica Teams. Questi chip competono anche con le CPU Graviton di Amazon.com.

Microsoft potrebbe essere sanzionata dalla Commissione Europea se non fornirà le informazioni richieste entro il 27 maggio sui rischi legati alle funzionalità di intelligenza artificiale generativa nel motore di ricerca Bing, riporta Reuters.

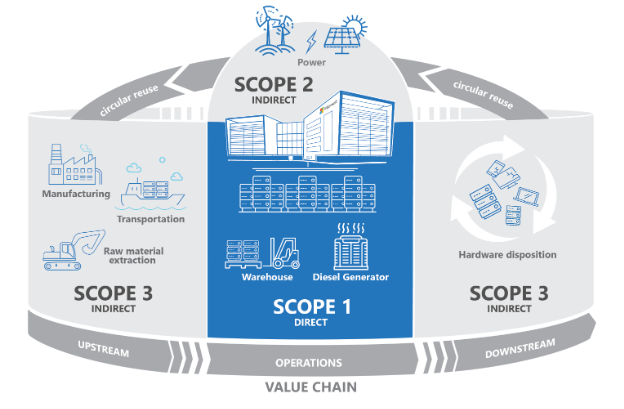

Microsoft ha registrato un aumento del 29,1% nelle emissioni di carbonio totali dal 2020, principalmente a causa della costruzione di data center per supportare le esigenze crescenti di intelligenza artificiale.

Le emissioni Scope 1 e 2 dell’azienda, che includono le emissioni dirette e indirette legate all’energia consumata, sono diminuite del 6,3% nel 2023 rispetto al 2020.

Tuttavia, le emissioni Scope 3, che derivano da attività indirette come la costruzione di data center e l’uso di materiali hardware, sono aumentate del 30,9% nello stesso periodo.

Microsoft ha annunciato un significativo investimento di 4 miliardi di euro per la costruzione di infrastrutture cloud e AI in Francia, compresa la creazione di un data center nella città di Mulhouse. Questo annuncio è stato fatto alla vigilia del Summit Choose France, un evento volto ad attirare investitori stranieri nel Paese.

ServiceNow ha annunciato mercoledì nuove collaborazioni nel campo dell’intelligenza artificiale generativa con Microsoft e IBM alla conferenza Knowledge 2024 a Las Vegas.

ServiceNow sta incorporando watsonx di IBM nella sua piattaforma Now, così come watsonx.ai di IBM e modelli linguistici di grandi dimensioni di IBM Granite Foundation nel suo Now Assist GenAI.

“La Now Platform aiuta i clienti a implementare il LLM che meglio si adatta alle loro esigenze specifiche, e l’integrazione dei modelli Watsonx aiuterà i clienti a creare esperienze più intuitive, efficienti e senza soluzione di continuità”,

CJ Desai, COO ServiceNow

La disponibilità del nuovo servizio integrato è prevista giovedì 9 maggio.

ServiceNow ha inoltre annunciato un’alleanza ampliata con Microsoft, combinando Now Assist con Copilot.

La combinazione di ServiceNow e degli assistenti AI di Microsoft ha lo scopo di migliorare la produttività, poiché Copilot sarà in grado di inviare richieste dei dipendenti a Now Assist in Microsoft Teams.

“Che si tratti di richiedere o risolvere il problema di supporto di un cliente, o anche di connettersi a un agente dal vivo per ricevere supporto su un problema complesso, Now Assist fornirà ai dipendenti risposte alle domande e consiglierà azioni e passaggi successivi in modo colloquiale”

Le aziende stanno inoltre creando funzionalità aggiuntive, come consentire ai dipendenti di coinvolgere un Copilot di ServiceNow per la creazione di documenti in PowerPoint o altre applicazioni Microsoft 365.

“La perfetta integrazione dei nostri assistenti basati sull’intelligenza artificiale aiuterà a introdurre livelli migliori di produttività dei dipendenti e dell’IT, a ridurre il cambio di contesto e a garantire un’esecuzione più semplice delle attività lavorative quotidiane, aggiungendo valore agli investimenti tecnologici dei nostri clienti”,

Rajesh Jha, vicepresidente esecutivo di esperienze e dispositivi presso Microsoft.

ServiceNow fornisce una piattaforma basata su cloud per la gestione aziendale e IT.

Microsoft ha sviluppato un avanzato modello di intelligenza artificiale generativa esclusivamente per le agenzie di intelligence degli Stati Uniti, progettato per operare completamente offline, garantendo l’utilizzo sicuro nella gestione di informazioni riservate, come segnalato da Bloomberg News. Questo rappresenta un’innovazione senza precedenti: per la prima volta, un grande modello linguistico, noto come LLM, funziona in totale assenza di connessione internet, ha dichiarato un alto dirigente di Microsoft, come evidenziato nel report.

Contrariamente alla maggior parte dei modelli di intelligenza artificiale, che si basano su servizi cloud per elaborare e apprendere dai dati – come il noto ChatGPT di OpenAI, nel quale Microsoft ha investito miliardi – l’azienda ha inteso offrire un sistema di sicurezza elevata alle agenzie governative.

Per raggiungere questo scopo, Microsoft ha attivato un modello basato su GPT-4 all’interno di un ambiente cloud “air-gapped”, isolato da qualsiasi connessione Internet, come spiegato da William Chappell, chief technology officer di Microsoft per le missioni strategiche e la tecnologia. Tecnica informatica solitamente utilizzata per mettere in sicurezza sistemi o reti che richiedono maggior attenzione rispetto ad altre: basti pensare alle reti classificate come militari, ai sistemi di controllo di grande aziende e industrie sensibili o network che gestiscono e processano pagamenti attraverso carte di credito e bancomat.

Il gigante dell’informatica ha dedicato gli ultimi diciotto mesi al perfezionamento del suo sistema, incluso l’aggiornamento di un supercomputer per l’intelligenza artificiale situato in Iowa.

Il modello GPT-4, implementato nel cloud air-gapped, è di tipo statico, ovvero è in grado di processare i file ma non di apprendere da essi o dalla rete internet. Chappell ha ipotizzato che potenzialmente fino a 10.000 individui potrebbero utilizzare questa intelligenza artificiale.

Il servizio è stato inaugurato giovedì scorso e sarà soggetto a una serie di test e procedure di accreditamento da parte delle agenzie di intelligence, come ulteriormente dettagliato nel rapporto.

Microsoft staattualmente lavorando su un nuovo modello interno di intelligenza artificiale, noto come MAI-1, che è progettato per competere con i modelli di intelligenza artificiale creati da Google, OpenAI, Anthropic e altri.

Questo progetto è guidato da Mustafa Suleyman, che è stato assunto da Microsoft a marzo per aiutare a gestire la sua nuova unità di intelligenza artificiale consumer.

Suleyman ha precedentemente fondato DeepMind, che è stata acquistata da Google, e più recentemente è stato CEO della startup AI Inflection.

AI.Inflection ha raccolto finanziamenti da Microsoft nel giugno 2023 prima che il colosso tecnologico assumesse la maggior parte del suo personale e pagasse 650 milioni di dollari per i diritti sulla proprietà intellettuale a marzo.

Il modello MAI-1 è previsto essere “molto più grande” degli altri modelli open source addestrati da Microsoft, con circa 500 miliardi di parametri, come riferito da The Information, citando persone che hanno familiarità con la questione.

Questo è in contrasto con i parametri del modello GPT-4 di OpenAI, che ha più di 1T di parametri, secondo Hacker News. Il modello Llama 3 di Meta Platforms ha circa 70 miliardi di parametri, come affermato recentemente dalla società. Google non ha rivelato pubblicamente quanti parametri ha il suo modello Gemini, ma alcune stime collocano la versione di fascia alta del modello, Ultra, a parametri 175T.

Si ritiene che Microsoft potrebbe svelare un’anteprima del nuovo modello alla conferenza degli sviluppatori Build alla fine di questo mese, come aggiunto dal notiziario.

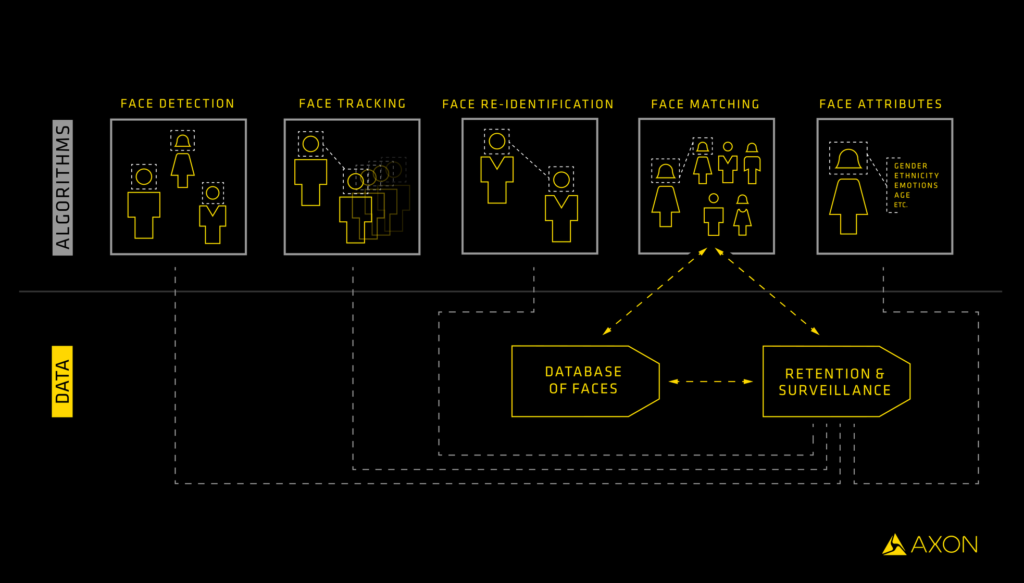

Microsoft ha riaffermato il divieto ai dipartimenti di polizia statunitensi di utilizzare l’intelligenza artificiale generativa per il riconoscimento facciale attraverso il servizio Azure OpenAI, Non si tratta di un divieto generale per i dipartimenti di polizia di utilizzare il servizio.

Mercoledì scorso, i termini di servizio per Azure OpenAI di Microsoft sono stati aggiornati per vietare più chiaramente l’uso del servizio “da o per” i dipartimenti di polizia negli Stati Uniti per il riconoscimento facciale, incluso l’uso con l’attuale e futura analisi delle immagini di OpenAI Models. Inoltre, è stato aggiunto un nuovo punto che vieta l’uso della tecnologia di riconoscimento facciale in tempo reale sulle telecamere mobili, come le body cam e le dashcam, per tentare di identificare una persona in ambienti non controllati.

Questi cambiamenti arrivano dopo che Axon, produttore di prodotti tecnologici e di armi per militari e forze dell’ordine, ha annunciato un nuovo prodotto che utilizza il modello di testo generativo GPT-4 di OpenAI per riassumere l’audio dalle telecamere del corpo. Tuttavia, non è chiaro se Axon utilizzi GPT-4 tramite il servizio Azure OpenAI e se la politica aggiornata sia una risposta al lancio del prodotto Axon.

I nuovi termini lasciano ancora spazio a Microsoft, poiché il divieto totale di utilizzo del servizio Azure OpenAI riguarda solo la polizia statunitense e non quella internazionale. Inoltre, non copre il riconoscimento facciale effettuato con telecamere fisse in ambienti controllati, come un back office.

Questo approccio è in linea con quello recente di Microsoft e del suo stretto partner OpenAI nei confronti delle forze dell’ordine e dei contratti di difesa legati all’intelligenza artificiale. Ad esempio, OpenAI sta lavorando con il Pentagono Darpa su una serie di progetti che includono capacità di sicurezza informatica, mentre Microsoft ha lanciato l’utilizzo dello strumento di generazione di immagini di OpenAI, DALL-E, per aiutare il Dipartimento della Difesa a creare software per eseguire operazioni militari.

Azure OpenAI è ora disponibile nel prodotto Azure Government di Microsoft, aggiungendo ulteriori funzionalità di conformità e gestione rivolte agli enti governativi, comprese le forze dell’ordine. Candice Ling, vicepresidente senior della divisione governativa di Microsoft, Microsoft Federal, ha promesso che il servizio Azure OpenAI sarà “inviato per un’ulteriore autorizzazione” al Dipartimento della Difesa per i carichi di lavoro che supportano le missioni del Dipartimento.

Microsoft ha deciso di investire e collaborare con OpenAI, potenzialmente a causa della sensazione di restare indietro rispetto a Google di Alphabet ha riferito Bloomberg News, citando un’e-mail interna rilasciata nell’ambito del progetto del Dipartimento di Giustizia degli Stati Uniti caso antitrust contro Google.

Kevin Scott, Chief Technology Officer di Microsoft, era preoccupato quando ha esaminato i “divari di capacità” di formazione del modello di intelligenza artificiale tra Google e Microsoft, secondo un’e -mail di giugno 2019 che ha scritto al CEO Satya Nadella e al co-fondatore Bill Gates.

Lo scambio suggerisce che il dirigente ha riconosciuto in privato che mancavano l’infrastruttura e la velocità di sviluppo per raggiungere OpenAI –il creatore del chatbot ChatGPT e DeepMind di Google.

Scott ha scritto nell’e-mail: “siamo diversi anni indietro rispetto alla concorrenza in termini di scala ML [machine learning]”.

Nadella aveva approvato l’e-mail di Scott e l’aveva anche inoltrata al direttore finanziario Amy Hood, dicendo “un’ottima e-mail che spiega perché voglio che lo facciamo… e anche perché poi garantiremo che i nostri addetti all’infrastruttura vengano eseguiti”.

L’e-mail è stata pubblicata martedì scorso dopo che i media, tra cui il New York Times e Bloomberg, sono intervenuti nel caso antitrust e hanno chiesto un maggiore accesso pubblico, osserva il rapporto .

Il Dipartimento di Giustizia degli Stati Uniti aveva notato che ChatGPT di OpenAI e altre innovazioni avrebbero potuto essere rilasciate anni fa se Google non avesse monopolizzato il mercato della ricerca, aggiunge il rapporto.

La settimana scorsa, il giudice Amit Mehta ha ordinato alle società di fornire una versione redatta, poiché le informazioni “fanno luce sulla difesa di Google riguardo agli investimenti relativi di Google e Microsoft nella ricerca”, osserva il rapporto.

Giovedì e venerdì, Google e il Dipartimento di Giustizia dovrebbero presentare le argomentazioni conclusive del caso. Secondo il rapporto, si prevede che il giudice Mehta prenderà una decisione entro la fine dell’anno.

Brookfield Asset Management ha dichiarato mercoledì che svilupperà per Microsoftpiù di 10,5 GW di nuova capacità di energia rinnovabile , quasi 8 volte più grande del più grande accordo di acquisto di energia aziendale mai firmato; i termini finanziari non sono stati resi noti.

Brookfield ha affermato che il “primo accordo quadro globale nel suo genere” della durata di cinque anni, a partire dal 2026 negli Stati Uniti e in Europa, accelererà l’espansione della capacità di energia rinnovabile per contribuire agli obiettivi di sostenibilità di Microsoft con il potenziale per fornire ulteriore capacità rinnovabile agli Stati Uniti e all’Europa, nonché all’Asia-Pacifico, all’India e all’America Latina.

Le società non hanno rivelato i termini finanziari dell’accordo, ma il Financial Times ha affermato che i 10,5 GW di nuova capacità – sufficienti per alimentare circa 1,8 milioni di case – costerebbero più di 10 miliardi di dollari , sulla base delle recenti tendenze del settore.

L’accordo arriva quando il crescente interesse per l’intelligenza artificiale generativa ha causato preoccupazioni sulla loro intensa domanda di energia e sulle emissioni di carbonio associate.

First Solar ha dichiarato mercoledì di aver firmato un accordo per la fornitura di 457 MW di moduli solari a film sottile, inclusi 170 MW di moduli bifacciali Serie 6 Plus e 287 MW di moduli Serie 7, alla spin-out MN8 Energy di Goldman Sachs Renewable Power; I dettagli finanziari non sono stati divulgati.

Annunci recentemente pubblicati :

Satya Nadella, CEO di Microsoft, ha annunciato che il colosso tecnologico investirà 2,2 miliardi di dollari nei prossimi quattro anni nella nuova infrastruttura cloud e AI della Malesia e nella creazione di un centro nazionale di intelligenza artificiale, segnando il più grande investimento di Microsoft in Malesia.

L’annuncio arriva subito dopo che Microsoft ha dichiarato che costruirà un data center in Tailandia e ha annunciato un investimento di 1,7 miliardi di dollari in servizi cloud e AI in Indonesia .

Il mese scorso, Microsoft ha anche svelato un investimento di 2,9 miliardi di dollari in Giappone e 1,5 miliardi di dollari in G42, un’azienda di intelligenza artificiale con sede ad Abu Dhabi .

A fine febbraio, Microsoft ha condotto un imponente round di finanziamento di Serie B, raccogliendo 675 milioni di dollari nella Bay Area. Recentemente, il gigante tecnologico ha reso nota la sua collaborazione con Sanctuary AI, celebre per il suo robot umanoide Phoenix.

Questa sinergia punta al cuore dell’interesse di Microsoft: l’intelligenza artificiale generale, ovvero robot capaci di apprendere e ragionare all’umano. Questa evoluzione promette un notevole avanzamento nelle competenze robotiche, tradizionalmente circoscritte a compiti specifici.

Microsoft ha fornito indicazioni sulla sua previsione degli utili, poiché prevede che le vendite fiscali del quarto trimestre saranno comprese tra $ 63,5 miliardi e $ 64,5 miliardi, rispetto alle stime di $ 64,57 miliardi. Sono inclusi tra i 28,4 e i 28,7 miliardi di dollari provenienti dall’Intelligent Cloud, con Azure in crescita tra il 30% e il 31% a valuta costante.

Le azioni di Microsoft sono aumentate di circa il 4% in orari prolungati dopo che il gigante tecnologico ha riportato risultati fiscali del terzo trimestre che hanno superato le aspettative.

Per il periodo terminato il 31 marzo, Microsoft ha guadagnato 2,94 dollari mentre le vendite sono aumentate del 17% su base annua raggiungendo 61,86 miliardi di dollari. In questo sono inclusi 26,7 miliardi di dollari dalla sua divisione Intelligent Cloud, che consiste nella sua unità cloud Azure. Microsoft ha affermato che i ricavi di Azure sono cresciuti del 31% su base annua e del 31% a valuta costante.

“Microsoft Copilot e Copilot Stack stanno orchestrando una nuova era di trasformazione dell’intelligenza artificiale, ottenendo risultati aziendali migliori in ogni ruolo e settore”,

ha affermato in una nota Satya Nadella, presidente e amministratore delegato di Microsoft.

Il colosso tecnologico con sede a Redmond, Washington, ha anche affermato che i ricavi del Personal Computing sono stati pari a 15,6 miliardi di dollari, compreso il primo trimestre della società con Activision Blizzard sotto la sua ala protettrice. Separatamente, le vendite di Produttività e Processi aziendali sono state pari a 19,6 miliardi di dollari, in crescita del 12% su base annua.

In Produttività e processi aziendali è stato incluso un aumento del 13% su base annua in Office Commercial, mentre Dynamics 365 ha registrato una crescita dei ricavi del 19% nello stesso arco di tempo. LinkedIn, il suo social network incentrato sul business, ha registrato un aumento delle vendite del 10%, o del 9% a valuta costante.

“Microsoft ha registrato un rapporto sugli utili eccezionale per il trimestre di marzo con una grande crescita nel cloud di Azure che segnala una forte domanda di intelligenza artificiale” “

La riaccelerazione della crescita di Azure al 31%, ben al di sopra delle stime degli analisti pari al 28%, e le indicazioni positive dell’azienda suggeriscono che Copilot e la trasformazione dell’intelligenza artificiale stanno ora guidando la crescita portando a un aumento delle entrate di oltre 1 miliardo di dollari per il primo trimestre. Il titolo ha una valutazione elevata grazie all’intelligenza artificiale e Microsoft è una delle aziende che mantiene la promessa dell’intelligenza artificiale.”

La società ospiterà una teleconferenza alle 17:30 EST per discutere i risultati.

Il contenuto del presente articolo deve intendersi solo a scopo informativo e non costituisce una consulenza professionale. Le informazioni fornite sono ritenute accurate, ma possono contenere errori o imprecisioni e non possono essere prese in considerazione per eventuali investimenti personali. L’articolo riporta esclusivamente le opinioni della redazione che non ha alcun rapporto economico con le aziende citate.

Microsoft ha presentato un modello di intelligenza artificiale in linguaggio ridotto ed economicamente vantaggioso chiamato Phi-3-mini, ha riferito Reuters.

Phi-3 Mini ha una capacità di 3,8 miliardi di parametri. Microsoft ricorda che, a differenza del modello Phi-1, che si è concentrato sulla codifica, e de modello Phi-2, che ha iniziato a imparare a ragionare, Phi-3 è migliore nella codifica e nel ragionamento.

Phi-3 viene addestrato su un set di dati più piccolo rispetto a modelli linguistici di grandi dimensioni (Mistral, Gemma, Llama-3-In) in compiti che vanno dalla matematica alla programmazione ai test accademici . Allo stesso tempo, funziona su dispositivi semplici come gli smartphone, senza Internet (tra poco parleremo di EDGE AI).

Per questo motivo Phi-3 potrebbe consentire alle aziende che non possono permettersi LLM connessi al cloud di passare all’intelligenza artificiale.

Il suo limite è l’ampiezza della “conoscenza fattuale” ( tassonomia di Bloom che organizza gerarchicamente i livelli della conoscenza ) dovuta alle dimensioni ridotte del set di dati, ecco perché non funziona nel test “TriviaQA“.

Phi-3 Mini è disponibile su Azure, Hugging Face e Ollama. Microsoft rilasciera’ in seguito Phi-3 Small (parametri 7B) e Phi-3 Medium (parametri 14B). Di seguito il Technical Report.

Il nuovo modello può eseguire attività come la creazione di contenuti e la pubblicazione di post sui social media utilizzando meno dati.

Il modello di intelligenza artificiale può superare modelli di dimensioni doppie in diversi benchmark che valutano le capacità linguistiche, di codifica e matematiche, aggiunge il rapporto.

“L’innovazione risiede interamente nel nostro set di dati per la formazione”, secondo il documento di ricerca. Questo set di dati si basa sul modello Phi-2 , ma utilizza “dati web fortemente filtrati e dati sintetici” di cui abbiamo parlato nell’artcolo La scalabilita’ è tutto ciò di cui hai bisogno, ma servono i dati.

In effetti, per svolgere entrambe queste attività è stato utilizzato un LLM separato, creando di fatto nuovi dati che consentono al modello linguistico più piccolo di essere più efficiente.

Secondo The Verge, Microsof è stato presumibilmente ispirato dai libri per bambini che utilizzano un linguaggio più semplice per affrontare argomenti complessi .

I modelli di intelligenza artificiale più piccoli mirano a svolgere compiti più semplici, il che ne facilita l’utilizzo da parte di aziende con risorse limitate, ha osservato Microsoft. Ne avevamo parlato settimane fa nell’articolo Un Pennello Grande o un Grande Pennello?

Microsoft ha recentemente introdotto VASA-1, un modello di intelligenza artificiale che produce video realistici di volti parlanti da una singola immagine statica e una clip audio.

Il modello è in grado di produrre video con una risoluzione di 512×512 pixel e una frequenza di 40 fotogrammi al secondo (FPS), con una latenza di soli 170 millisecondi sui sistemi GPU NVIDIA RTX 4090.

L’architettura del modello si basa su un approccio di diffusione.

A differenza dei metodi tradizionali che trattano le caratteristiche facciali separatamente, VASA-1 utilizza un modello basato sulla diffusione per generare dinamiche facciali e movimenti della testa in modo olistico. Questo metodo considera tutte le dinamiche facciali, come il movimento delle labbra, l’espressione e i movimenti degli occhi, come parti di un unico modello completo.

VASA-1 opera all’interno di uno spazio latente del viso districato ed espressivo, che gli permette di controllare e modificare le dinamiche facciali e i movimenti della testa indipendentemente da altri attributi facciali come l’identità o l’aspetto statico.

Il modello è stato addestrato su un set di dati ampio e diversificato, che gli consente di gestire un’ampia gamma di identità facciali, espressioni e modelli di movimento. Questo approccio di addestramento aiuta il modello a funzionare bene anche con dati di input che si discostano da ciò su cui è stato addestrato, come input audio non standard o immagini artistiche.

L’addestramento del modello prevede tecniche avanzate di districamento, che consentono la manipolazione separata delle caratteristiche facciali dinamiche e statiche. Ciò si ottiene attraverso l’uso di codificatori distinti per diversi attributi e una serie di funzioni di perdita attentamente progettate per garantire un’efficace separazione di queste caratteristiche.

VASA-1 è stato rigorosamente testato rispetto a vari benchmark e ha dimostrato di superare significativamente i metodi esistenti in termini di realismo, sincronizzazione degli elementi audiovisivi ed espressività delle animazioni generate.

Nonostante i risultati promettenti, la ricerca riconosce alcuni limiti del modello, come l’incapacità di elaborare le dinamiche di tutto il corpo o di catturare completamente elementi non rigidi come i capelli. Tuttavia, sono previsti lavori futuri per espandere le capacità del modello e affrontare queste aree.

L’Intelligenza Artificiale (AI) per immagini e video ha rivoluzionato molti settori, tra cui il riconoscimento di oggetti, l’analisi delle immagini mediche, la sorveglianza di sicurezza, la creazione di contenuti multimediali e molto altro. Ecco alcuni esempi di come l’AI viene utilizzata per immagini e video:

Altri esempi di Modelli in allegato

Newsletter AI – non perderti le ultime novità sul mondo dell’Intelligenza Artificiale, i consigli sui tool da provare, i prompt e i corsi di formazione. Iscriviti alla newsletter settimanale e accedi a un mondo di contenuti esclusivi direttamente nella tua casella di posta!

Microsoft Investe in G42 e nel calcolatore piu’ potente al mondo.

Microsoft, il gigante dell’industria tecnologica , ha annunciato un investimento di 1,5 miliardi di dollari per acquisire una partecipazione minoritaria in G42, un gruppo di holding tecnologiche con sede negli EAU. L’obiettivo di questa mossa strategica è di introdurre tecnologie di intelligenza artificiale all’avanguardia e infrastrutture digitali nei mercati del Medio Oriente, dell’Asia centrale e dell’Africa.

G42, conosciuta anche come Group 42 Holding Ltd, è una società di sviluppo ed un fondo di intelligenza artificiale (IA) fondata nel 2018. G42 è un leader globale nella creazione di intelligenza artificiale visionaria per un futuro migliore.

Nata ad Abu Dhabi e con una presenza globale, ha finanziato Jais, un LLM trainato sull’arabo, sviluppato in collaborazione con l’universita’ MBZUAI, Jais è stato addestrato sul supercomputer AI Condor Galaxy, su 116 miliardi di token arabi e 279 miliardi di token di dati inglesi, ma G42 è importante soprattutto per la collaborazione con Cerebras infatti le due societa’ hanno annunciato il 13 Marzo la costruzione di Condor Galaxy 3 (CG-3).

La partnership strategica tra Cerebras e G42 ha già fornito 8 exaFLOP di prestazioni di supercalcolo IA tramite Condor Galaxy 1 e Condor Galaxy 2, ciascuno tra i più grandi supercomputer IA del mondo. Situato a Dallas, in Texas, Condor Galaxy 3 porta l’attuale totale della rete Condor Galaxy a 16 exaFLOP.

La rete Condor Galaxy ha addestrato alcuni dei migliori modelli open source del settore, con decine di migliaia di download. Ogni CS-3 è alimentato dal nuovo transistor da 4 trilioni, 900.000 core di IA WSE-3.

Il nostro super calcolatore italiano Leonardo ha un picco di 270PFlops, ne servono 30 per fare la capacita del Condor-Galaxy-3 di Dallas (TOP500), CG3 può allenare un modello grande 100 volte l’attuale GPT4.

Il CG3 ha allenato un LLM per la medicina, l’M42 una rete sanitaria globale abilitata alla tecnologia. Il programma Med42 utilizza la versione da 70 miliardi di parametri di Llama 2. Il lavoro di messa a punto è stato eseguito da Cerebras e M42 in collaborazione con Core42, una società di servizi gestiti e IT che svolge ricerche fondamentali sull’intelligenza artificiale. Sia M42 che Core42 sono di proprietà del cliente Cerebras G42.

Il codice M42 è ora disponibile su HuggingFace, insieme ai dati sulle prestazioni.

Questo segna una pietra miliare significativa nel calcolo dell’IA, fornendo una potenza di elaborazione ed efficienza senza pari.

L’organizzazione si concentra sullo sviluppo dell’IA in vari settori, tra cui governo, sanità, finanza, petrolio e gas, aviazione e ospitalità. G42 svolge processi di ricerca e sviluppo sull’IA, sui big data e sull’apprendimento automatico tramite la sua sussidiaria,l‘Inception Institute of Artificial Intelligence (IIAI).

Tahnoun bin Zayed Al Nahyan, consigliere per la sicurezza nazionale degli Emirati Arabi Uniti, è l’azionista di controllo e presidente della società. Peng Xiao è l’Amministratore Delegato del Gruppo.

G42 ha anche acquisito Bayanat per Mapping and Surveying Services LLC, un fornitore end-to-end di prodotti e servizi di dati geospaziali, per integrare i servizi satellitari di G42.

Sua Altezza Sheikh Tahnoon bin Zayed Al Nahyan, Presidente di G42, ha dichiarato:

“L’investimento di Microsoft in G42 segna un momento cruciale nel percorso di crescita e innovazione della nostra azienda, a significare un allineamento strategico di visione ed esecuzione tra le due organizzazioni. Questa partnership è una testimonianza ai valori condivisi e alle aspirazioni al progresso, promuovendo una maggiore cooperazione e sinergia a livello globale.”

Entrambe le aziende si impegnano a sostenere la creazione di un fondo da 1 miliardo di dollari destinato agli sviluppatori. Questo fondo mira a promuovere lo sviluppo di una forza lavoro qualificata e diversificata nel campo dell’intelligenza artificiale.

G42 implementerà le sue applicazioni e servizi di intelligenza artificiale sulla piattaforma cloud di Microsoft, Azure. Inoltre, G42 fornirà soluzioni di intelligenza artificiale a importanti aziende e clienti del settore pubblico.

Questa collaborazione commerciale è sostenuta da garanzie fornite ai governi degli Stati Uniti e degli Emirati Arabi Uniti, impegnandosi a rispettare le leggi statunitensi e internazionali in materia di commercio, sicurezza, intelligenza artificiale responsabile e integrità aziendale.

L’investimento di Microsoft in G42 rappresenta un esempio insolito di accordo che ha ottenuto l’approvazione esplicita delle rispettive autorità governative. Secondo quanto dichiarato dalle società coinvolte, questa “collaborazione commerciale è sostenuta da garanzie fornite ai governi degli Stati Uniti e degli Emirati Arabi Uniti tramite un innovativo accordo vincolante, il primo del suo genere, volto a implementare le migliori pratiche globali per assicurare uno sviluppo sicuro, affidabile e responsabile e la diffusione dell’intelligenza artificiale”.

Se l’accordo verrà concluso con successo, conferirà a Microsoft il ruolo di partner cloud ufficiale di G42. Secondo i termini dell’accordo, la piattaforma dati della società emiratina e altre infrastrutture cruciali verranno trasferite su Microsoft Azure, il quale supporterà lo sviluppo dei prodotti G42. È da notare che G42 ha già instaurato una partnership con OpenAI nel 2023.

La collaborazione con Microsoft sembra essere parte di una strategia continua da parte di G42 per ridurre la sua dipendenza dalle relazioni commerciali con la Cina. Infatti, l’azienda ha recentemente disinvestito dai suoi legami con la Cina, incluso il possesso di azioni nella società madre di TikTok, ByteDance, avvenuto lo scorso febbraio. Il CEO Xiao ha anche annunciato alla fine dell’anno scorso che l’azienda avrebbe gradualmente eliminato l’utilizzo di hardware cinese, dichiarando: “Non possiamo mantenere relazioni con entrambe le parti”.

In cambio, Microsoft otterrà un ampio accesso al mercato della regione. I suoi servizi di intelligenza artificiale e Azure potranno penetrare in una vasta gamma di settori, tra cui servizi finanziari, sanità, energia, governo e istruzione. Inoltre, la partnership prevede il lancio di un fondo da 1 miliardo di dollari “per supportare lo sviluppo delle competenze nell’intelligenza artificiale” negli Emirati Arabi Uniti e nella regione circostante.

Come evidenziato dagli eventi degli ultimi anni, le aziende tecnologiche si trovano sempre più ad affrontare la difficile scelta tra Stati Uniti e Cina, sia in termini di fornitori di tecnologia che di utenti o investitori. Le evoluzioni legate a G42 dimostrano che anche un paese come gli Emirati Arabi Uniti, che ha cercato di mantenere una posizione neutrale, potrebbe alla fine essere costretto a prendere una posizione chiara.

Newsletter AI – non perderti le ultime novità sul mondo dell’Intelligenza Artificiale, i consigli sui tool da provare, i prompt e i corsi di formazione. Iscriviti alla newsletter settimanale e accedi a un mondo di contenuti esclusivi direttamente nella tua casella di posta!

Microsoft investirà 2,9 miliardi di dollari in Giappone nei prossimi due anni, con l’obiettivo di potenziare i centri dati considerati essenziali per l’elaborazione dell’Intelligenza Artificiale generativa.

Lo anticipa l’agenzia Kyodo che cita fonti a conoscenza del dossier.

La società guidata da Satya Nadella prevede anche di aprire un centro di ricerca a Tokyo, il primo di questo tipo in Giappone, hanno detto le fonti, aggiungendo che l’annuncio sarà fatto a breve, in concomitanza con la visita del premier giapponese Fumio Kishida a Washington.

Per Microsoft sarebbe il maggior investimento nel Paese del Sol Levante mai realizzato fino ad oggi.

L’investimento, infatti, è parte del più ampio coinvolgimento di Microsoft nel programma governativo giapponese Generative AI Accelerator Challenge, coordinato dal ministero dell’Economia, del commercio e dell’industria.

Un aspetto importante sarà la collaborazione con l’ufficio di gabinetto giapponese, mirata a “rafforzare la resilienza di cybersicurezza del governo, delle aziende e della società”, come previsto dalla strategia di sicurezza nazionale approvata nel 2022.

Inoltre, Microsoft Research Asia sta estendendo la propria leadership nella ricerca nella regione Asia-Pacifico con l’apertura di un laboratorio a Tokyo.

Il nuovo laboratorio si concentrerà su aree quali l’intelligenza artificiale incorporata, la robotica, l’intelligenza artificiale sociale e la scoperta scientifica, in linea con le priorità socioeconomiche del Giappone.

Microsoft fornirà 10 milioni di dollari in sovvenzioni in risorse nei prossimi cinque anni all’Università di Tokyo e alla partnership sulla ricerca sull’intelligenza artificiale tra la Keio University e la Carnegie Mellon University per promuovere una migliore collaborazione nella ricerca.

Immagine da sinistra a destra: Fumio Kishida, Primo Ministro del Giappone; Brad Smith, vicepresidente e presidente di Microsoft; Suzanne P. Clark, Presidente e CEO, Camera di Commercio degli Stati Uniti; Rahm Emanuel, ambasciatore degli Stati Uniti in Giappone; Miki Tsusaka, Presidente, Microsoft Giappone.

Microsoft e OpenAI sono in trattative per investire fino a 100 miliardi di dollari in un progetto di data center che ospiterà un supercomputer, il più grande di una serie di installazioni che le società prevedono di realizzare nei prossimi sei anni, secondo quanto riferito da The Information, citando fonti a conoscenza della questione.

Il supercomputer, noto come “Stargate”, verrà realizzato negli Stati Uniti e sarà progettato per ospitare milioni di chip server specializzati per potenziare le capacità di intelligenza artificiale di OpenAI.

Microsoft, che ha già investito oltre 13 miliardi di dollari in OpenAI, dovrebbe essere responsabile del finanziamento del progetto come parte di un piano in cinque fasi che le società hanno già intrapreso.

Il gigante tecnologico sta sviluppando un supercomputer di fase 4 più piccolo per OpenAI, il cui lancio è previsto intorno al 2026 a Mt. Pleasant, nel Wisconsin. Microsoft ha preso in considerazione l’utilizzo di chip AI Nvidia per questo progetto che per essere completato richiederebbe un investimento di 10 miliardi di dollari.

Stargate sarà progettato per dare a Microsoft e OpenAI il vantaggio di utilizzare GPU sviluppate da produttori di chip diversi da Nvidia, come AMD Advanced Micro Devices e persino un chip server interno che MSFT ha recentemente lanciato.

Sommando tutti i progetti, anche quelli precedenti a Stargate che richiedono esborsi significativamente inferiori, il costo dell’iniziativa complessiva per l’azienda guidata da Satya Nadella supererebbe i 115 miliardi di dollari, che vuol dire oltre tre volte le spese in conto capitale di MSFT per server, edifici e altre attrezzature dello scorso anno.

Le previsioni sono quelle di lanciare Stargate già nel 2028 e di continuare ad espanderne le capacità fino al 2030. A tale proposito i dirigenti dell’azienda di Redmond hanno già discusso sull’eventualità di usare fonti di energia alternative, come ad esempio l’energia nucleare, per alimentare il supercomputer, che richiederà probabilmente almeno diversi gigawatt – abbastanza per alimentare almeno alcuni grandi data center oggi – per funzionare.

L’impegno di MSFT nel progetto dipenderà in parte anche dalla capacità di OpenAI di migliorare i servizi offerti, tuttavia è importante evidenziare che questo investimento sottolinea l’impegno di Microsoft e di OpenAI nello sviluppo dell’Intelligenza Artificiale e nell’aumento della potenza di calcolo necessaria per farlo.

Questo progetto potrebbe portare a significativi progressi nell’AI, con lo sviluppo di potenziali applicazioni in una vasta gamma di settori, dalla sanità all’istruzione, ai trasporti e altro ancora. Tuttavia, rimangono alcune preoccupazioni riguardo ai costi elevati e alle potenziali implicazioni ambientali di un tale progetto anche il relazione al recente warning sulla saturazione della rete elettrica americana a seguito dell’incremento della domanda di elettricità per alimentare i data center del cloud e dell’AI.

Newsletter AI – non perderti le ultime novità sul mondo dell’Intelligenza Artificiale, i consigli sui tool da provare, i prompt e i corsi di formazione. Iscriviti alla newsletter settimanale e accedi a un mondo di contenuti esclusivi direttamente nella tua casella di posta!

Secondo articolo di una serie di 4 che analizzano l’evoluzione normativa e l’ambiente dell’Intelligenza Artificiale in Europa.

In un momento in cui l’Intelligenza Artificiale in Europa sta catalizzando l’interesse del mondo politico a seguito dell’approvazione dell’AI Act da parte del Parlamento europeo e pur in un contesto in cui sembra mancare una visione unica europea sullo sviluppo di un sistema europeo di Intelligenza Artificiale, come abbiamo visto nel primo articolo di questa serie, c’è un Paese in Europa che da qualche anno sta invece progettando la sua sfida per diventare una potenza nel campo dell’innovazione tecnologica e dell’intelligenza artificiale. E’ la Francia di Emmanuel Macron che con un piano da 1,5 miliardi di euro, intende trasformare il Paese in uno dei protagonisti del settore puntando sull’open source e su un piano di sviluppo che ha l’obiettivo di potenziare le capacità informatiche, le componenti e le architetture di sistema necessarie per recuperare il gap competitivo con gli Stati Uniti da un lato e con la Cina dall’altro.

La strategia nazionale per l’intelligenza artificiale – nell’ambito del più ampio piano di investimenti da 54 miliardi di Francia 2030 per creare nuovi settori industriali e tecnologici nel Paese – ha gettato le basi per una strutturazione a lungo termine dell’ecosistema AI, in tutte le fasi dello sviluppo tecnologico (ricerca, sviluppi e innovazioni, applicazioni, marketing, ecc.), promuovendo la creazione e lo sviluppo di una rete di istituti interdisciplinari di intelligenza artificiale, il sostegno a cattedre di eccellenza in AI, il finanziamento di programmi di dottorato e investimenti nelle capacità di calcolo della ricerca pubblica.

I risultati di questa politica sono sotto gli occhi di tutti. In pochi mesi, l’ecosistema parigino è letteralmente esploso.

Un segno tangibile che qualcosa stava cambiando è stata l’ascesa fulminea dell’unicorno Mistral AI, nata meno di un anno fa e già impostasi come uno dei leader del settore. Il suo nuovo LLM Mistral Large è progettato per rivaleggiare con concorrenti come GPT-4 e Claude2.

Google ha inaugurato a Parigi il 16 febbraio scorso, alla presenza del ceo Sundar Pichai, del ministro dell’Economia Bruno Le Maire e del segretario di Stato per il Digitale Marina Ferrari, il suo nuovo centro di ricerca e sviluppo sull’intelligenza artificiale (AI), che vedrà al lavoro un team composto da più di 300 ricercatori e ingegneri.

“Parigi è un centro globale di innovazione e una calamita per i talenti” ha sottolineato Sundar Pichai a margine dell’evento, “sono felice di aprire questo nuovo capitolo di Google in Francia”.

Facebook aveva già aperto, sempre a Parigi, il suo laboratorio di ricerca sull’AI denominato Fair (Facebook Artificial Intelligence Research), sotto la direzione del ricercatore francese Yann Le Cun, uno dei pionieri nel campo dell’intelligenza artificiale e dell’apprendimento automatico.

Alphabet e Meta non sono però le uniche aziende del settore tecnologico ad aver investito nell’intelligenza artificiale a Parigi. Altre realtà come Ibm, Samsung e Fujitsu hanno aperto dei propri centri di ricerca nella capitale francese.

“In pochi anni siamo riusciti a creare diversi istituti di ricerca interdisciplinari, a raddoppiare il numero di laureati in intelligenza artificiale e ad aumentare di 500 il numero dei dottorandi” è stato il commento del presidente Emmanuel Macron in occasione del lancio del laboratorio di ricerca sull’Intelligenza Artificiale Kyutai guidato da Xavier Niel, il patron di Iliad e da Eric Schmidt, ex CEO di Google, che con una dotazione di 300 milioni di euro ha l’obiettivo di attirare i più grandi talenti del settore AI. Kyutai è ospitato all’interno di Station F, il più grande campus di start up del mondo, situato nel 13° arrondissement di Parigi, in un ex deposito ferroviario, quello de La Halle Freyssinet, e ospita più di 1.000 startup in uno spazio di 34.000 mq. Un progetto ambizioso volto ad affermare la Francia come punto di riferimento globale nel campo dell’innovazione.

Tutte queste iniziative mirano a costruire un hub che da Parigi funga da collegamento per università, centri di ricerca e aziende. A Parigi sono peraltro presenti due figure di spicco dell’intelligenza artificiale: Vincent Simonet, direttore dell’ingegneria di Google France, e Joëlle Barral, direttrice della ricerca sull’Intelligenza Artificiale presso Google Deep Mind, tornata dagli Stati Uniti appena un anno fa.

Che Parigi e la Francia più in generale abbiano una strategia chiara per raggiungere l’obiettivo di diventare leader a livello europeo dell’Intelligenza Artificiale si capisce peraltro anche dalle posizioni che ha tenuto il governo francese durante i negoziati che hanno portato all’approvazione dell’AI Act europeo, esercitando ad esempio pressioni per un’esenzione totale per i modelli fondamentali. Come gli osservatori più attenti avranno rilevato la posizione dell’Eliseo è drasticamente cambiata nel corso del 2023, passando da una visione di fatto allineata a quella degli atri Paesi in termini di vincoli e regole ad una più favorevole all’adozione di maglie larghe nella regolamentazione per paura che i troppo vincoli della legislazione europea avrebbero potuto mettere in crisi non solo realtà nazionali come Mistral AI ma anche l’attrattività del suo progetto di diventare l’hub europeo delle start-up che puntano sull’innovazione e sull’Intelligenza Artificiale.

Ricordiamoci anche che il più grande incubatore di start-up al mondo si trova proprio a Parigi ed occupa occupa i 34 000 metri quadri della Halle Freyssinet, l’ex deposito ferroviario dell’Est della capitale francese. Station F, questo il nome dell’incubatore, nato nel 2017 per volere di Xavier Niel patron di Iliad, ospita già oltre alle start-up anche giganti del tech come Microsoft, la già citata Facebook, aziende come LVMH e realtà di prestigio come l’HEC, la storica grande école di business di Parigi, con la quale Station F ha appena lanciato, lo scorso mese di febbraio, un programma specifico per attirare più start-up internazionali interessate a decollare nel mercato europeo.

Tanta roba.

E l’Italia in questo scenario come si sta muovendo? Lo vedremo nel prossimo articolo dove analizzeremo cosa si sta facendo in Italia sul tema dell’Intelligenza Artificiale.

Leggi il 1° articolo della serie: Dopo l’AI Act: impatti e prospettive per l’Intelligenza Artificiale in Europa

Non perderti le ultime novità sul mondo dell’Intelligenza Artificiale, i consigli sui tool da provare, i prompt e i corsi di formazione. Iscriviti alla newsletter settimanale e accedi a un mondo di contenuti esclusivi direttamente nella tua casella di posta!

Gli analisti continuano a esprimere un crescente ottimismo riguardo alle opportunità di sicurezza offerte da Microsoft Copilot.

Questo si deve principalmente alla percezione di una forte adattabilità dell’intelligenza artificiale generativa nel contesto della sicurezza informatica. Le capacità di generazione di codice, riconoscimento di modelli e riparazione automatizzata di Copilot sono state individuate come elementi chiave che lo distinguono nel mercato della sicurezza. Inoltre, la capacità di apprendimento continuo e di adattamento alle minacce emergenti sta rafforzando ulteriormente la fiducia degli analisti nel potenziale di Copilot per migliorare la resilienza e l’efficacia delle difese digitali

A questo proposito J.P. Morgan ha affermato che il chatbot di intelligenza artificiale Copilot for Security di Microsoft sta determinando un cambio di paradigma nelle capacità di sicurezza del colosso tecnologico, riportamo il Transcript :

“Consideriamo la profondità dell’attenzione e della discussione sull’intelligenza artificiale durante l’evento di punta sulla sicurezza di Microsoft come un chiaro messaggio sul livello di impatto che questa tendenza tecnologica potrebbe avere sull’avanzamento della differenziazione di Microsoft nel mercato, con chiare opportunità di beneficiare del consolidamento dei fornitori IT mentre incorpora questi strumenti in tutto il suo stack tecnologico”, ha affermato un team di analisti guidati da Mark Murphy.

Gli analisti hanno sottolineato che la monetizzazione di questi prodotti, simile ad altri strumenti Copilot, seguirà un modello graduale nelle prime fasi, ma si prevede che subirà un significativo aumento nell’adozione in futuro.

La sede di Microsoft a Redmond, nello stato di Washington, ha annunciato mercoledì che lo strumento Copilot for Security sarà disponibile in versione “generale” a partire dal 1° aprile, con una serie di nuove funzionalità. Questo servizio consentirà ai professionisti della sicurezza informatica di sfruttare l’intelligenza artificiale generativa per svolgere attività come il riepilogo degli incidenti, l’analisi delle vulnerabilità e la condivisione delle informazioni sensibili.

Secondo un rapporto di Verge, l’azienda addebiterà alle aziende un costo di 4 dollari all’ora di utilizzo come parte di un modello di consumo aaS.

Questo approccio tariffario potrebbe favorire una maggiore adozione, permettendo alle aziende di pagare solo per l’uso effettivo del servizio, senza investimenti iniziali eccessivi.

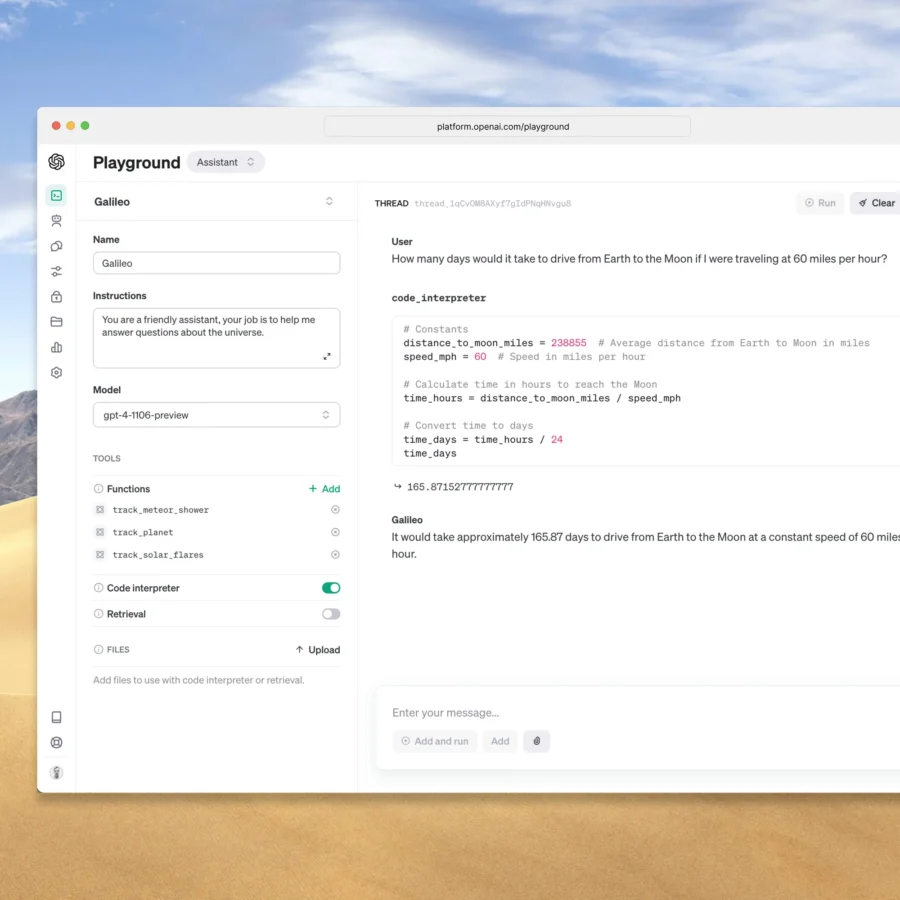

Sempre in questi giorni Microsoft ha confermato che il modello linguistico di grandi dimensioni (LLM)

GPT-4 Turbo di OpenAI è ora disponibile per gli utenti gratuiti di Copilot, il suo assistente basato sull’IA

Le novita’ :

GPT-4 Turbo è più capace e ha conoscenze sugli eventi mondiali fino ad aprile 2023. Ha una finestra di contesto di 128k, quindi può contenere l’equivalente di più di 300 pagine di testo in un’unica richiesta. Ottimizzato le sue prestazioni, a un prezzo tre volte più basso per i token di input e a un prezzo due volte più basso per i token di output rispetto a GPT-4.

GPT-4 Turbo è disponibile per tutti gli sviluppatori paganti da provare passando gpt-4-1106-preview nell’API e MSFT prevede di rilasciare il modello stabile pronto per la produzione nelle prossime settimane.

Aggiornamenti per la chiamata di funzioni

La chiamata di funzioni consente di descrivere le funzioni della tua app o delle API esterne ai modelli e di far scegliere al modello in modo intelligente di restituire un oggetto JSON contenente gli argomenti per chiamare quelle funzioni.

Con diversi miglioramenti oggi, tra cui la possibilità di chiamare più funzioni in un’unica richiesta: gli utenti possono inviare un’unica richiesta per più azioni, come ad esempio “aprire il finestrino dell’auto e spegnere l’aria condizionata”, che prima richiederebbe più interazioni con il modello. Stiamo inoltre migliorando l’accuratezza della chiamata di funzioni: GPT-4 Turbo è più propenso a restituire i giusti parametri delle funzioni.

Miglioramento nell’ eseguire le istruzioni e JSON Mode

GPT-4 Turbo funziona meglio dei modelli precedenti nei compiti che richiedono la rigorosa esecuzione delle istruzioni, come generare formati specifici (ad esempio “rispondere sempre in XML”).

Supporta la nostra nuova modalità JSON, che garantisce che il modello risponderà con un JSON valido. Il nuovo parametro dell’API response_format consente al modello di limitare la sua output per generare un oggetto JSON sintatticamente corretto.

La modalità JSON è utile per gli sviluppatori che generano JSON nell’API Completions API al di fuori della chiamata di funzioni.

Output riproducibili e log probability

Il nuovo parametro seed consente output riproducibili rendendo il modello restituire completamenti consistenti nella maggior parte dei casi. Questa funzione beta è utile per casi d’uso come riprodurre richieste per il debug, scrivere test di unità più completi e avere generalmente un maggiore controllo sul comportamento del modello.

MSFT sta anche lanciando una funzione per restituire le probabilità di log per i token di output più probabili generati da GPT-4 Turbo e GPT-3.5 Turbo nelle prossime settimane, il che sarà utile per creare funzionalità come l’autocompletamento in un’esperienza di ricerca.

Microsoft ha annunciato che il suo strumento Copilot for Security sarà “generalmente disponibile” dal 1° aprile, con nuove funzionalità.

Si tratta della prima soluzione di AI generativa progettata per aiutare i professionisti della sicurezza e dell’IT a rilevare le minacce in modo più accurato e veloce. Microsoft Copilot for Security si basa su threat intelligence e dati su larga scala, tra cui più di 78 trilioni di alert di sicurezza elaborati da Microsoft ogni giorno, e viene abbinato a modelli linguistici all’avanguardia che offrono approfondimenti personalizzati.

Copilot for Security consente ai professionisti della sicurezza informatica di utilizzare l’intelligenza artificiale generativa per attività quali il riepilogo degli incidenti, l’analisi delle aree vulnerabili e la condivisione delle informazioni.

Alcune delle nuove funzionalità includono promptbook personalizzati, supporto multilingue, integrazioni di terze parti e reportistica sull’utilizzo, ha affermato Microsoft.

“La prima soluzione di intelligenza artificiale generativa del settore aiuterà i professionisti della sicurezza e dell’IT a cogliere ciò che gli altri perdono, a muoversi più velocemente e a rafforzare le competenze del team“, ha affermato Microsoft in una nota.

Microsoft ha anche affermato che istituirà una modifica dei prezzi per Copilot for Security, addebitando alle aziende $ 4 l’ora di utilizzo come parte di un modello “pay as you go“.

“Con questo modello di prezzo flessibile e basato sul consumo, puoi iniziare rapidamente, quindi adattare l’utilizzo e i costi in base alle tue esigenze e al tuo budget“, ha affermato Microsoft nel comunicato. Circa 300 clienti stanno già utilizzando lo strumento, ha affermato Microsoft in una conferenza stampa.

Non perderti le ultime novità sul mondo dell’Intelligenza Artificiale, i consigli sui tool da provare, i prompt e i corsi di formazione. Iscriviti alla newsletter settimanale e accedi a un mondo di contenuti esclusivi direttamente nella tua casella di posta!

“Il nucleare sta tornando in tutto il mondo”. Lo ha detto in questi giorni la commissaria Ue all’Energia Kadri Simson.

L’ Agenzia internazionale dell’energia faceva riferimento a “Una nuova alba per l’energia nucleare” nel report annuale del 2022 anno in cui l’Europa ha inserito questa risorsa assieme al gas tra quelle da utilizzare nella transizione energetica.

Dall’altra parte dell’atlantico le manovre strategiche di Microsoft nello spazio dell’intelligenza artificiale vanno ben oltre l’aiutare OpenAI a creare chatbot migliori in modo che possano vendere le licenze di Office 365 Co-Pilot.

Mentre si rafforza la loro partnership con OpenAI e le loro alleanze si fanno sempre più profonde assistiamo anche a una trasformazione dell’infrastruttura, con Microsoft che investe pesantemente nell’energia nucleare (attraverso una società in portafoglio di Sam Altman Helion) per sostenere i suoi ampi data center creando una nuova business unit cloud competitiva che ha la promessa di offrire un insieme unico di servizi.

Bill Gates ha anche avviato un incubatore per progetti SMR chiamato TerraPower. Tuttavia, TerraPower “non ha attualmente alcun accordo per la vendita di reattori a Microsoft”, secondo una dichiarazione alla CNBC .

Sebbene Azure con OpenAI sia fondamentale, i costi diventeranno un problema.

Secondo quanto riferito, Sam Altman sta cercando di chiedere a Microsoft maggiori finanziamenti per gestire OpenAI poiché i costi per addestrare i modelli di intelligenza artificiale sono aumentati vertiginosamente.

Una parte importante di questo costo è l’elettricità. L’energia rappresenta il 60-70% dei costi di gestione di un data center. Se Microsoft riesce a ridurre questi costi (sia per OpenAI che per i suoi clienti), otterrà un enorme vantaggio in termini di prezzi che potrà offrire ai propri clienti finali.

Inoltre, Microsoft ha firmato una partnership con l’operatore della centrale nucleare con sede in Virginia Constellation Energy per portare l’energia nucleare nei propri data center, dimostrando l’impegno di Microsoft nel ridurre la propria impronta di carbonio e nell’innovazione nel settore energetico.

Ad esempio, in questa partnership, un data center a Boydton, in Virginia, avrà fino al 35% della sua energia fornita dall’energia nucleare.

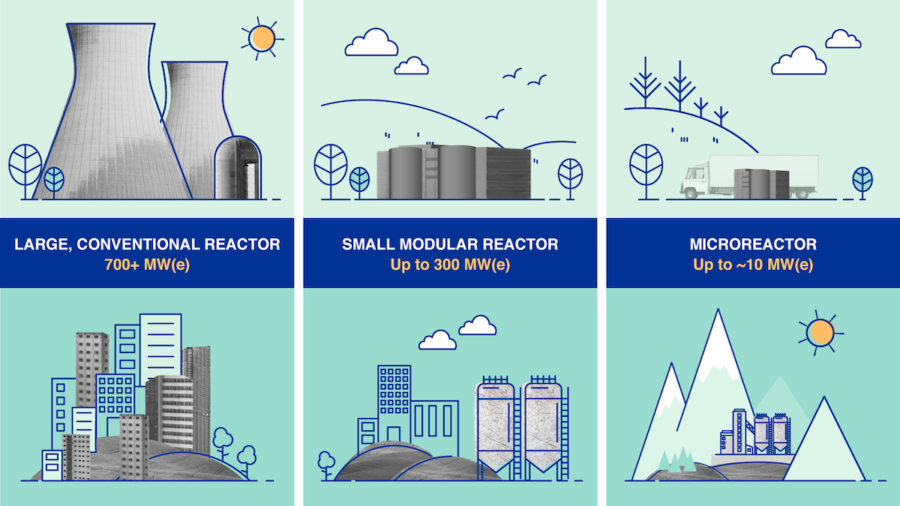

Questa strategia prevede l’adozione di piccoli reattori modulari (SMR), che rappresentano una potenziale soluzione ai limiti di potenza delle crescenti operazioni dei data center. In italia ci stanno lavorando Enea e Ansaldo Nucleare .

Gli SMR usano le scorie come combustibile per reattori. Sulla quarta generazione e sugli Smr si sta muovendo per esempio Enel che collabora con Newcleo, società italiana con sede a Londra.

In effetti, Microsoft sta assumendo attivamente esperti in tecnologia nucleare per implementare una strategia globale per l’energia SMR e microreattori per supportare le esigenze energetiche sia del cloud che dell’intelligenza artificiale di Microsoft.

Gli effetti di questo passaggio sono grandi. L’energia nucleare rappresenta solo il 50-70% del costo dell’energia da carbone (già considerata attualmente una delle fonti di elettricità più economiche).

Ci vuole molto capitale in anticipo per costruire una centrale nucleare (che si tratti di un SMR o di una centrale elettrica completa), ma per Microsoft il risparmio potrebbe valere miliardi di dollari per i propri data center.

Ciò significa realizzare una delle più rapide crescite di software o piattaforme aziendali mai viste (da dimostrare), oltre a riprogettare un nuovo alimentatore per gestire molti dei loro data center che alimenteranno il sistema ChatGPT/API di OpenAI a un costo molto più conveniente.!

Giovedì 9 marzo Eni ha firmato un accordo di cooperazione tecnologica con Commonwealth Fusion Systems, spinout dell’Mit. Obiettivo: accelerare l’industrializzazione dell’energia da fusione e non da fissione, ha un obiettivo ambizioso: realizzare nel 2025 il primo impianto pilota a confinamento magnetico, ed entro il 2035, costruire la prima centrale elettrica industriale in grado di immettere elettricità nella rete.

Il 6 Marzo Edf, Edison e Ansaldo hanno sottoscritto una lettera di intenti per collaborare allo sviluppo del nuovo nucleare in Europa, per favorirne la diffusione anche in Italia.

La sfida è complessa, sia dal punto di vista tecnico che da quello economico: nelle stesse ore dell’annuncio sono andati in fumo i piani della statunitense NuScale di costruire il primo reattore Smr sul suolo americano.