L’articolo ‘Imagine Flash: Accelerating Emu Diffusion Models with Backward Distillation‘ discute la ricerca GenAI che supporta le ultime funzionalità di generazione di immagini in Meta AI, oltre al rilascio di Meta Llama 3.

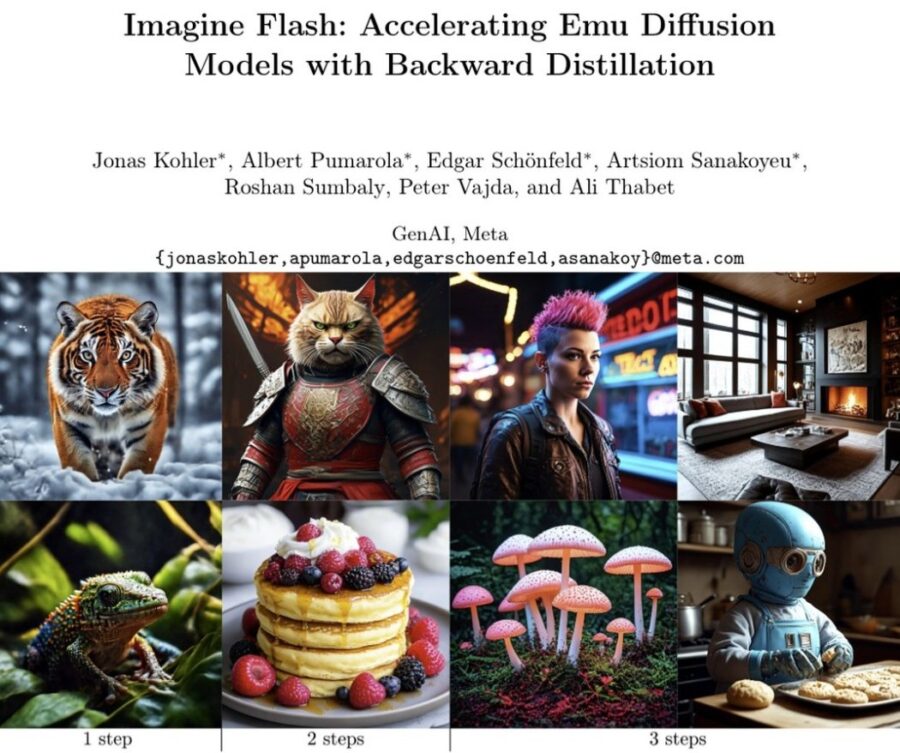

Questa ricerca si concentra sull’accelerazione dei modelli di diffusione Emu attraverso una tecnica chiamata Backward Distillation. La Backward Distillation mira a mitigare le discrepanze tra addestramento e inferenza calibrando il modello studente sulla sua stessa traiettoria inversa. Questo approccio è fondamentale per consentire la generazione di campioni ad alta fedeltà e diversificati utilizzando un numero minimo di passaggi, tipicamente compreso tra uno e tre.

L’articolo introduce anche la Shifted Reconstruction Loss, che adatta dinamicamente il trasferimento di conoscenza in base al passo temporale corrente, e la Noise Correction, una tecnica di inferenza che migliora la qualità del campione affrontando le singolarità nella previsione del rumore.

Attraverso esperimenti approfonditi, lo studio dimostra che il loro metodo supera i concorrenti esistenti sia in metriche quantitative che in valutazioni umane, raggiungendo prestazioni paragonabili al modello insegnante con soli tre passaggi di denoising, facilitando così una generazione efficiente di alta qualità.

Sintesi :

I modelli di diffusione rappresentano un robusto framework generativo, tuttavia implicano un processo inferenziale dispendioso. Le tecniche di accelerazione correnti spesso degradano la qualità delle immagini o risultano inefficaci in scenari complessi, specie quando si limitano a pochi step di elaborazione.

Nel presente studio, META introduce un innovativo framework di distillazione ideato per la produzione di campioni vari e di alta qualità in soli uno a tre step. La metodologia si articola in tre componenti fondamentali: (i) Distillazione inversa, che riduce il divario tra fase di addestramento e inferenza attraverso la calibrazione dello studente sulla propria traiettoria inversa; (ii) Perdita di ricostruzione adattiva, che modula il trasferimento di conoscenza in funzione del tempo di passaggio specifico; e (iii) Correzione adattiva del rumore, una strategia inferenziale che raffina la qualità dei campioni intervenendo sulle anomalie nella previsione del rumore.

Mediante una serie di esperimenti approfonditi, META ha verificato che il metodo eccelle rispetto ai rivali in termini di metriche quantitative e giudizi qualitativi forniti da valutatori umani. In modo significativo, il nostro approccio raggiunge livelli di performance similari al modello originale con soli tre step di denoising, promuovendo una generazione di immagini di alta qualità e ad alta efficienza.