Foxconn, il colosso taiwanese dell’elettronica, ha recentemente presentato “FoxBrain”, il suo primo modello di linguaggio di grandi dimensioni (LLM) ottimizzato per il cinese tradizionale e gli stili linguistici taiwanesi. Questo sviluppo rappresenta un passo significativo nell’integrazione dell’intelligenza artificiale nei processi produttivi e nella gestione della catena di fornitura.

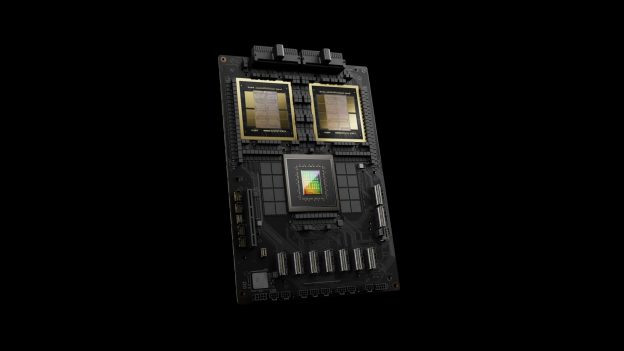

Il modello FoxBrain è stato sviluppato utilizzando 120 GPU Nvidia H100 e si basa sull’architettura Llama 3.1 di Meta. Il processo di addestramento è stato completato in circa quattro settimane, rendendo FoxBrain il primo LLM taiwanese con capacità di ragionamento ottimizzate per il cinese tradizionale. Sebbene presenti un lieve divario prestazionale rispetto al modello DeepSeek della Cina, FoxBrain si avvicina agli standard mondiali.