di Redazione Tech

I grandi modelli linguistici (LLM) come ChatGPT hanno rivoluzionato il modo in cui interagiamo con l’intelligenza artificiale, ma non sono privi di limiti. Uno dei problemi più critici è la generazione di contenuti “allucinati”, ovvero informazioni false o inventate presentate come vere. Questa tendenza rappresenta un rischio in contesti dove la correttezza fattuale è essenziale, come in ambito medico, giuridico o giornalistico.

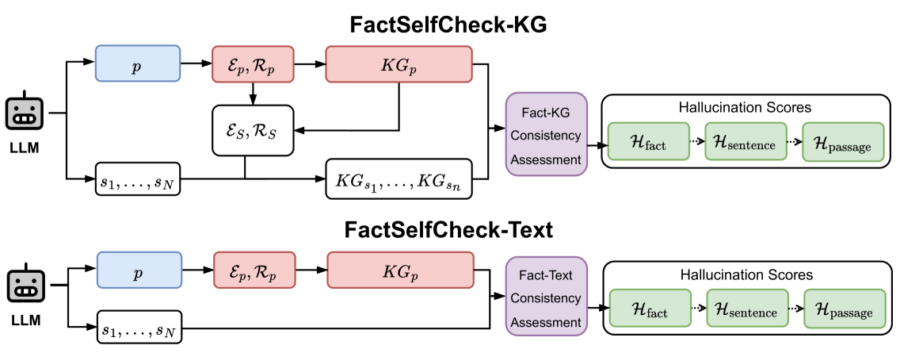

Un team di ricercatori della Wroclaw University of Science and Technology e dell’University of Technology Sydney ha recentemente presentato FactSelfCheck, un innovativo metodo per identificare le allucinazioni a livello di singoli fatti, anziché di frasi o paragrafi. Il sistema si basa sulla costruzione di grafi della conoscenza (knowledge graph), dove ogni fatto è rappresentato come una tripla (soggetto, relazione, oggetto). Ad esempio, (“Albert Einstein”, “premio Nobel”, “1921”).