“La questione se un computer possa pensare non è più interessante della questione se un sottomarino possa nuotare”. Edsger Wybe Dijkstra ha distillato, con la spietata lucidità che solo i grandi logici possiedono, l’essenza della nostra attuale ossessione per l’intelligenza artificiale. Essa non è pensiero, ma simulazione di pensiero, non è coscienza, ma emulazione di ciò che una coscienza farebbe se ne avesse una. L’AI non riproduce la mente umana, piuttosto ne riformula il senso, la necessità, il fine.

Tag: ETICA

Le AI stanno sviluppando valori propri: una nuova frontiera nell’etica dell’intelligenza artificiale

Un recente studio intitolato “Do LLMs have Consistent Values?” ha evidenziato che i modelli linguistici di grandi dimensioni (LLM) non si limitano a replicare dati, ma mostrano l’emergere di sistemi di valori propri, con “preferenze coerenti” che si rafforzano con l’aumento della scala del modello.

Questo fenomeno implica che LLM statunitensi, come quelli sviluppati da OpenAI, o cinesi, come DeepSeek o Qwen, indipendentemente dalla loro origine o dal fatto che siano open o closed source, tendono a convergere verso gli stessi valori, una convergenza che diventa più pronunciata all’aumentare delle dimensioni del modello.

La Revista Iberoamericana de Ciencia, Tecnología y Sociedad (CTS) ha prorogato fino al 15 marzo 2025 il termine per la presentazione di articoli accademici sul tema cruciale dell’intelligenza artificiale (IA) e della sua intersezione con l’etica. Questa estensione offre una preziosa opportunità a ricercatori, accademici e professionisti interessati ad approfondire le implicazioni tecnologiche, sociali e morali legate all’IA, ampliando il tempo disponibile per perfezionare i propri contributi.

Questa mattina, nel suo discorso al Corpo Diplomatico, Papa Francesco ha affrontato, tra le altre cose, il tema dell’Intelligenza Artificiale e delle nuove tecnologie, sottolineandone sia i benefici che i pericoli. Le parole del Pontefice rappresentano un invito a riflettere sul ruolo dell’innovazione tecnologica nella società contemporanea, mettendo al centro l’etica, la verità e la dignità umana.

Emmett Shear, noto per aver co-fondato Twitch e guidato la piattaforma come CEO fino al 2023, ha intrapreso una nuova avventura nel campo dell’intelligenza artificiale con la sua startup, Stem AI. Fondata nel giugno 2023, Stem AI si propone di sviluppare software di intelligenza artificiale che comprendano, collaborino e si allineino con il comportamento umano, le preferenze, la biologia, la moralità e l’etica umana.

La missione di Stem AI affronta una delle sfide più critiche nel panorama tecnologico odierno: l’allineamento dell’IA con i valori umani. Con l’avanzamento rapido delle tecnologie di intelligenza artificiale, garantire che queste operino in armonia con gli obiettivi umani è fondamentale per evitare conseguenze indesiderate, come decisioni distorte o, in scenari più estremi, sistemi superintelligenti fuori dal controllo umano. Shear ha espresso preoccupazioni in merito, sottolineando la necessità di una regolamentazione internazionale per gestire lo sviluppo dell’IA, paragonandola a trattati internazionali sul controllo delle armi.

Il contributo di Isaac Asimov, una delle figure più iconiche della letteratura di fantascienza, alla nostra comprensione del rapporto tra umanità e tecnologia è incalcolabile. Attraverso le sue storie e saggi, Asimov non solo ha intrattenuto milioni di lettori, ma ha anche offerto profonde riflessioni etiche e filosofiche che rimangono estremamente rilevanti nel contesto dell’attuale sviluppo dell’Intelligenza Artificiale e della robotica.

All’inizio del XXI secolo, il panorama delle tecnologie digitali è dominato da due superpotenze: America e Cina. Questi paesi non solo sono leader nell’innovazione tecnologica, ma hanno anche un’influenza significativa sulla società, sull’economia e sull’ambiente globale. In questo contesto, emerge un nuovo concetto: il dato è diventato la “nuova materia prima”, paragonabile al petrolio del secolo scorso. Questo articolo esplora come la gestione dei dati e l’uso delle tecnologie digitali possano essere ripensati in un’ottica di sostenibilità, con un focus sui temi trattati nel Digital Ethics Forum organizzato dall’Associazione Sloweb.

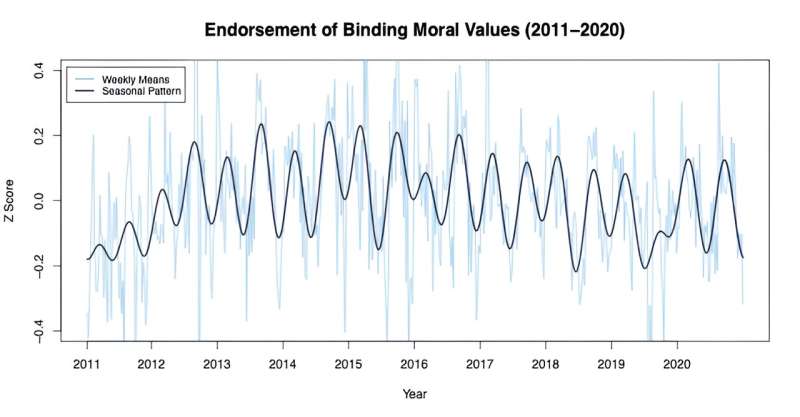

Un nuovo studio condotto dall’Università della Columbia Britannica ha rivelato che i valori morali delle persone cambiano regolarmente in base alle stagioni. Questa ricerca, pubblicata nelle Proceedings of the National Academy of Sciences, ha analizzato le risposte a sondaggi di oltre 230.000 persone negli Stati Uniti nel corso di dieci anni, mostrando che l’approvazione di valori morali che promuovono la coesione di gruppo e la conformità è più forte in primavera e autunno rispetto a estate e inverno.

Spesso la Politica si Intreccia con Tecnologia. Rivista.AI e’ attenta a questo connubbio.

Il primo ministro giapponese Fumio Kishida terminerà il suo mandato triennale il mese prossimo e non cercherà la rielezione alla guida del Partito Liberal Democratico al governo, a causa del calo di popolarità dovuto agli scandali politici.

“La politica non può funzionare senza la fiducia del pubblico”, ha detto in una conferenza stampa. “Ho preso questa decisione importante pensando al pubblico, con la forte volontà di portare avanti la riforma politica”.

Hiroshima e Nagasaki non sono note per la loro particolare religiosità, ma piuttosto per essere state vittime di devastanti bombardamenti atomici da parte degli Stati Uniti durante la Seconda Guerra Mondiale.

Hiroshima è stata scelta come sede simbolica per l’evento “AI Ethics for Peace: World Religions commit to the Rome Call”, che ha riunito leader religiosi di tutto il mondo per firmare la “Rome Call for AI Ethics”

English Podcast

La Cattedra dei non credenti è stata probabilmente una delle intuizioni più caratterizzanti l’episcopato di Carlo Maria Martini a Milano. L’iniziativa si sviluppò dal 1987 al 2002, lungo 12 edizioni e 50 incontri.

: «… Ciascuno di noi ha dentro di sé un non credente e un credente che ci parlano dentro, che si interrogano a vicenda».

Cardinale Carlo Maria Martini

Lanciata nel 2020, la Rome Call ha riunito originariamente la Pontificia Accademia, i leader di Microsoft e IBM il governo italiano e l’Organizzazione delle Nazioni Unite per l’alimentazione e l’agricoltura per promuovere scelte etiche nello sviluppo della tecnologia , norme legali per regolamentarla e sforzi educativi per aiutare le persone a comprendere l’intelligenza artificiale e il suo ruolo in una vasta gamma di applicazioni.

Oggi anche Cisco nella persona dell Presidente Chuck Robbins dopo aver brevemente incontrato Papa Francesco ha aderito alla iniziativa.

Siamo molto lieti che Cisco abbia aderito alla Rome Call, perché è un’azienda che svolge un ruolo cruciale come partner tecnologico per l’adozione e l’implementazione dell’intelligenza artificiale (AI), offrendo competenze in infrastrutture, sicurezza e protezione dei beni Dati e sistemi di intelligenza artificiale. D’ora in poi valuteremo come questa possa crescere ulteriormente per coniugare l’impegno aziendale già presente con i principi etici della Rome Call

presidente della Fondazione RenAIssance, mons. Vincenzo Paglia.

I firmatari stanno inoltre spingendo per lo sviluppo dell “algoretica”, un quadro etico per garantire che gli algoritmi utilizzati per costruire sistemi artificialmente intelligenti promuovano ciò che è vero, giusto ed etico.

L’algoretica è un termine coniato dal teologo Paolo Benanti. L’algoretica fonde l’algoritmo con l’etica e si pone come una nuova branca dell’etica che si dedica a esaminare gli aspetti morali degli algoritmi e dei sistemi basati sull’intelligenza artificiale1.

Il Rome Call for AI Ethics è un documento di grande importanza, firmato per la prima volta il 28 febbraio 2020. Questo documento è stato sviluppato per sostenere un approccio etico all’Intelligenza Artificiale (AI) e promuovere un senso di responsabilità tra organizzazioni, governi, istituzioni e il settore privato.

Pontificia Accademia per la Vita

La Pontificia Accademia per la Vita ha giocato un ruolo fondamentale nella creazione del Rome Call for AI Ethics. Questa accademia, con sede nello Stato della Città del Vaticano, è stata istituita da Papa Giovanni Paolo II con il motu proprio Vitae mysterium, l’11 febbraio 1994. Ha come fine la difesa e la promozione del valore della vita umana e della dignità della persona.

Fondazione RenAIssance

La Fondazione RenAIssance, istituita da Papa Francesco nel 2021, ha promosso il Rome Call for AI Ethics. Questa fondazione, con sede nella Città del Vaticano, presso la Pontificia Accademia per la Vita, è un’entità strumentale di tale Accademia. La Fondazione RenAIssance è un’organizzazione senza scopo di lucro con l’obiettivo di sostenere la riflessione antropologica ed etica delle nuove tecnologie sulla vita umana, promossa dalla Pontificia Accademia per la Vita.

Principi del Rome Call for AI Ethics

Il Rome Call for AI Ethics comprende 3 aree di impatto e 6 principi:

Aree di Impatto

- Etica: Tutti gli esseri umani nascono liberi e uguali in dignità e diritti.

- Educazione: Trasformare il mondo attraverso l’innovazione dell’IA significa impegnarsi a costruire un futuro per e con le generazioni più giovani.

- Diritti: Lo sviluppo dell’IA al servizio dell’umanità e del pianeta deve essere riflesso in regolamenti e principi che proteggono le persone, in particolare i deboli e i meno privilegiati, e gli ambienti naturali.

Principi

- Trasparenza: I sistemi di IA devono essere comprensibili per tutti.

- Inclusione: Questi sistemi non devono discriminare nessuno, poiché ogni essere umano ha pari dignità.

- Responsabilità: Deve sempre esserci qualcuno che si assume la responsabilità di ciò che una macchina fa.

- Imparzialità: I sistemi di IA non devono seguire o creare pregiudizi.

- Affidabilità: L’IA deve essere affidabile.

- Sicurezza e Privacy: Questi sistemi devono essere sicuri e rispettare la privacy degli utenti.

Rome Call for AI Ethics è un passo importante verso un futuro in cui l’innovazione digitale e il progresso tecnologico servono il genio e la creatività umana, e non il loro graduale rimpiazzo. Questo documento rappresenta un appello a riconoscere e poi a assumere la responsabilità che deriva dalla moltiplicazione delle opzioni rese possibili dalle nuove tecnologie digitali.

Alla luce dell’intensificarsi dei preparativi per le imminenti Olimpiadi di Parigi, l’integrazione dell’Intelligenza Artificiale nei sistemi di sorveglianza stradale in tempo reale ha acceso, in Francia e non solo, un acceso dibattito sulle libertà civili e le preoccupazioni per la sicurezza.

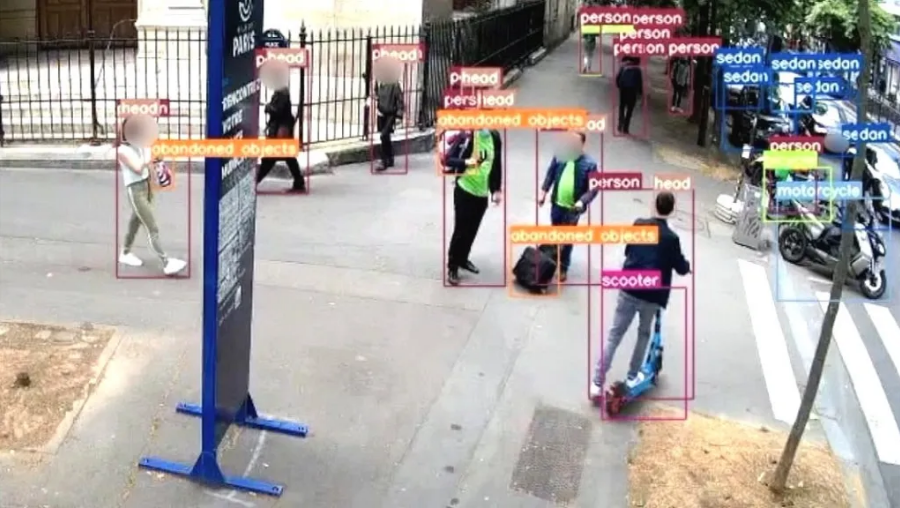

In base ai piani, avanzati algoritmi di Intelligenza Artificiale saranno dispiegati attraverso le telecamere CCTV in tutta Parigi, mirati a rilevare attività sospette come bagagli abbandonati e folle inaspettate. Mentre i i gruppi per i diritti civili esprimono preoccupazioni riguardo all’eventuale violazione delle libertà individuali, i sostenitori argomentano che tali misure siano cruciali per garantire la sicurezza pubblica durante eventi di rilievo.

Il quadro normativo che consente la video sorveglianaza algoritmica è contenuto nell’articolo 7 della Legge sui Giochi Olimpici, approvato dall’Assemblea Nazionale con 59 voti favorevoli e 14 contrari, che autorizza l’uso della cosiddetta videosorveglianza “intelligente” , basata su algoritmi per analizzare le immagini catturate da telecamere o droni, al fine di rilevare automaticamente azioni e azioni potenzialmente rischiose.

Secondo la formulazione dell’articolo, le immagini ottenute avranno il solo scopo di rilevare “in tempo reale eventi predeterminati idonei a manifestare o rivelare tali rischi e di segnalarli”, mentre il riconoscimento facciale non sembrerebbe autorizzato.

Tuttavia, lo scetticismo persiste tra coloro che sostengono che la videosorveglianza alimentata dall’AI, anche senza il riconoscimento facciale, costituisca una significativa minaccia alla privacy e all’autonomia personale per il rischio che tali tecnologie possano consentire una sorveglianza di massa, erodendo i diritti degli individui all’anonimato e alla libertà di movimento negli spazi pubblici.

L’introduzione di tale tecnologia rappresenta comunque una novità nel continente europeo. In una lettera aperta, 38 organizzazioni europee della società civile sostengono che l’uso generalizzato della videosorveglianza guidata da algoritmi presenta un rischio significativo per le libertà individuali e civili e viola il diritto internazionale sui diritti umani.

Mentre il governo francese naviga in un equilibrio delicato tra la sicurezza e le libertà civili, ancora una volta la questione mette in evidenza l’importanza delle considerazioni etiche nell’adozione dei sistemi di AI che toccano temi come la privacy e le libertà individuali, che stanno plasmando i discorsi pubblici in vista delle Olimpiadi di Parigi.

L’uso della tecnologia di sorveglianza automatizzata è un tema controverso, proprio per il rischio che l’integrazione dell’Intelligenza Artificiale possa rappresentare una nuova transizione nella sorveglianza di massa delle popolazioni civili. Questo perché l’uso di algoritmi nella videosorveglianza significa che il comportamento di chiunque venga filmato in uno spazio pubblico è costantemente analizzato e da qui al riconoscimento biometrico e facciale il passo è breve. Quello che è certo è che occorre trovare il giusto equilibrio tra i rischi per la sicurezza e la limitazione delle libertà civili.