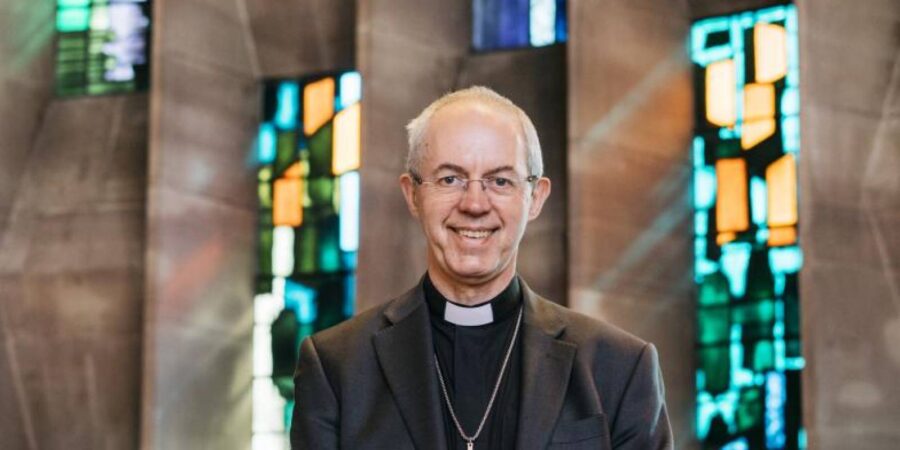

L’arcivescovo di Canterbury, Justin Welby, ha firmato a nome della Chiesa d’Inghilterra la Rome Call for AI Ethics, il documento, nato nel 2020, che sta dando un forte contribuito alla riflessione globale su uno dei temi di più stretta attualità: la necessità e l’urgenza di un’etica nello sviluppo e nella realizzazione dell’Intelligenza Artificiale.

“La firma dell’arcivescovo Justin Welby, oggi, è benvenuta per molti motivi. Anzitutto perché sottolinea che le questioni etiche che l’AI solleva sono di interesse globale” è il commento di mons. Vincenzo Paglia, Presidente della Pontificia Accademia per la Vita Esse, che aggiunge come questo tema trascenda i confini religiosi e culturali e abbracci principi universali come la dignità dell’uomo e del rispetto per il pianeta in cui vive.

L’adesione alla Rome Call da parte dell’arcivescovo Justin Welbi è importante proprio in quanto elemento capace di rafforzare questi principi perché, continua ancora mons. Paglia, “la Chiesa d’Inghilterra, attraverso la sua autorevolezza nel mondo globalizzato, può avere un ruolo decisivo nel sensibilizzare sulle questioni etiche legate all’Intelligenza Artificiale. Sono convinto che con questa firma crescerà la consapevolezza della responsabilità della società di fronte alla sfida rappresentata dall’Intelligenza Artificiale. E’ uno dei nuovi compiti affidati alla sapienza delle religioni perché in questo mondo ove lo sviluppo tecnologico sia al servizio della persona umana e dello sviluppo sostenibile del pianeta“.

Commentando l’evento, l’arcivescovo Welby, che ha firmato a nome della Chiesa d’Inghilterra, ha dichiarato: “Sono lieto di sostenere la Rome Call for AI Ethics, che sottolinea la dignità di ogni essere umano in mezzo ai cambiamenti tecnologici. Anche se non possiamo prevedere il futuro, sappiamo che continueranno ad esserci rapidi sviluppi nella scienza e nella tecnologia e dobbiamo essere preparati. L’intelligenza artificiale offre un enorme potenziale per migliorare le capacità umane. Deve anche cercare di proteggere, preservare e tutelare la dignità della persona umana. Gli enormi progressi offerti dall’AI non possono essere proprietà esclusiva dei suoi sviluppatori o di una singola parte dell’umanità. Devono essere per tutte le persone, ovunque. Devono essere al servizio del bene comune, del clima e dello sviluppo sostenibile. Il modo in cui comprendiamo l’intelligenza artificiale dipende in gran parte dal modo in cui comprendiamo la natura dell’essere umano. Lavoriamo tutti per garantire che la dignità di ogni essere umano, creato da Dio, non per il profitto o la produttività, sia al centro di tutto ciò che facciamo”.

La Rome Call for AI Ethics è un documento che mira a promuovere un senso di responsabilità condivisa per la dignità umana in un contesto di rapidi progressi tecnologici. Per garantire che ogni individuo, indipendentemente dal proprio background, possa beneficiare di questi progressi, le religioni, le organizzazioni internazionali, i governi, le istituzioni e il settore privato devono lavorare insieme. Il documento chiede uno sviluppo etico dell’Intelligenza Artificiale che sia al servizio dell’umanità piuttosto che del profitto e che contrasti la graduale sostituzione delle persone sul posto di lavoro e che, al tempo stesso, promuova il rispetto per il pianeta Terra.

Dal lancio della Rome Call nel febbraio 2020, molti stakeholder hanno firmato il documento, tra cui rappresentanti delle religioni abramitiche – l’Ebraismo, il Cristianesimo e l’Islam – il governo italiano, nonché player del settore come Microsoft, IBM e Cisco e la Fao a livello di organizzazione internazionale.

Padre Paolo Benanti, Professore Straordinario di Etica delle tecnologie presso la Pontificia Università Gregoriana e direttore scientifico della Fondazione RenAIssance, ha affermato: “Con questa nuova espansione della Rome Call possiamo guardare con rinnovata fiducia all’algoretica, ovvero al contributo positivo dell’approccio etico all’intelligenza artificiale. Non è mai un mero problema di innovazione. Si tratta piuttosto di trasformare quest’ultima in sviluppo umano. È altresì molto importante il fatto che il patrimonio di sapienza umana rappresentata dalle religioni parli all’intera umanità, valorizzando ciò che è condiviso per affrontare le sfide della contemporaneità”.

Iscriviti alla nostra newsletter settimanale per non perdere le ultime notizie sull’Intelligenza Artificiale.

Lascia un commento

Devi essere connesso per inviare un commento.