Scopri i migliori strumenti di Intelligenza Artificiale per generare video nel 2025! Questa pagina presenta tool AI per creare contenuti video, automatizzare processi e migliorare la qualità, ideali per creativi e professionisti.

Tag: ai video

Sora è il nuovo generatore di text-to-video di OpenAI. Lo strumento, presentato giovedì scorso dall’azienda con sede a San Francisco, utilizza l’intelligenza artificiale generativa per creare istantaneamente brevi video basati su comandi scritti.

Sora non è il primo a lanciare questo tipo di tecnologia, dove sono già presenti realtà come Runway, Stable Video Diffusion, Pika e più recentemente Google con Lumiere. Tuttavia se andiamo ad analizzare i commenti dei vari esperti del settore rileviamo che sono tutti unanimi nel sottolineare l’alta qualità dei video realizzati finora e che l’introduzione di questa nuova App segni un passo avanti significativo sia per OpenAI che per il futuro della generazione di testo in video in generale.

Nel dettaglio Sora è un generatore di testo in video che crea video lunghi fino a 60 secondi in base a istruzioni scritte utilizzando l’Intelligenza Artificiale generativa. Il modello può anche generare video da un’immagine fissa esistente, tuttavia non è ancora disponibile per l’uso pubblico (OpenAI afferma che sta collaborando con politici e artisti prima di rilasciare ufficialmente lo strumento) e ci sono ancora molte cose che non sappiamo. Ma dall’annuncio di giovedì, la società ha condiviso una serie di esempi di video generati da Sora per mostrare cosa può fare e i risultati sembrano davvero impressionanti.

Contestualmente al rilascio, OpenAI ha dichiarato di essere consapevole che Sora potrebbe essere usata per produrre deepfake e disinformazione, specificando che l’azienda sta lavorando con i cosidetti “red teamer” esperti in aree come disinformazione, contenuti che incitano all’odio e pregiudizi, che testeranno il modello in modo contraddittorio, al fine di rilevare eventuali possibilità di rilevare contenuti fuorvianti. Immaginiamo quindi che non sarà possibile creare contenuti violenti o pornografici, né tantomeno riprodurre le fattezze di persone reali o lo stile di artisti famosi, come peraltro già succede per il suo generatore di immagini, Dall-E.

In ogni caso questo ulteriore passaggio evolutivo dell’AI generativa pone in capo a OpenAI una ulteriore responsabilità, non solo sul più vasto tema delle fake news che è possibile generare grazie a questi modelli ma anche dal punto di vista di eventuali problemi legati al diritto d’autore dei dati di addestramento per i quali OpenAI è già stata citata in giudizio da attori come il New York Times.

Google ha sviluppato, insieme al Weizmann Institute of Science e all’Università di Tel Aviv, un nuovo modello di intelligenza artificiale per la creazione di video a partire da foto e istruzioni testuali: si chiama Lumiere, omaggio ai fratelli inventori della macchina da presa e del proiettore cinematografico.

La novità di Lumiere IA, dal punto di vista tecnologico, sta nella qualità con cui il software riesce a ricreare lo spostamento dei soggetti all’interno del filmato grazie ad un’architettura chiamata “Space-Ti-me U-Net”, una rete spazio-temporale, che genera tutto il video in un unico passaggio, senza passare da sequenze intermedie, che presentano il rischio di possibili

incoerenze con le immagini precedenti e le successive.

Il grosso del lavoro, ça va sans dire, è svolto dall’Intelligenza Artificiale generativa che sceglie il movimento migliore dopo averne analizzati diversi, basandosi sul vasto database a cui hanno accesso i modelli di Big G, in modo tale da restituire un video plausibile.

Il modello di Lumiere è stato addestrato su un set di dati di 30 milioni di video, insieme alle relative didascalie di testo. Va precisato però che non si tratta di un software aperto al pubblico, almeno per il momento, ma solo di un progetto sperimentale di ricerca.

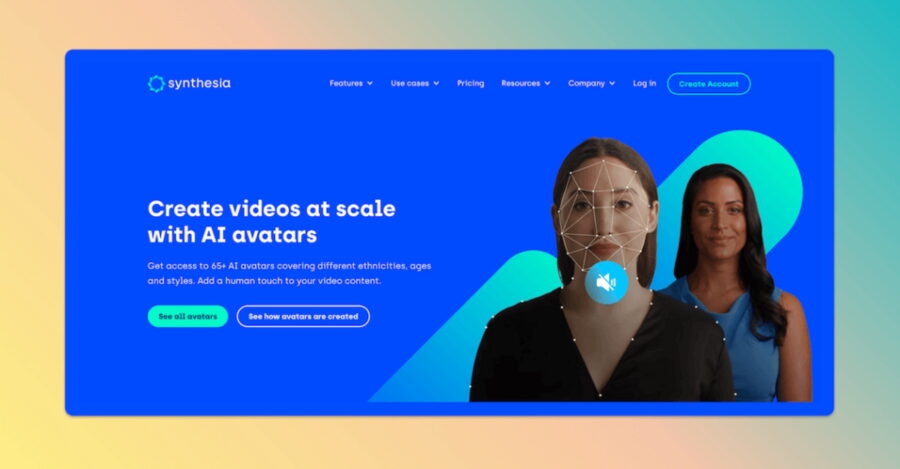

Synthesia è una startup che si occupa di generazione automatica di video con l’ausilio dell’Intelligenza Artificiale. Creare un video non è proprio una passeggiata, bisogna avere a disposizione uno studio, degli attori, le telecamere, fare attenzione alle luci, al suono, lavorare sulla post-produzione: insomma un processo complesso. Almeno fino ad ora. Perché la capacità dei sistemi guidati dall’Intelligenza Artificiale di generare contenuti audiovisivi sta facendo dei progressi enormi grazie al rilascio di sistemi di syntetic media in grado di generare video, immagini, testi e voci direttamente dal computer.

Ed è proprio quello che fa Synthesia, il tool di creazione video AI in grado di combinare Intelligenza Artificiale generativa, avatar, voci fuori campo e montaggio per creare in pochi minuti video di alta qualità, offrendo un’ampia gamma di funzionalità, come avatar, voci, sintesi vocale e un assistente di script per semplificare il processo di creazione dei video.

E’ anche possibile personalizzare il proprio avatar in modo che abbia il nostro aspetto, così come la nostra voce, oppure accedere ad una libreria di 60 template, video, 140 avatar e l’opzione di 120 lingue. Anche se, a proposito delle lingue, forse l’italiano è ancora da perfezionare.

Sotto un breve video di esempio di quello che si può realizzare con Synthesia. La facilità di generazione video è davvero impressionante, così come l’adattabilità nelle sfumature linguistiche, tranne forse che per l’italiano.

Qui sotto la versione in inglese:

Questa la versione in spagnolo:

La versione francese:

E infine, la versione in italiano, forse la meno riuscita:

PS: il tool è a pagamento, da 20,00 euro/mese