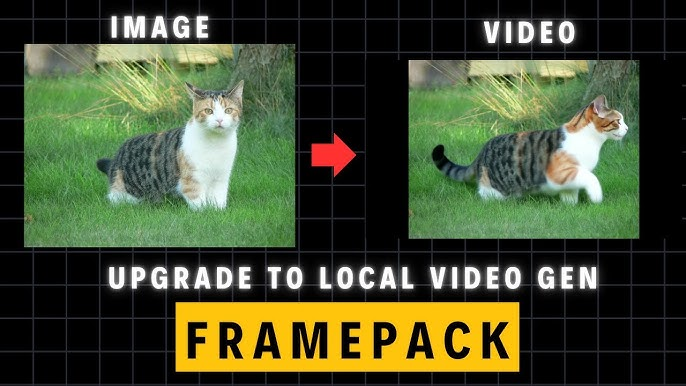

Chi avrebbe mai detto che il futuro dei video generati dall’intelligenza artificiale avrebbe preso forma su un desktop da gaming? E invece eccoci qui: FramePack, la nuova architettura neurale firmata Lvmin Zhang (con la benedizione di Maneesh Agrawala da Stanford), è il perfetto esempio di quando la potenza di calcolo incontra l’intelligenza progettuale. Il risultato? Video AI da un minuto intero, di qualità notevole, sfornati su una GPU casalinga con appena 6GB di VRAM. Hai presente quelle workstation che sembravano necessarie per l’IA generativa? Dimenticale.

Il trucco non sta nella forza bruta, ma nell’ingegno algoritmico. FramePack reinterpreta la struttura della memoria nei modelli di diffusione video. Invece di accumulare informazioni temporali come un collezionista compulsivo di fotogrammi, li impacchetta in un contesto temporale a lunghezza fissa, ottimizzando il processo come un camionista zen che fa incastrare perfettamente i bagagli nel portabagagli. Questo riduce drasticamente il carico sulla GPU, permettendo di lavorare con modelli da 13 miliardi di parametri senza mandare in fumo la scheda video. Secondo gli autori, il costo computazionale è simile a quello della generazione di immagini statiche. E qui si sente già il tonfo delle vecchie soluzioni cloud, cadute rovinosamente dal loro piedistallo.