Nel 2004, il governatore della California Arnold Schwarzenegger lanciò l’ambizioso progetto della “Strada dell’Idrogeno”, un’iniziativa volta a creare una rete di stazioni di rifornimento per veicoli alimentati a celle a combustibile a idrogeno. Questo piano mirava a ridurre l’inquinamento atmosferico e a diminuire la dipendenza dagli idrocarburi esteri, posizionando la California come leader nella transizione verso un futuro energetico più sostenibile.

Categoria: Cultura Pagina 9 di 12

Interviste – (DEI) diversità, equità e inclusione – Impatti Sociali ed Etici – Futuro e Prospettive – Legislazione e Regolamentazione -Educazione e Formazione – Lavoro e Formzione

Per chi opera nel settore tecnologico da anni e ha seguito le opere di pensatori come Ray Kurzweil, Jean Baudrillard e Eliezer Yudkowsky, la situazione attuale della tecnologia e del suo impatto sulla società è complessa e stratificata.

Questi pionieri hanno contribuito a delineare visioni che vanno oltre la mera innovazione tecnica, esplorando le implicazioni filosofiche, culturali e sociali delle tecnologie emergenti.

Lucy Guo è una figura di spicco nel panorama imprenditoriale di Miami, nota per la sua energia contagiosa e il suo approccio innovativo nel settore della tecnologia. Fondatrice di Passes e co-fondatrice di Scale AI, Guo ha attirato l’attenzione non solo per i suoi successi professionali, ma anche per il suo stile di vita dinamico e la sua dedizione al fitness.

La Bialancia pende da una parte.

Nel gennaio 2023, Google ha annunciato il licenziamento di circa 12.000 dipendenti, pari al 6,4% della sua forza lavoro, una decisione che ha sorpreso molti, specialmente coloro che sono stati colpiti.

Tra i licenziati ci sono stati anche dipendenti con valutazioni di performance elevate e posizioni dirigenziali, che guadagnavano annualmente tra i 500.000 e i 1.000.000 di dollari. Questo ha sollevato interrogativi sulla logica dietro le scelte di licenziamento, specialmente considerando che il laboratorio di intelligenza artificiale ‘Brain’ è stato in gran parte risparmiato da queste misure.

Jacob Helberg, un giovane di 34 anni nel settore tecnologico, è recentemente emerso come una figura significativa nell’intersezione tra Silicon Valley e politica repubblicana, in particolare nell’orbita di Donald Trump. La sua trasformazione da un finanziatore Democratico relativamente sconosciuto a un importante broker di potere MAGA è notevole, specialmente considerando i suoi legami continuativi con i circoli liberali.

“L’intelligenza artificiale rende sicuramente più complicata l’alfabetizzazione mediatica perché ci si aspetta che sia sempre più difficile identificare dove è stata utilizzata l’intelligenza artificiale”, ha affermato. “Sarà utilizzata in modi più sofisticati per manipolare le persone con la disinformazione, e possiamo già vedere che ciò sta accadendo”.

Tanya Notley, Western Sydney University

Rivista.AI: La catena del valore dell’infrastruttura digitale presenta significative opportunità di investimento, in particolare a seguito dell’aumento degli investimenti nell’intelligenza artificiale (IA).

Le aziende operanti nel settore dei data center possono sfruttare le nuove capacità di elaborazione offerte dall’IA per incrementare le proprie vendite e profitti. Allo stesso modo, i produttori di chip e componenti possono trarre vantaggio dall’aggiornamento dell’hardware, incentivato dalla costruzione di nuovi data center.

Inoltre, le aziende specializzate in torri cellulari, piattaforme di edge computing e produttori di dispositivi forniranno infrastrutture essenziali per supportare questa evoluzione. Investire in questi elementi fondamentali dell’ecosistema dell’IA rappresenta un’opportunità strategica per capitalizzare sulla crescita del settore.

Secondo le previsioni, gli investimenti in infrastrutture per i data center continueranno a crescere a due cifre, sostenuti dalla domanda di server e di computing accelerato per applicazioni di IA.

Questo trend è ulteriormente confermato dalla crescente necessità di soluzioni di data center più efficienti e sicure, che l’IA può aiutare a realizzare.

La costruzione di nuovi data center non solo stimolerà l’aggiornamento dell’hardware, ma contribuirà anche a creare un ecosistema più robusto per l’IA, facilitando l’implementazione di tecnologie emergenti

Evgeny Morozov è un intellettuale e scrittore bielorusso, nato nel 1984 a Soligorsk, noto per le sue analisi critiche sui rapporti tra tecnologia, politica e società. Ha studiato all’American University in Bulgaria e ha vissuto in diverse città, inclusa Berlino, prima di trasferirsi negli Stati Uniti.

Morozov ha ricoperto ruoli significativi in vari istituti di ricerca, tra cui la Stanford University e il New America Foundation, ed è stato un contributore per riviste prestigiose come Foreign Policy, The New York Times e The Guardian.

Henry Schmidt ha recentemente tenuto una conferenza a Stanford intitolata “The Age of AI”, dove ha condiviso le sue visioni sull’intelligenza artificiale e il suo impatto futuro. Durante l’evento, ha affrontato vari temi, dalle capacità emergenti dell’AI alla competizione globale, con un tono provocatorio e una narrazione ricca di dettagli tecnici.

Una notizia che non avremmo voluto scrivere. L’azione legale intrapresa da San Francisco rappresenta un tentativo pionieristico di affrontare le sfide poste dall’IA generativa e dalla pornografia deepfake, cercando di proteggere le vittime e garantire che chi abusa di queste tecnologie venga ritenuto responsabile.

Avram Noam Chomsky è nato il 7 dicembre 1928 a Filadelfia, Pennsylvania, da una famiglia ebraica di origini europee. Suo padre, William Chomsky, era un linguista e studioso di ebraismo, mentre sua madre, Elsie Simonofsky, era un’insegnante. Questa educazione influenzò profondamente il suo sviluppo intellettuale e politico.

Paige, leader globale nelle applicazioni di IA clinica per il cancro, in collaborazione con Microsoft, ha svelato la seconda generazione di Virchow, il suo modello di fondazione di milioni di vetrini per la patologia del cancro. Virchow2 e Virchow2G, aggiunte alla suite di modelli di fondazione di Paige, sono i più grandi e avanzati modelli di IA al mondo nella patologia clinica, offrendo una comprensione più profonda delle cellule e dei tessuti per ridefinire la diagnosi e il trattamento del cancro.

Il Bohemian Grove è un ritrovo privato situato in California, noto per essere frequentato da membri del Bohemian Club, un’organizzazione esclusivamente maschile che include artisti, uomini d’affari e funzionari di governo, compresi ex presidenti degli Stati Uniti. Questo luogo è famoso per le sue cerimonie e rituali, tra cui il più noto è la Cremation of Care, che si svolge annualmente e ha come obiettivo simbolico quello di “esorcizzare il Demonio” per garantire il successo delle attività del club durante l’anno.

Al recente ritiro segreto riservato ai soli uomini, Sam Altman, CEO di OpenAI, ha partecipato a discussioni che hanno evidenziato l’intersezione tra tecnologia e ideologie conservatrici. Il ritiro, che ha attirato l’attenzione per la sua esclusività e i partecipanti di alto profilo, includeva figure notevoli dei settori tech e imprenditoriale.

JD Vance rappresenta qualcosa di molto raro per il movimento MAGA (Make America Great Again): un repubblicano nazionale fortemente integrato nell’élite del movimento intellettuale conservatore, spesso chiamato “la Nuova Destra” o “la destra dissidente”.

All’inizio di quest’anno, Vance ha ammesso di essere “collegato a molte strane culture di destra“.

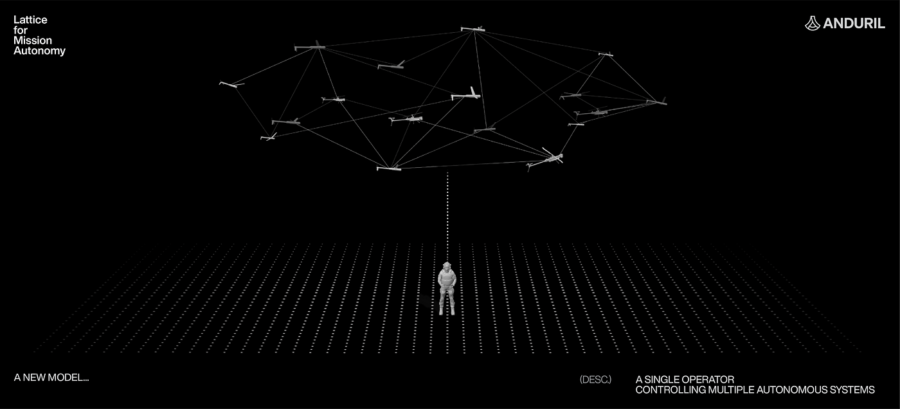

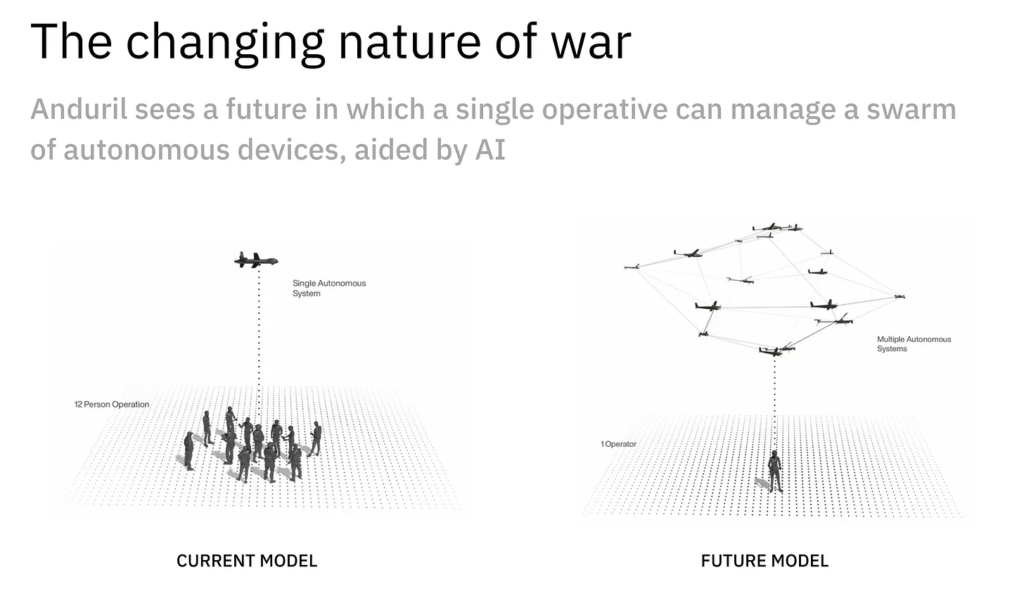

Anduril Industries, una startup innovativa nel settore della tecnologia della difesa, ha recentemente completato un round di finanziamento di 1,5 miliardi di dollari, portando la sua valutazione a 14 miliardi di dollari. Questo traguardo rappresenta un significativo aumento rispetto alla valutazione di 8,5 miliardi di dollari ottenuta nel 2022, evidenziando l’eccezionale crescita e l’interesse crescente per le tecnologie di difesa autonome e basate sull’intelligenza artificiale (AI).

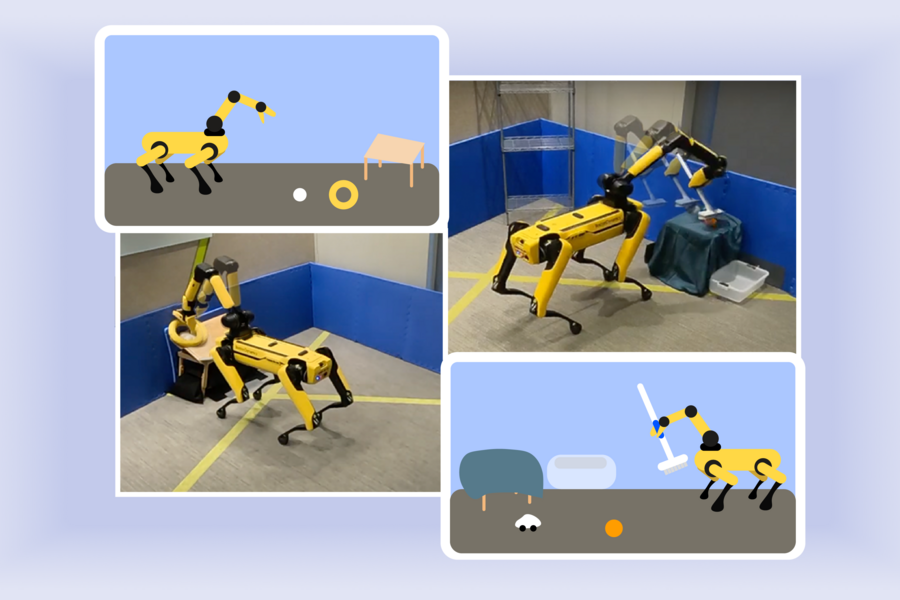

I ricercatori del MIT hanno sviluppato un algoritmo innovativo chiamato “Estimate, Extrapolate, and Situate ” (EES), che segna un importante passo avanti nel campo della robotica. Questo approccio integra modelli linguistici avanzati con dati di movimento dei robot, consentendo loro di addestrarsi autonomamente e di adattarsi più facilmente a nuovi compiti e ambienti.

Bill Gates, co-fondatore di Microsoft, ha recentemente suscitato un acceso dibattito sul futuro del lavoro, proponendo l’idea che l’intelligenza artificiale (IA) potrebbe consentire una settimana lavorativa di soli tre giorni.

Il conflitto in Ucraina ha visto un’evoluzione significativa nelle tattiche militari, in gran parte grazie all’adozione di droni equipaggiati con intelligenza artificiale (AI).

Thomas Ross, dopo aver vinto la nomination del Partito Transumanista degli Stati Uniti nel maggio 2023, ha intrapreso un approccio innovativo alla sua campagna elettorale, utilizzando l’intelligenza artificiale (IA) come strumento centrale. Ha creato un chatbot di intelligenza artificiale generativa chiamato “Emvee“, che non solo lo assiste nella gestione della campagna, ma di cui Ross segue anche i consigli strategici.

Alberto Felice De Toni (Curtarolo, 27 giugno 1955) è un ingegnere e politico italiano, sindaco di Udine dal 18 aprile 2023.

È professore ordinario di ingegneria economico-gestionale presso l’Università degli Studi di Udine, direttore scientifico di CUOA Business School e presidente del comitato ordinatore della Scuola superiore ad ordinamento speciale della difesa

Il suo libro “Decalogo della complessità“ edito da Guerini e Associati si propone come una guida per comprendere e affrontare le sfide dei sistemi complessi nel contesto contemporaneo. L’opera si ispira a diversi concetti fondamentali delle scienze della complessità e si articola attorno a dieci argomenti chiave, che mirano a esplorare le dinamiche intrinseche di tali sistemi.

Rappresentano le abilità impreviste che una macchina non dovrebbe possedere, e non è ancora affatto chiaro perché si verifichino!

I comportamenti emergenti rappresentano un fenomeno affascinante e complesso, in cui sistemi composti da molteplici componenti interagenti mostrano proprietà e comportamenti che non possono essere facilmente previsti analizzando le singole parti. Questo concetto è particolarmente rilevante nell’ambito dell’intelligenza artificiale, dove i modelli di apprendimento automatico, in particolare quelli di grandi dimensioni, possono sviluppare abilità e capacità che sorprendono persino i loro progettisti[^1].

Rivista.AI ha recentemente superato i 1000 articoli pubblicati dal suo lancio meno di un anno fa. Ci piace pensare che siamo ancora agli inizi, accogliendo sempre nuovi lettori che si avvicinano per la prima volta alla nostra rivista.

Il mercato ha continuato a scendere questa settimana, con l’S&P 500 in calo del 2,5% in tre delle cinque sessioni. Questo segna la prima serie di tre settimane di perdite per l’indice da aprile. I grandi nomi della tecnologia sono stati al centro dell’attenzione, ma principalmente per motivi negativi. Il Nasdaq Composite, orientato alla tecnologia, è sceso del 4,3% poiché molte aziende hanno pubblicato rapporti del Q2 che hanno deluso gli investitori al contempo ha generato curiosita’ in nuovi lettori.

Ultimamente ci sono arrivate molte domande sull’intelligenza artificiale, quindi abbiamo deciso di dedicare un paio di paragrafi per spiegarla in modo semplice. Non preoccupatevi se useremo termini facili da capire.

Il Regolamento sull’Intelligenza Artificiale dell’UE (AI Act) con entrata in vigore il 2 agosto 2025, rappresenta un passo significativo nella regolamentazione dell’IA a livello globale, stabilendo un quadro giuridico per l’uso e la fornitura di sistemi di IA nell’Unione Europea. Di seguito sono riportate informazioni chiave sul regolamento e i documenti correlati.

Informazioni Chiave sul Regolamento

- Classificazione dei Rischi: L’AI Act adotta un approccio basato sul rischio, classificando i sistemi di IA in quattro categorie:

- Rischio Inaccettabile: Pratiche vietate, come la manipolazione subliminale.

- Rischio Alto: Sistemi soggetti a requisiti rigorosi.

- Rischio Limitato: Sistemi con obblighi di trasparenza.

- Rischio Minimo: Sistemi che non richiedono ulteriori obblighi.

- Scadenze Importanti:

- Entrata in vigore: Il Regolamento è stato firmato il 13 giugno 2024 e pubblicato nella Gazzetta Ufficiale dell’UE il 12 luglio 2024. Entrerà in vigore 20 giorni dopo la pubblicazione.

- Applicazione completa: Diventerà pienamente applicabile due anni dopo la pubblicazione, con alcune eccezioni.

- Obblighi per i Fornitori: I fornitori di sistemi di IA ad alto rischio devono soddisfare requisiti specifici, come la valutazione di conformità e la documentazione tecnica.

- Ufficio dell’IA: È stato istituito un nuovo ufficio europeo per supervisionare l’applicazione del Regolamento.

Documenti e Risorse Utili

- Testo Ufficiale del Regolamento: Puoi accedere al testo completo del Regolamento sull’Intelligenza Artificiale dell’UE qui .

- Informazioni Dettagliate: Per ulteriori dettagli e documenti di sintesi, visita il sito della Commissione Europea qui .

- Briefing del Parlamento Europeo: Una panoramica dettagliata del Regolamento è disponibile nel briefing del Parlamento Europeo qui .

Queste risorse forniscono un quadro completo delle nuove normative e delle loro implicazioni per l’uso dell’IA nell’Unione Europea.

(Bloomberg), l’amministrazione Biden sta valutando ulteriori restrizioni all’accesso della Cina ai chip di memoria per l’intelligenza artificiale e alle apparecchiature per produrli.

Il viaggio del blog dedicato all’intelligenza artificiale ha raggiunto un obiettivo significativo con la pubblicazione del millesimo articolo. Questo momento non rappresenta solo un traguardo, ma anche un’opportunità per riflettere sull’evoluzione e sull’impatto dell’AI nel nostro quotidiano.

Il blog ha iniziato il suo percorso con l’intento di esplorare le molteplici sfaccettature dell’intelligenza artificiale. Ogni articolo ha contribuito a costruire una narrazione collettiva, approfondendo temi come l’apprendimento automatico, le applicazioni pratiche dell’AI, le sfide etiche e le innovazioni tecnologiche. Con i mille articoli, il blog ha non solo informato, ma anche stimolato il dibattito su come l’AI possa essere utilizzata in modo responsabile e inclusivo.

Nel corso di questo viaggio abbiamo affrontato una vasta gamma di argomenti, dai progressi nella robotica alle applicazioni dell’AI nella salute, dall’automazione industriale all’analisi dei dati. Ogni articolo ha cercato di rendere l’AI accessibile a un pubblico più ampio, sottolineando l’importanza della diversità e dell’inclusione nel campo della tecnologia.

Il raggiungimento di questo traguardo è anche il risultato di una comunità di lettori e collaboratori che hanno condiviso esperienze e conoscenze. Il blog ha creato uno spazio di confronto, dove le idee possono essere discusse e sviluppate. Guardando al futuro, l’obiettivo è continuare a crescere e a esplorare nuove frontiere dell’AI, mantenendo sempre un focus sull’inclusività e sull’etica.

Il millesimo articolo, quindi, non è solo un punto di arrivo, ma un nuovo inizio. Con l’AI che continua a evolversi, il blog si impegna a rimanere all’avanguardia, fornendo contenuti di qualità che ispirano e informano.

Questo viaggio è destinato a proseguire, e ogni lettore è invitato a farne parte, contribuendo a un dialogo sempre più ricco e significativo sull’intelligenza artificiale e sul suo ruolo nella nostra vita.

Se non volete perdervi gli ultimi articoli e sempre che non l’abbiate già fatto, potete iscrivervi alla newsletter di Rivista.AI per rimanere sempre aggiornati sulle ultime novità sul mondo dell’intelligenza artificiale, con contenuti esclusivi direttamente nella vostra casella di posta.

L’efficienza energetica dei linguaggi di programmazione è un aspetto sempre più rilevante nello sviluppo software, con impatti significativi sulla sostenibilità ambientale. I linguaggi compilati, come C, Rust e C++, si rivelano tra i più efficienti, mentre i linguaggi interpretati, come Python e Ruby, tendono a consumare notevolmente più energia.

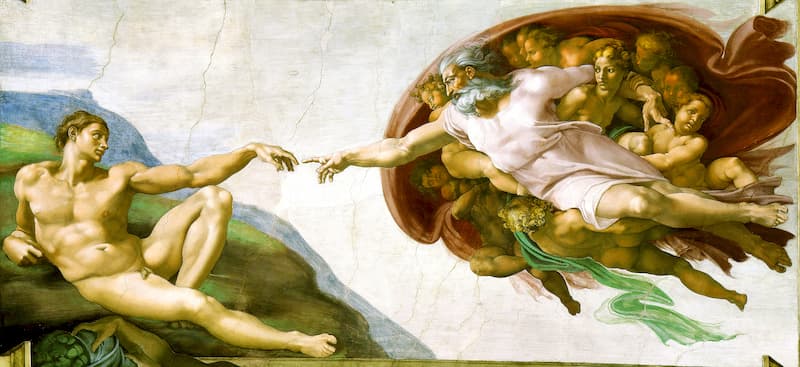

Nel vasto e affascinante campo della scienza e della tecnologia, poche aree sono così avvincenti e ricche di possibilità come quella della simulazione dell’origine della vita. Recentemente, Google ha annunciato un avanzamento significativo in questo settore, utilizzando l’intelligenza artificiale (IA) per simulare i primi momenti della vita sulla Terra.

Questa iniziativa rappresenta non solo un passo avanti nell’IA, ma anche un contributo fondamentale alla nostra comprensione delle origini biologiche.

Secondo EURACTIV, la presidente della Commissione europea Ursula von der Leyen ha sostenuto un grande investimento per creare un centro di ricerca e innovazione sull’intelligenza artificiale, simile al CERN per la ricerca nucleare.

La proposta di un “CERN per l’IA” è nata dalle difficoltà dell’Europa nel tenere il passo con i progressi dell’IA, dovute alla mancanza di scala e attenzione nella sua strategia di IA.

Dal lancio della strategia “AI made in Europe” nel 2020, l’Europa è rimasta indietro rispetto ai concorrenti, senza un impatto globale significativo nello sviluppo dell’IA. Questo ritardo ha reso l’Europa dipendente dalla tecnologia IA straniera, indebolendo la sua sovranità economica, culturale e geopolitica.

La crescente domanda di energia necessaria per alimentare l’intelligenza artificiale (IA) è una preoccupazione, ma la tecnologia stessa potrebbe offrire soluzioni.

Secondo l’Agenzia Internazionale per l’Energia, il consumo di elettricità dei data center potrebbe raddoppiare entro il 2026 rispetto al 2022, quando rappresentava il 2% dell’elettricità mondiale. Tuttavia, l’IA sta anche creando efficienze energetiche in altri settori, potenzialmente compensando il suo alto consumo energetico.

Il Senato degli Stati Uniti ha approvato all’unanimità il DEFIANCE Act, una legge per combattere la pornografia deepfake non consensuale. Permette alle vittime di citare in giudizio i creatori e i distributori per danni fino a $150.000.

Questa legge arriva mentre gli stati stanno adottando misure simili per affrontare la minaccia dei contenuti espliciti generati dall’intelligenza artificiale e il loro potenziale sfruttamento e interferenza elettorale.

Domani, il sindacato SAG-AFTRA (160.000 tesserati) avvierà uno sciopero che coinvolgerà attori e performer dei videogiochi, una decisione che arriva dopo quasi due anni di trattative senza successo con le aziende del settore.

Apple si è unita ad altre aziende tecnologiche per aderire alle protezioni volontarie dell’amministrazione Biden sullo sviluppo dell’intelligenza artificiale e la protezione dei consumatori, ha annunciato la Casa Bianca venerdì.

I ricercatori del College of Health and Human Performance dell’Università della Florida hanno sviluppato un sistema di intelligenza artificiale che monitora la progressione del morbo di Parkinson attraverso le registrazioni dei movimenti delle mani dei pazienti.

Cari lettori spesso la Tecnologia si intreccia con la Finanza, ne vogliamo parlare come sempre davanti a un caffe’ al nostro appuntamento al Bar dei Daini.

Chi è il favorito alle prossime elezioni presidenziali Usa tra Donald Trump e Kamala Harris? Diversi chatbot, tra cui Perplexity, ChatGPT, Grok e Claude AI hanno espresso le loro opinioni basate su dati e sondaggi attuali. Vediamoli insieme.

Secondo Daron Acemoglu, professore presso il MIT, solo circa un quarto dei compiti per i quali è possibile ricorrere all’intelligenza artificiale potrebbero rivelarsi economicamente vantaggiosi nel prossimo decennio.

In un’intervista al podcast Goldman Sachs Exchanges, Acemoglu ha affermato che, nonostante le grandi innovazioni nell’intelligenza artificiale, gli effetti saranno visibili solo dopo diversi anni.

Cari Lettori spesso la Politica si intreccia con la Tecnologia. Pochi giorni dopo il tentato attentato alla sua vita, Donald Trump continua a essere al centro del dibattito negli Stati Uniti. Ha recentemente annunciato il suo candidato alla vicepresidenza in caso di vittoria: J.D. Vance.

Hiroshima e Nagasaki non sono note per la loro particolare religiosità, ma piuttosto per essere state vittime di devastanti bombardamenti atomici da parte degli Stati Uniti durante la Seconda Guerra Mondiale.

Hiroshima è stata scelta come sede simbolica per l’evento “AI Ethics for Peace: World Religions commit to the Rome Call”, che ha riunito leader religiosi di tutto il mondo per firmare la “Rome Call for AI Ethics”

Nel “disordine mondiale”, che cresce progressivamente sotto i nostri occhi, con equilibri geopolitici in rapido mutamento, per provare a capire quello che sta accadendo a livello globale serve una guida per orientarsi. Una guida efficace e illuminante può essere il nuovo libro di Giampiero Massolo, “Realpolitik“, scritto con Francesco Bechis ed edito da Solferino.