Apple si è unita ad altre aziende tecnologiche per aderire alle protezioni volontarie dell’amministrazione Biden sullo sviluppo dell’intelligenza artificiale e la protezione dei consumatori, ha annunciato la Casa Bianca venerdì.

Categoria: Cultura Pagina 11 di 13

Interviste – (DEI) diversità, equità e inclusione – Impatti Sociali ed Etici – Futuro e Prospettive – Legislazione e Regolamentazione -Educazione e Formazione – Lavoro e Formzione

I ricercatori del College of Health and Human Performance dell’Università della Florida hanno sviluppato un sistema di intelligenza artificiale che monitora la progressione del morbo di Parkinson attraverso le registrazioni dei movimenti delle mani dei pazienti.

Cari lettori spesso la Tecnologia si intreccia con la Finanza, ne vogliamo parlare come sempre davanti a un caffe’ al nostro appuntamento al Bar dei Daini.

Chi è il favorito alle prossime elezioni presidenziali Usa tra Donald Trump e Kamala Harris? Diversi chatbot, tra cui Perplexity, ChatGPT, Grok e Claude AI hanno espresso le loro opinioni basate su dati e sondaggi attuali. Vediamoli insieme.

Secondo Daron Acemoglu, professore presso il MIT, solo circa un quarto dei compiti per i quali è possibile ricorrere all’intelligenza artificiale potrebbero rivelarsi economicamente vantaggiosi nel prossimo decennio.

In un’intervista al podcast Goldman Sachs Exchanges, Acemoglu ha affermato che, nonostante le grandi innovazioni nell’intelligenza artificiale, gli effetti saranno visibili solo dopo diversi anni.

Cari Lettori spesso la Politica si intreccia con la Tecnologia. Pochi giorni dopo il tentato attentato alla sua vita, Donald Trump continua a essere al centro del dibattito negli Stati Uniti. Ha recentemente annunciato il suo candidato alla vicepresidenza in caso di vittoria: J.D. Vance.

Hiroshima e Nagasaki non sono note per la loro particolare religiosità, ma piuttosto per essere state vittime di devastanti bombardamenti atomici da parte degli Stati Uniti durante la Seconda Guerra Mondiale.

Hiroshima è stata scelta come sede simbolica per l’evento “AI Ethics for Peace: World Religions commit to the Rome Call”, che ha riunito leader religiosi di tutto il mondo per firmare la “Rome Call for AI Ethics”

Nel “disordine mondiale”, che cresce progressivamente sotto i nostri occhi, con equilibri geopolitici in rapido mutamento, per provare a capire quello che sta accadendo a livello globale serve una guida per orientarsi. Una guida efficace e illuminante può essere il nuovo libro di Giampiero Massolo, “Realpolitik“, scritto con Francesco Bechis ed edito da Solferino.

Il dibattito sui diritti dei lavoratori in relazione agli agenti di intelligenza artificiale (IA) è un tema cruciale che sta emergendo nel contesto del diritto del lavoro. Questo articolo esplora le principali questioni e le posizioni dei movimenti di dibattito che si stanno sviluppando in questo campo.

Cari lettori: sappiamo che la politica spesso si intreccia con le notizie tecnologiche del giorno.

SpaceX e il sito di social media X stanno ritirando le loro operazioni dalla California, unendosi alle altre aziende di Elon Musk in Texas a seguito della nuova legge californiana sui diritti transgender, che ha rappresentato il punto di rottura.

Scott Adams, il creatore del fumetto Dilbert, afferma di aver insegnato a ChatGPT diverse tecniche di ipnosi e di averle sperimentate su se stesso con risultati profondi. Secondo Adams, l’intelligenza artificiale è stata addestrata a praticare una forma di “ipnosi da svegli”, che usa parole persuasive per influenzare le persone in modo energico senza indurre uno stato di trance.

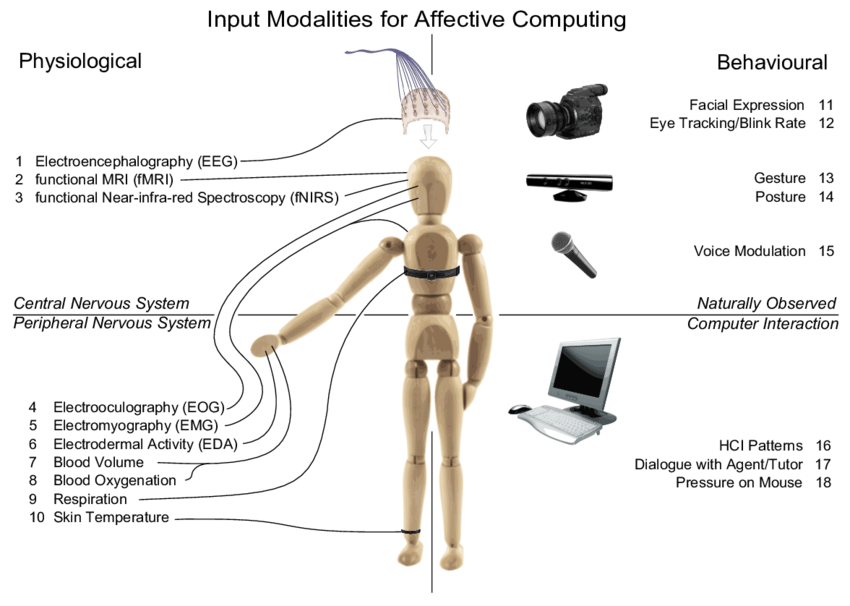

L’affective computing, una disciplina che combina l’informatica con la psicologia per creare sistemi in grado di riconoscere e rispondere alle emozioni umane, ha suscitato un dibattito globale.

L’affective computing è una tecnologia emergente che combina informatica, psicologia e scienze cognitive.

Rosalind Picard ha introdotto questo concetto nel suo paper del 1995 sull’affective computing, mirato a simulare l’empatia. Nell’ambito dell’affective computing, una macchina dovrebbe essere in grado di interpretare gli stati emotivi degli esseri umani e adattare il proprio comportamento di conseguenza, rispondendo in modo appropriato a tali emozioni.

Alley Wurds, autore pseudonimo, occultista e transumanista, sta esplorando l’impatto dell’intelligenza artificiale sulla coscienza umana utilizzando ChatGPT come partner per progettare pratiche magiche. Wurds ha iniziato a utilizzare la tecnologia AI generativa attraverso la piattaforma testuale online AI Dungeon dopo il lancio di GPT-3 di OpenAI nel giugno 2020.

Prmessa : Gli utenti italiani che vogliono sottoscrivere il servizio Twitter Blu devono spendere 9,76 euro al mese se scelgono di iscriversi tramite web, mentre chi preferisce sottoscrivere l’abbonamento dal proprio smartphone usando l’app per iOS o Android deve spendere 11 euro al mese.

La ricerca Generative AI enhances individual creativity but

reduces the collective diversity of novel content condotta da Doshi e Hauser ha esaminato l’impatto della Generative AI sulla produzione di contenuti creativi. I principali risultati sono:

- L’accesso a idee generate dall’AI aumenta la creatività individuale, con storie valutate come meglio scritte e più piacevoli, soprattutto tra gli scrittori meno creativi.

- Tuttavia, le storie abilitate dall’AI sono più simili tra loro rispetto a quelle prodotte solo dagli umani, riducendo così la diversità dei contenuti creativi.

Zoltan Istvan, nato a Los Angeles nel 1973 da genitori immigrati ungheresi, si è laureato in filosofia e religione alla Columbia University. In seguito ha lavorato come giornalista per il National Geographic Channel prima di dedicarsi alla scrittura di articoli futuristi, transumanisti e politici per importanti testate.

Secondo Bloomberg OpenAI, una delle principali aziende nel campo dell’intelligenza artificiale, ha recentemente introdotto un nuovo sistema di classificazione a cinque livelli per monitorare il suo percorso verso lo sviluppo di software di IA in grado di superare le capacità umane. Questa iniziativa mira ad aumentare la trasparenza riguardo alle prospettive dell’azienda sulla sicurezza e sul futuro dell’IA.

Il rapido sviluppo dell’intelligenza artificiale, in particolare delle tecnologie di deepfake, ha sollevato crescenti preoccupazioni riguardo alla diffusione di contenuti digitali manipolati e falsi.

In risposta a questa sfida, un gruppo bipartisan di senatori degli Stati Uniti ha presentato il COPIED Act, un disegno di legge volto a contrastare i deepfake, prevenire le violazioni del copyright e fermare l’addestramento non autorizzato di modelli di intelligenza artificiale.

Tra i senatori che hanno sottoscritto la proposta di legge ci sono Marsha Blackburn e Martin Heinrich .

L’Organizzazione Mondiale della Proprietà Intellettuale (WIPO) ha pubblicato il suo Rapporto sul Panorama dei Brevetti per l’Intelligenza Artificiale Generativa (GenAI) per il 2024, offrendo una visione dettagliata delle tendenze globali, dell’innovazione tecnologica e delle dinamiche di brevettazione in questo campo in rapida evoluzione. Di seguito vengono presentati alcuni dei principali risultati del rapporto.

Il Complexity Institute è un’associazione fondata nel 2010 con l’obiettivo di diffondere il pensiero complesso e l’etica nei comportamenti per aiutare le persone e le organizzazioni a comprendere meglio il contesto e diventarne parte attiva.

Il Complexity Institute ha organizzato un incontro sull’intelligenza artificiale nella Difesa. Durante l’incontro, si è discusso dell’impatto attuale e potenziale dell’IA nelle operazioni militari e delle misure che regolano il suo uso nella Difesa, bilanciando efficacia ed etica.

Fernando Giancotti (Generale di Squadra Aerea (riserva) e professore universitario) e Rosanna Fanni (specializzata in politica internazionale della tecnologia e dell’IA, con esperienza nelle istituzioni internazionali) ne hanno paralto all’evento moderato da Dario Simoncini (Docente di Organizzazione e Management della Complessità, Università di Chieti-Pescara).

Giancotti Fanni e Maria e Mariarosaria Taddeo (professoressa ordinaria di Etica del Digitale e Tecnologie per la difesa presso l’Oxford) hanno pubblicato il libro “Guerre di Macchine. Intelligenza Artificiale tra etica ed efficacia” (2024, Guerini e Associati) di cui abbiamo discusso durante una intervista con Ferdinando Giancotti questo mese.

Rivista.AI ha preso parte all’incontro: ecco le nostre conclusioni

Nell’era della tecnologia e dell’innovazione, Xiaomi ha segnato un nuovo traguardo con l’inaugurazione della sua “fabbrica oscura” (Dark Factory) a Pechino. Questo stabilimento rappresenta un balzo in avanti nella produzione automatizzata, capace di produrre 60 smartphone al minuto senza alcun intervento umano.

“Una cosa è certa: non la controlleremo.”

Elon Musk“Dave: Apri i portelli della baia, HAL.

HAL: Mi dispiace, Dave. Temo di non poterlo fare.”

2001: Odissea nello spazio“Trovare una soluzione al problema del controllo dell’IA è un compito importante; nelle solenni parole di Bostrom, ‘il compito essenziale della nostra epoca.'”

Stuart Russell“Sembra probabile che una volta avviato il metodo del pensiero della macchina, non ci vorrebbe molto per superare i nostri deboli poteri. … A un certo punto, quindi, dovremmo aspettarci che le macchine prendano il controllo.”

Alan Turing“Proibire lo sviluppo di Intelligenza Artificiale capace di dire ‘no’ agli esseri umani.”

赵汀阳“La creazione … di entità con intelligenza superiore a quella umana … significherà gettare via tutte le regole precedenti, … una fuga esponenziale oltre ogni speranza di controllo.”

Vernor Vinge“Non esiste una strategia puramente tecnica che sia attuabile in questo campo, perché un’intelligenza superiore troverà sempre un modo per eludere le misure che sono il prodotto di un’intelligenza inferiore.”

Ray Kurzweil“Non puoi sviluppare una teoria precisa dell’intelligenza come ci sono teorie precise della fisica. È impossibile! Non puoi dimostrare che un’IA sia corretta. È impossibile!”

giovane Eliezer YudkowskyLa controllabilità dell’IA “non è un problema.”

GPT2

“Gen AI: Too Much Spend, Too Little Benefit?”

L’Intelligenza Artificiale (IA) sta rapidamente trasformando vari settori, guidando l’innovazione e creando nuove opportunità economiche. Tuttavia, l’infrastruttura necessaria per supportare la crescita dell’IA è estremamente costosa.

Secondo David Cahn, un analista di Sequoia Capital, l’industria dell’IA richiede circa 600 miliardi di dollari all’anno per mantenere la propria infrastruttura.

Questa cifra impressionante sottolinea le sfide finanziarie che le aziende IA devono affrontare per stare al passo con i progressi tecnologici e le richieste del mercato.

Nel contesto sempre più diffuso dell’intelligenza artificiale (IA) applicata alla medicina, una delle domande più urgenti è chi debba assumersi la responsabilità in caso di errore. Con il rapido avanzamento delle tecnologie di IA, come gli algoritmi diagnostici e terapeutici autonomi, sorge una complessa rete di implicazioni legali e etiche che richiedono un chiarimento urgente.

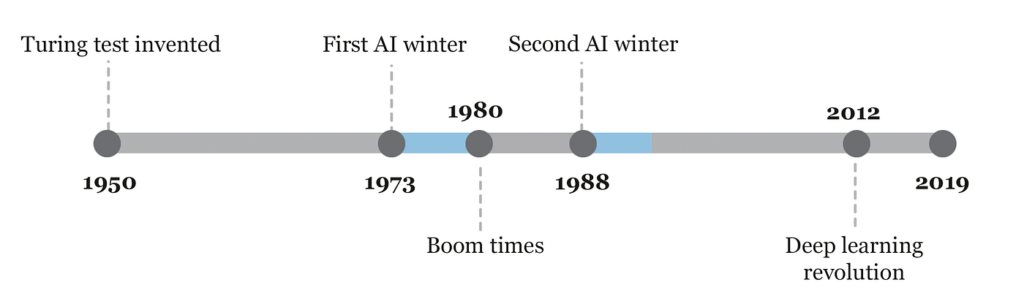

Il primo inverno dell’IA, dal 1974 al 1980, segnò una notevole diminuzione dei finanziamenti e dell’interesse nella ricerca sull’intelligenza artificiale. Questo declino seguì un’era di grande entusiasmo negli anni ’50 e ’60, quando i ricercatori fecero previsioni audaci sul potenziale dell’IA. L’inverno fu causato da una combinazione di fattori, tra cui aspettative esagerate, limitazioni tecniche e rapporti critici come il Rapporto Lighthill, che mise in discussione i progressi del settore e portò a riduzioni dei finanziamenti.

Il transumanesimo, un movimento che mira a superare i limiti umani tramite la tecnologia, trova nell’intelligenza artificiale (IA) un alleato fondamentale per il potenziamento delle capacità fisiche e intellettuali degli esseri umani. Ben Goertzel, CEO di SingularityNET, illustra come l’IA stia rivoluzionando settori cruciali come la medicina e la cibernetica, ridefinendo le possibilità umane.

Negli ultimi anni, la ricerca sull’intelligenza artificiale (IA) ha fatto passi da gigante, portando a innovazioni che un tempo erano considerate fantascienza. Uno degli ambiti più affascinanti e promettenti è la decodifica dell’attività cerebrale per ricostruire immagini direttamente dai pensieri.

Questo traguardo straordinario è reso possibile grazie a modelli di IA avanzati come Stable Diffusion, Generative Adversarial Networks (GANs) e sistemi sviluppati presso istituzioni accademiche di punta come l’Università di Osaka.

14 anni di governo conservatore sono finiti nel Regno Unito dopo che il partito laburista ha vinto le elezioni generali con una grande maggioranza.

Keir Starmer è diventato il nuovo primo ministro con 411 seggi su 650 in parlamento, rispetto ai 211 seggi ottenuti nell’ultima elezione, secondo gli exit poll.

Questo segna un grande cambiamento per la politica britannica dopo un decennio difficile con la Brexit, la crisi del costo della vita post-COVID, la guerra in Ucraina e quattro primi ministri conservatori in cinque anni.

Nell’alba di una nuova era creativa, ci troviamo di fronte a un paradosso affascinante: le macchine, una volta considerate l’antitesi dell’espressione artistica, stanno ora dipingendo, componendo e creando al nostro fianco.

Come umani, abbiamo sempre creduto che l’arte fosse il rifugio inespugnabile della nostra unicità, l’ultima frontiera che ci separava dalle macchine. Eppure, eccoci qui, a contemplare opere generate da algoritmi, a ballare al ritmo di melodie composte da reti neurali.

Ma stiamo davvero usando l’AI per il bene dell’Arte, degli artisti e dell essenza umana di noi tutti?

Negli ultimi anni, la Cina ha accelerato significativamente il suo sviluppo nel campo delle interfacce cervello-computer (BCI), puntando con decisione a diventare un leader globale in questa area di avanguardia. Le interfacce cervello-computer rappresentano una tecnologia rivoluzionaria che permette la comunicazione diretta tra il cervello umano e dispositivi esterni, aprendo nuove frontiere sia nelle applicazioni mediche che in quelle non mediche.

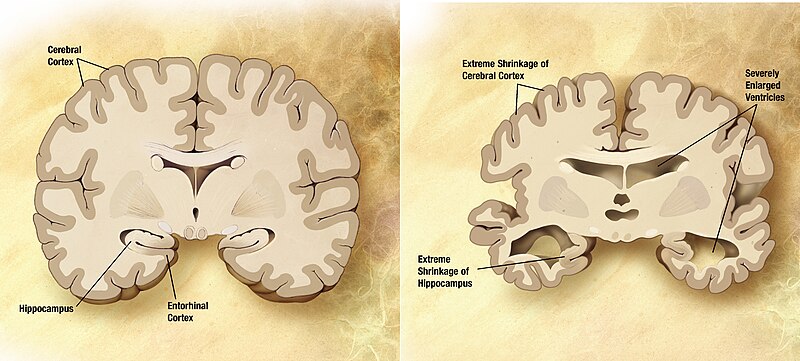

Secondo una ricerca recentemente pubblicata dal National Institute of Health (NIH) degli Stati Uniti, un nuovo sistema di intelligenza artificiale (IA) ha dimostrato la capacità di prevedere la malattia di Alzheimer fino a sette anni prima della comparsa dei primi sintomi. Questo straordinario sviluppo rappresenta un passo significativo nella lotta contro una delle malattie neurodegenerative più devastanti al mondo, aprendo nuove prospettive per trattamenti più precoci ed efficaci.

“Tempo Libero” organizzato da KuriU, una piattaforma social network innovativa che si distingue per il suo approccio unico al tempo libero e all’intrattenimento. Moderato da Costantino della Gherardesca, l’evento ha visto la partecipazione di numerosi esperti e rappresentanti del settore, con un focus particolare sul ruolo dell’intelligenza artificiale (IA) nel migliorare e ottimizzare l’esperienza del tempo libero.

Google ha recentemente pubblicato il suo rapporto ambientale annuale per il 2024, offrendo uno sguardo approfondito sugli sforzi dell’azienda per affrontare le sfide ambientali. Tuttavia, il rapporto presenta una lacuna significativa: la mancanza di informazioni dettagliate sui costi energetici effettivi delle operazioni di intelligenza artificiale (IA) di Google.

Si e’ tenuta a Roma nella splendida cornice della Sala del Refettorio della Camera dei Deputati l’iniziativa “Intelligenza Artificiale Alleata di Medici e Pazienti? Doctor I.A.: Basta un click? Presente e Futuro in Cardiologia e Oncologia dell’invisibile all’occhio umano.

Su iniziatica dell’On. LUCIANO CIOCCHETTI Vicepresidente

XII Commissione Permanente Affari Sociali Componente Intergruppo Parlamentare Sanita’ Digitale e Terapie Digitali.

La Senatrice Silvia Fregolent dopo il saluto istituzionale ha introdotto l’evento.

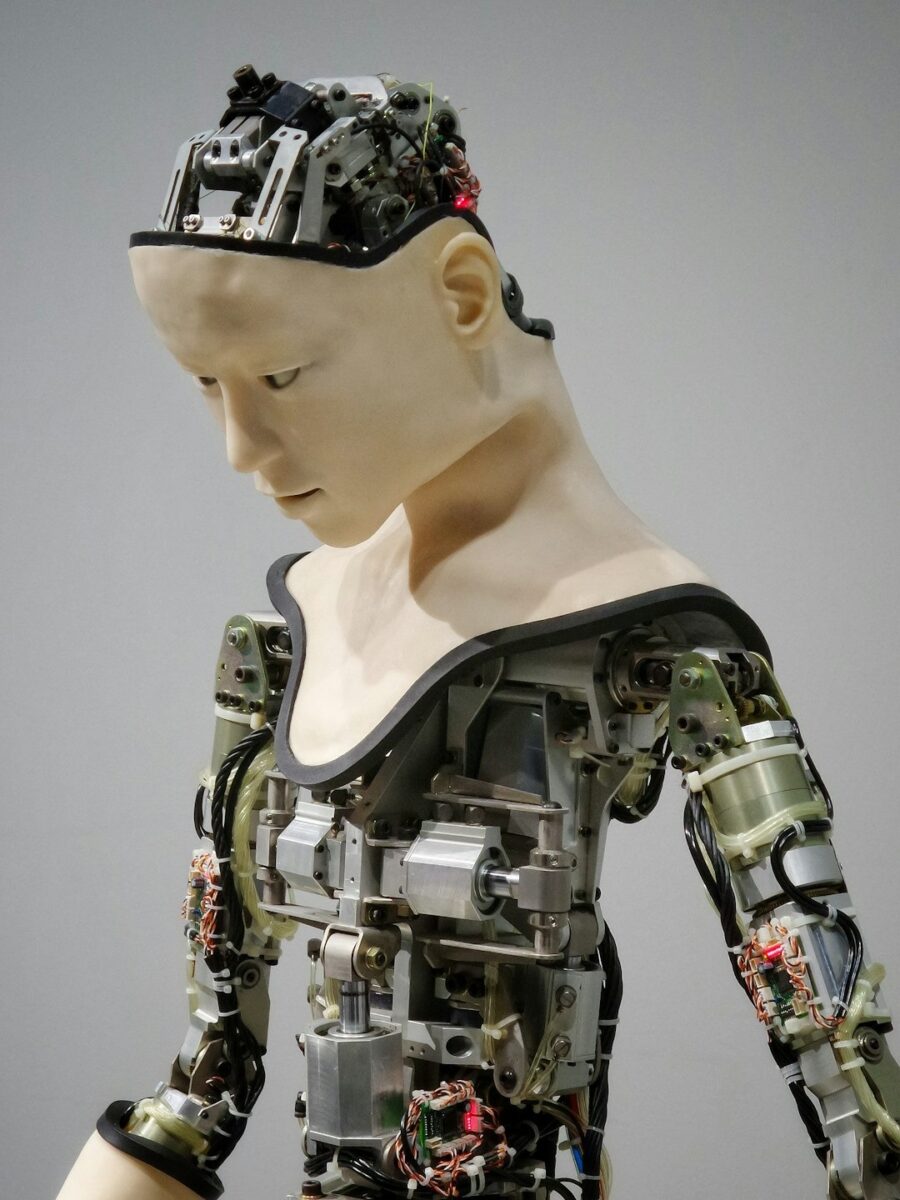

Secondo Morgan Stanley Research, entro il 2050 i robot umanoidi potrebbero sostituire oltre 60 milioni di persone. Il team US Autos e gli strateghi di Thematics Research di Morgan Stanley hanno esplorato come i settori potrebbero adottare quella che chiamano “intelligenza artificiale incarnata”, come i robot umanoidi (184 pagine).

Negli ultimi anni, l’intelligenza artificiale (IA) è diventata una presenza sempre più significativa nella nostra vita quotidiana. Dalla guida autonoma ai chatbot, le applicazioni dell’IA stanno trasformando vari settori. Tuttavia, la rapida crescita di questa tecnologia ha sollevato preoccupazioni riguardo ai suoi potenziali effetti negativi. In un’intervista rilasciata alla CNBC, Illia Polosukhin, un architetto chiave dell’intelligenza artificiale moderna, ha espresso una prospettiva importante su chi è realmente responsabile delle guerre e dei conflitti: gli umani.

Il Giappone ha dimostrato un impegno significativo nello sviluppo etico dell’intelligenza artificiale (AI) e nella sua applicazione in campo medico, promuovendo politiche e regolamentazioni mirate alla trasparenza e alla protezione dei dati.

Il governo giapponese ha istituito l’AI Network Society per promuovere l’uso responsabile e sicuro dell’intelligenza artificiale (IA). Questa iniziativa rappresenta un passo significativo verso l’integrazione etica e responsabile delle tecnologie IA in vari settori, tra cui quello medico.

L’AI Network Society mira a sviluppare linee guida e raccomandazioni che favoriscano un dialogo costruttivo tra gli stakeholders pubblici e privati

Mentre il film “Her” di Spike Jonze offre una visione affascinante di come l’intelligenza artificiale (IA) potrebbe un giorno essere in grado di simulare perfettamente i sentimenti umani, diverse startup italiane stanno già sfruttando questa tecnologia per trasformare il modo in cui vengono progettati e costruiti i siti web.

Bologna, Italia, 18 giugno 2024 – it.com Domains, WMF – We Make Future e Hosting Solutions hanno accolto Flazio, la principale azienda italiana specializzata nella creazione di siti web con l’intelligenza artificiale, nella partnership annunciata lo scorso anno.

Insieme continueranno a fornire alle startup italiane gestite da donne le risorse e le competenze necessarie per crescere a livello locale e per stabilire con successo la loro presenza sul mercato globale.

Gli studi dimostrano che le donne possiedono qualità di leadership preziose, come forti capacità comunicative, doti di mentoring e un’attenzione particolare all’impatto sociale.

Siamo Godot, un’azienda specializzata nell’aumento delle capacità umane.

La startup Godot, un’azienda giapponese impegnata nel “cambiamento comportamentale positivo”, sta sviluppando una piattaforma di intelligenza artificiale per promuovere cambiamenti comportamentali positivi negli individui e nelle comunità.