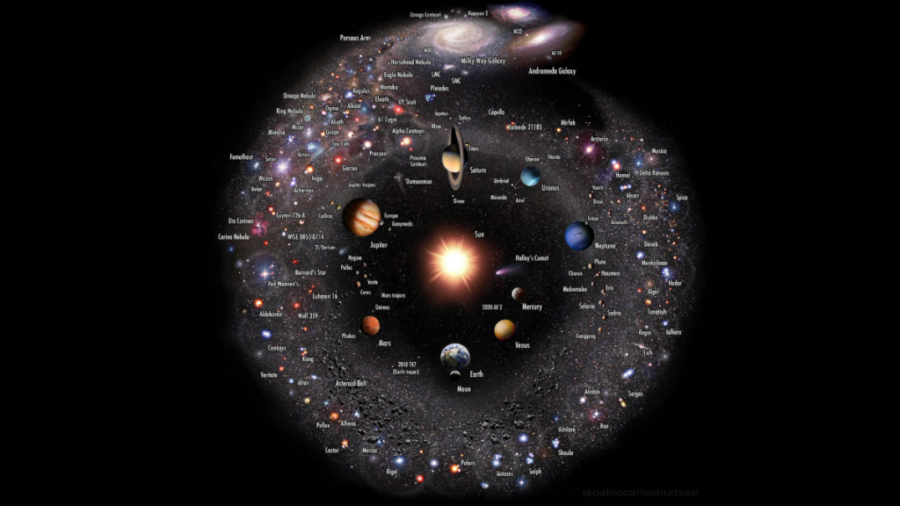

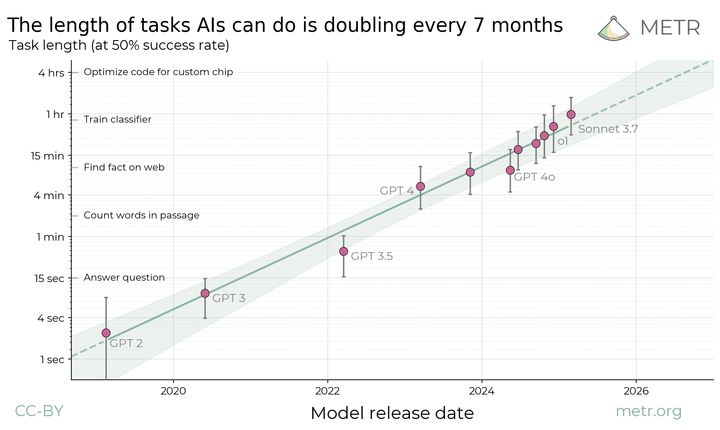

L’universo. Quel posto affascinante e inospitale che da miliardi di anni si diverte a produrre galassie, stelle, frittate e imprenditori tech. Secondo una nuova teoria, potrebbe esserci un principio universale che spinge tutto, vivente o meno, a diventare sempre più complesso. Non per scelta, non per gusto estetico, ma perché è nella natura stessa della realtà. E no, non è una provocazione filosofica da bar: parliamo di fisica teorica, quella che solitamente vive sospesa tra il sublime e l’indimostrabile.

La provocazione è elegante: esiste una sorta di freccia del tempo della complessità, un’evoluzione non solo biologica, ma sistemica, strutturale, cosmica. Se i sistemi complessi tendono a diventare ancora più complessi col tempo, allora l’evoluzione della vita è solo una manifestazione locale e parziale di un principio molto più ampio. Non è darwinismo, è cosmologismo.