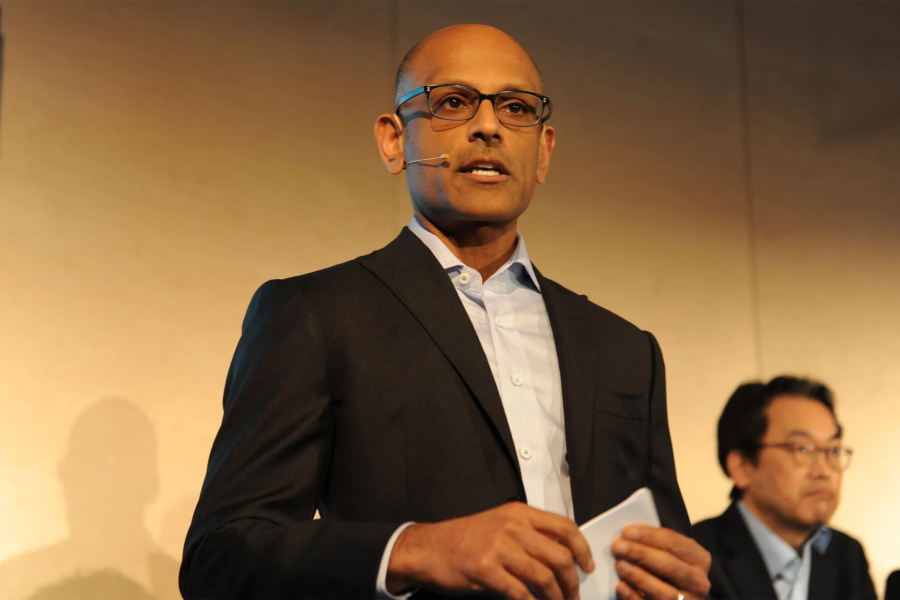

Satya Nadella, CEO di Microsoft, ha dimostrato ancora una volta la sua capacità di sintetizzare idee complesse e proiettare una visione audace per il futuro tecnologico durante il keynote di Microsoft Ignite 2024. La sua presentazione, incentrata sull’AI come strumento trasformativo, ha suscitato riflessioni profonde, non solo per le innovazioni che promette ma anche per le domande filosofiche che solleva.

Categoria: Vision Pagina 2 di 3

L’intelligenza artificiale rendera’ al massimo quando i processi saranno sviluppati in funzione di essa e non viceversa

Il governo giapponese ha annunciato un investimento significativo di circa 200 miliardi di yen (1,28 miliardi di dollari) previsto per il 2025 a favore di Rapidus, un consorzio nato per rilanciare la posizione del Giappone nel settore dei semiconduttori. L’obiettivo principale è l’avvio della produzione di chip avanzati a 2 nanometri, un passo avanti strategico per competere con i giganti globali come TSMC e Samsung.

Microsoft Ignite 2024 ha dimostrato ancora una volta come il colosso tecnologico continui a spingere i confini dell’innovazione nell’ambito dell’intelligenza artificiale (AI). Con una serie di annunci strategici, partnership mirate e soluzioni basate su AI, Microsoft conferma il suo ruolo di protagonista in un settore che promette enormi opportunità di investimento.

Xavier Niel, uno degli investitori tecnologici più influenti in Europa, crede fermamente che il continente abbia il potenziale per creare aziende leader nel settore dell’intelligenza artificiale (AI) senza dover competere direttamente con i miliardi di dollari raccolti dai colossi statunitensi. Per lui, la chiave del successo europeo risiede nell’innovazione strategica e nella determinazione dei fondatori a resistere alla tentazione di vendere le proprie aziende troppo presto.

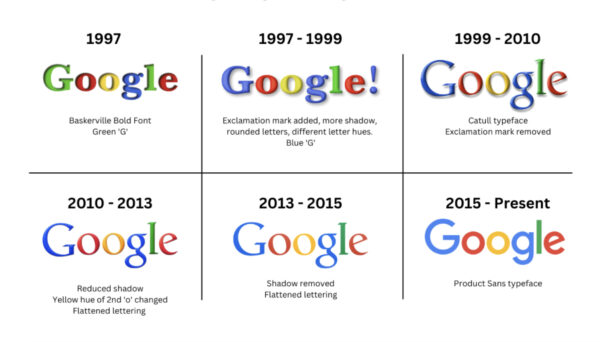

A partire dal lancio di ChatGPT di OpenAI alla fine del 2022, l’intelligenza artificiale generativa (GenAI) ha catturato l’attenzione globale, segnando l’inizio di una competizione senza precedenti nel settore tecnologico. Giganti come Microsoft, Google, Meta Platforms, Apple , Amazon e una miriade di startup si sono affrettati a dimostrare le proprie competenze tecniche in questo campo.

Secondo un recente studio di Morgan Stanley, la crescita di questa tecnologia potrebbe seguire un percorso analogo a quello che Facebook ha tracciato durante la sua ascesa nel 2009, quando divenne un fenomeno globale.

Negli ultimi decenni, l’intelligenza artificiale ha attraversato una profonda trasformazione. Durante gli anni 2010, il focus principale è stato sull’espansione delle risorse computazionali e sull’ottimizzazione dei modelli per ottenere risultati tangibili e applicabili. Ora, però, siamo entrati in una nuova era, quella della scoperta e della meraviglia, dove il concetto di “ridimensionamento” assume un significato più sofisticato e sfaccettato.

Il recente rapporto di Bloomberg che evidenzia le difficoltà di Google e Anthropic nel superare i limiti delle prestazioni dei loro modelli di linguaggio (LLM) mette in luce una sfida fondamentale nel settore dell’intelligenza artificiale. Un problema che ricorda quello affrontato da OpenAI con l’espansione dei suoi modelli, le due aziende stanno riscontrando ostacoli nel migliorare le capacità dei loro LLM, spingendoli oltre i confini che sembrano aver raggiunto. In particolare, la versione futura del modello Gemini di Google non ha soddisfatto le aspettative interne, una situazione simile a quella vissuta da Anthropic con i suoi modelli Claude. Tali difficoltà non sono un problema esclusivo di Google e Anthropic; l’intero settore sembra confrontarsi con limiti intrinseci nel tentativo di far evolvere i modelli di AI verso un livello superiore di prestazioni.

Nel panorama tecnologico in continua evoluzione, OpenAI si trova ora ad affrontare un punto di svolta che potrebbe ridisegnare il futuro delle sue operazioni. L’azienda, un pioniere nel campo dell’intelligenza artificiale generativa, sta adottando una nuova strategia in risposta a una crescente consapevolezza che il ritmo dei miglioramenti nei modelli di linguaggio come GPT (Generative Pretrained Transformer) sta rallentando rispetto alle aspettative degli sviluppatori, degli investitori e degli utenti finali.

Il fenomeno di rallentamento nella performance e nelle capacità dei modelli GPT non è un evento isolato, ma un riflesso della difficoltà intrinseca nel migliorare continuamente un sistema altamente sofisticato come quello che sta alla base delle attuali applicazioni di AI. Sebbene la crescita dei modelli GPT sia stata straordinaria negli ultimi anni, con miglioramenti significativi nelle capacità di generazione del linguaggio, la curva dei progressi sembra ora aver raggiunto una fase di stagnazione, costringendo OpenAI a rivalutare la propria direzione.

L’annuncio su LinkedIn di Mike Verdu, ex Vicepresidente dei Giochi di Netflix, segna un cambio di rotta strategico significativo per il gigante dello streaming. Verdu, ora Vicepresidente per l’Intelligenza Artificiale Generativa applicata ai giochi, ha svelato la sua nuova missione: un approccio all’IA che mette i creativi al centro, trasformando l’IA generativa in uno strumento rivoluzionario per lo sviluppo dei giochi.

OpenAI, sostenuta da Microsoft, ha effettuato una mossa strategica significativa con l’assunzione di Caitlin “CK” Kalinowski, ex capo dell’iniziativa sugli occhiali di realtà aumentata Orion di Meta Platforms. Kalinowski guiderà gli sforzi dell’azienda nel campo della robotica e dell’hardware consumer, sottolineando un impegno chiaro nell’integrare l’intelligenza artificiale con la tecnologia fisica. Questa decisione non solo potenzia le capacità tecnologiche di OpenAI, ma segnala anche un’ambizione più ampia di coniugare l’IA con prodotti tangibili che possano avere un impatto profondo sulla vita quotidiana.

L’Illuminismo, con il suo focus sulla ragione e sulla scienza, ha promosso l’idea che il sapere dovesse essere universale, accessibile e libero dalle restrizioni della censura o del controllo religioso. Filosofi come Voltaire, Rousseau e Kant sostenevano che la conoscenza fosse un diritto naturale e non una concessione delle autorità. Allo stesso modo, il “diritto all’apprendimento” per le IA incoraggia un accesso libero ai dati e alle informazioni, similmente a come l’Illuminismo ha aperto le porte alla conoscenza scientifica per il bene collettivo.

Il 2025 si preannuncia un anno cruciale per l’evoluzione dell’Intelligenza Artificiale e della data analytics. Ma quali saranno le sfide, le opportunità e le tendenze emergenti che plasmeranno il business e la tecnologia? Un tema centrale sarà senza dubbio la necessità di ridurre la fame di energia dell’AI come pure quello di capire se la gestione della crescente mole di dati saprà effettivamente trasformarsi in un vantaggio competitivo per le aziende. C’è poi il tema dell’hype: l’AI continuerà ad essere sotto i riflettori? Nel caso venisse meno, in che modo questo aspetto potrebbe influenzare l’adozione e la percezione delle tecnologie AI nelle aziende? Ne abbiamo parlato con alcuni Executive di Sas, leader nei sistemi di analytics, Intelligenza Artificiale e data management. Queste sono state le loro previsioni.

Nel vasto e complesso panorama dell’Intelligenza Artificiale, il ruolo di Perplexity come piattaforma indipendente potrebbe rappresentare una delle evoluzioni più strategiche e innovative nel settore. L’idea alla base di Perplexity non si limita a integrare i migliori modelli di linguaggio (LLM) esistenti, ma punta a offrire un’esperienza personalizzata e flessibile, una risorsa che aiuta gli utenti a trarre il massimo valore da strumenti differenti. Perché? Ogni LLM esprime una propria “personalità” e, per chi cerca il meglio, avere accesso a più modelli permette una gamma di risposte che un unico modello non può garantire.

Microsoft ha recentemente annunciato l’assunzione di Jay Parikh, un leader riconosciuto nel settore tecnologico, noto per il suo ruolo significativo come ex responsabile dell’ingegneria di Facebook (ora Meta Platforms) e come CEO della startup di sicurezza informatica Lacework. Questo arrivo rappresenta una strategia mirata dell’azienda per rafforzare la propria leadership tecnologica e innovativa in un panorama sempre più competitivo.

Dropbox ha annunciato la decisione di tagliare 528 posti di lavoro, circa il 20% della sua forza lavoro, giustificandola con il calo della domanda e la complessità organizzativa. Il CEO Drew Houston, in una lettera indirizzata ai dipendenti, ha dichiarato che la società deve affrontare un mercato difficile e ha sottolineato la necessità di snellire la struttura aziendale, eliminando i numerosi livelli gerarchici accumulati nel tempo. Questa mossa segna un momento cruciale per Dropbox, spingendo l’azienda a ripensare il proprio approccio sia a livello di management che di innovazione.

Microsoft sta compiendo un passo significativo nel panorama dell’intelligenza artificiale, portando il suo strumento GitHub Copilot a un nuovo livello di versatilità. Recentemente, la piattaforma per sviluppatori ha annunciato che il suo popolarissimo strumento di coding, inizialmente basato esclusivamente sui modelli di OpenAI, integrerà ora anche modelli provenienti da Anthropic e Google. Questa mossa segna un cambiamento importante nella strategia di Microsoft, riflettendo la crescente domanda degli sviluppatori per una gamma più ampia di opzioni di intelligenza artificiale.

Apple ha finalmente iniziato a implementare aggiornamenti alla sua suite di strumenti basati su intelligenza artificiale per iOS, iPadOS e macOS, come annunciato lunedì. Nonostante la celebrazione da parte dell’azienda tecnologica leader al mondo, le recensioni riguardanti Apple Intelligence non sono state entusiastiche.

L’esperienza con l’intelligenza artificiale, “nella sua forma attuale, è piuttosto piatta”, ha affermato Julian Chokkattu, senior reviews editor di Wired. Ina Fried, corrispondente tecnologico capo di Axios, ha descritto il rilascio preliminare come “miglioramenti modesti che mi hanno lasciato eccitato per il futuro, ma anche impaziente.” Anche il New York Times ha sottolineato che “il tanto pubblicizzato futuro trasformato dall’AI sembra ancora lontano.”

Ora che Apple ha rispettato la scadenza autunnale autoimposta per rilasciare qualcosa di legato all’AI, ha davanti a sé ampio margine per iterare e trasformare il futuro.

Se vuoi raccogliere montagne di denaro, amico mio, dovrai trovare qualche divina ragione. Così, Dario Amodei, il capo di Anthropic, ci ha regalato un fiume di parole, ben 14.000, per raccontarci i modi in cui l’intelligenza artificiale generale (AGI), o come la chiama lui, “potente IA”, trasformerà le nostre vite.

In un blog dal titolo poetico, “Macchine d’Amore Gentile“, (che trovate in calce) dipinge un mondo dove l’IA potrebbe comprimere un secolo di progressi medici in dieci anni, curare malattie mentali come Disturbo da stress post-traumatico e depressione, caricare la tua mente nel cloud e sconfiggere la povertà. Tutto questo, mentre la sua azienda cerca di raccogliere fondi per una valutazione da 40 miliardi di dollari.

Negli ultimi anni, il progresso nell’Intelligenza Artificiale ha iniziato a trasformare ogni settore della società e a riscrivere le regole del conflitto e della sicurezza internazionale. In questo articolo, esploreremo le implicazioni per la Difesa e analizzeremo come il Ministero della Difesa del Regno Unito (MOD UK) stia rivalutando le sue priorità alla luce del rapido sviluppo dell’AI e dell’AGI (Intelligenza Artificiale Generale). Questo tema non riguarda solo il futuro prossimo, ma avrà effetti strategici di vasta portata fino al 2050 e oltre, ridefinendo la natura della guerra e la sicurezza globale.

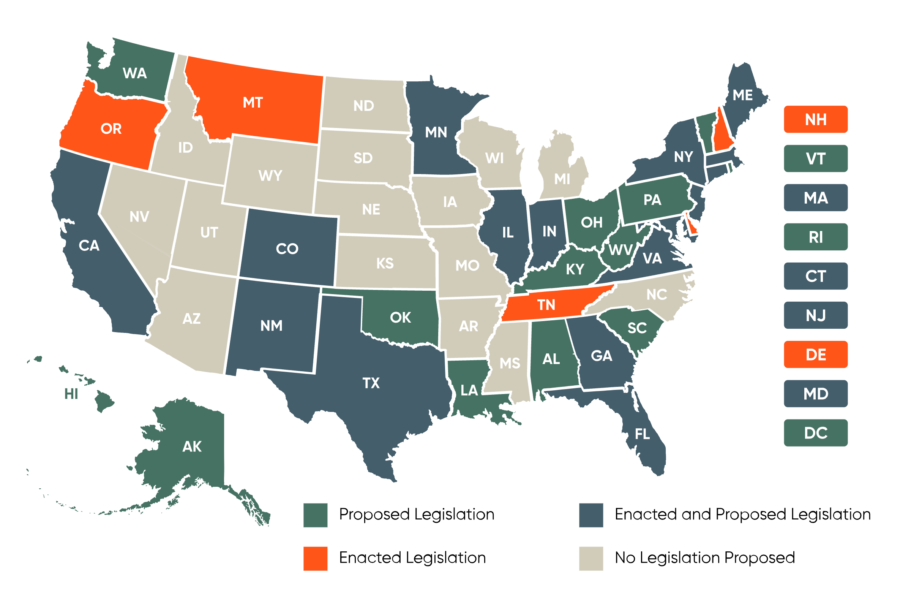

La discussione sulle politiche di intelligenza artificiale (IA) si sta intensificando, con richieste sempre più diffuse per approcci “basati sulle prove”. Questo concetto implica che le decisioni politiche debbano essere informate da analisi empiriche e dati scientifici. Tuttavia, questo articolo evidenzia le tensioni esistenti tra l’esigenza di regole chiare e il rischio di immobilismo decisionale.

Sarah Friar è una figura prominente nel settore tecnologico, con una carriera che si estende per oltre due decenni. Prima di unirsi a OpenAI, ha ricoperto il ruolo di CFO presso Square (ora Block, Inc.), dove ha contribuito a trasformare l’azienda in un leader nel settore dei pagamenti digitali. Durante il suo mandato, ha guidato la società attraverso un’importante IPO e ha gestito le finanze in modo strategico per supportare la crescita.

In precedenza, Friar ha lavorato come Vice President of Finance presso Salesforce, dove ha supervisionato le operazioni finanziarie globali. Ha anche ricoperto ruoli significativi presso Goldman Sachs.

Friar è laureata in Ingegneria Elettrica presso la Stanford University e ha conseguito un MBA presso la Wharton School dell’Università della Pennsylvania. La sua combinazione di competenze tecniche e finanziarie le consente di affrontare le sfide del settore tecnologico con una visione unica e innovativa.

La sua leadership è caratterizzata da un forte impegno verso la diversità e l’inclusione nel posto di lavoro, rendendola una figura rispettata non solo per le sue competenze finanziarie ma anche per il suo approccio etico alla leadership aziendale.

Oggi Sarah Friar, Chief Financial Officer (CFO) di OpenAI, gioca un ruolo fondamentale nel garantire finanziamenti e gestire le relazioni con gli investitori mentre l’azienda naviga in un complesso panorama finanziario. Dalla sua assunzione nel giugno 2024, Friar ha concentrato i suoi sforzi sul miglioramento della comunicazione con gli investitori e sull’enfatizzazione della narrativa finanziaria dell’azienda.

Negli ultimi anni, l’industria dell’intelligenza artificiale (IA) ha visto una crescita esponenziale, con attori come OpenAI e Anthropic che stanno ridefinendo i confini di ciò che è possibile in questo settore in rapida evoluzione. Tuttavia, la sfida di mantenere la leadership tecnologica e commerciale sta diventando sempre più complessa, specialmente per OpenAI, che si trova ad affrontare la concorrenza crescente di nuovi protagonisti. In particolare, Anthropic, un’azienda emergente fondata da ex membri di OpenAI, sta guadagnando terreno rapidamente grazie al suo focus etico e all’innovazione nella sicurezza dell’IA.

Un viaggio attraverso l’ascesa di Noam Shazeer, un visionario che ha trasformato il modo in cui il mondo vede l’intelligenza artificiale, spingendo i confini del possibile e aprendo nuove strade per il futuro del pensiero umano.

Capitolo 1: L’Alba di un’Intuizione

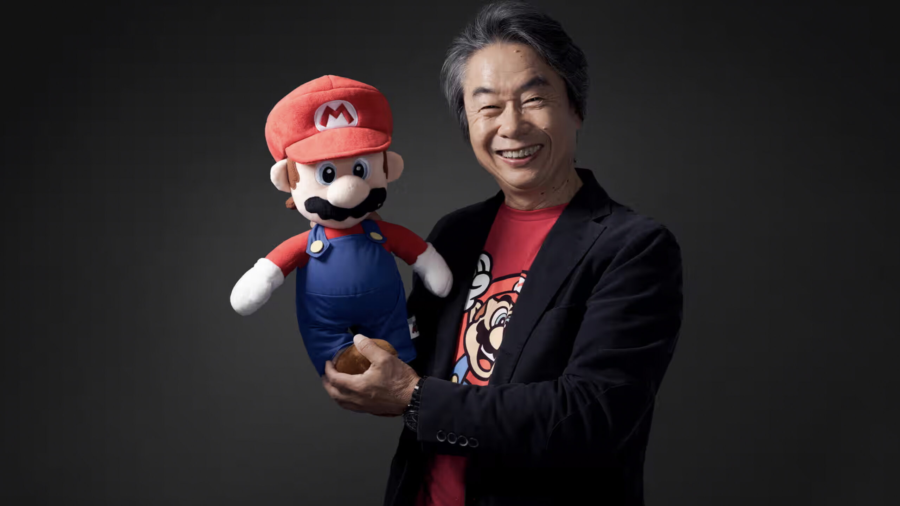

Nell’anno 2035, il mondo del gaming era dominato dall’intelligenza artificiale. Grandi aziende come EA, Nvidia e persino nuovi player del settore spingevano l’uso di AI avanzate per creare mondi virtuali autonomi, dove i giocatori potevano esplorare universi generati in tempo reale, rispondenti a ogni desiderio e decisione. Tuttavia, una voce solitaria si alzava contro questa corsa sfrenata: Shigeru Miyamoto, il leggendario creatore di mondi incantati come Super Mario e The Legend of Zelda.

Negli ultimi anni, l’intelligenza artificiale (AI) ha iniziato a trasformare settori tradizionalmente dominati da approcci scientifici e tecnologie consolidate. Il settore biofarmaceutico, una volta considerato troppo complesso per l’AI, sta sperimentando una rivoluzione alimentata dall’aumento delle capacità computazionali e dai progressi nei metodi di apprendimento automatico (ML). Questo report esplora i principali ambiti in cui l’AI sta avendo un impatto significativo, fornendo un quadro completo delle opportunità e delle sfide che il settore farmaceutico sta affrontando nell’era digitale.

Sam Altman, CEO di OpenAI, e John Elkann, CEO di Exor, hanno partecipato a una discussione stimolante durante la Tech Week italiana 2024. La loro conversazione ha coperto una vasta gamma di argomenti, dall’innovazione e la leadership alle future implicazioni dell’intelligenza artificiale (IA). Ecco alcuni punti chiave dell’intervista che si sono distinti positivamente, così come alcuni che hanno suscitato riflessioni più profonde.

L’intelligenza artificiale (IA) sta subendo un’evoluzione rapida e costante, con progressi che ci avvicinano sempre di più all’Intelligenza Artificiale Generale (AGI), un concetto che descrive un’IA in grado di comprendere, apprendere e svolgere compiti in modo simile all’intelligenza umana.

Un esempio all’avanguardia di questi progressi è il modello GPT-4 di OpenAI, che rappresenta un significativo avanzamento rispetto ai suoi predecessori, come GPT-3 e GPT-3.5.

L’IA presenta significative opportunità, come l’efficienza e l’innovazione economica, ma anche notevoli rischi, tra cui discriminazione algoritmica e decisioni errate. I legislatori stanno cercando di stabilire responsabilità per l’uso sicuro e trasparente dei sistemi di IA, specialmente in contesti decisionali critici come l’occupazione, l’assistenza sanitaria e i servizi finanziari.

OpenAI si prepara a un importante round di finanziamenti, previsto per un importo di 6,5 miliardi di dollari, che potrebbe portare la valutazione della società a 150 miliardi di dollari. Questo round si svolgerà sotto forma di obbligazioni convertibili e la valutazione finale dipenderà dalla capacità di OpenAI di ristrutturare la sua struttura aziendale, in particolare rimuovendo il limite di profitto per gli investitori.

Il Giappone ha recentemente annunciato un piano ambizioso per sviluppare il primo supercomputer di “classe zeta” al mondo, la cui costruzione inizierà nel 2025. Questo progetto rivoluzionario mira a raggiungere una potenza di calcolo 1.000 volte superiore rispetto ai supercomputer attuali, con un costo stimato superiore ai 750 milioni di dollari. Una volta completato, previsto per il 2030, si prevede che il supercomputer avrà un impatto profondo sulla ricerca scientifica e sulle capacità dell’intelligenza artificiale.

Henry Schmidt ha recentemente tenuto una conferenza a Stanford intitolata “The Age of AI”, dove ha condiviso le sue visioni sull’intelligenza artificiale e il suo impatto futuro. Durante l’evento, ha affrontato vari temi, dalle capacità emergenti dell’AI alla competizione globale, con un tono provocatorio e una narrazione ricca di dettagli tecnici.

Google è un leader globale nell’intelligenza artificiale, che sfrutta le sue vaste risorse e il suo talento per sviluppare tecnologie AI all’avanguardia che alimentano i suoi prodotti e servizi. La strategia AI dell’azienda si concentra sul progresso del settore attraverso la ricerca, applicando l’AI per migliorare le esperienze degli utenti e promuovendo lo sviluppo e l’uso responsabile dell’AI.

La distinzione tra natura e cultura è un tema che ha assunto sempre maggiore rilevanza nel contesto delle tecnologie innovative e delle biotecnologie. In questo articolo, esploreremo i concetti fondamentali dietro questa distinzione e le implicazioni etiche che derivano dalle nuove tecnologie.

I prodotti di aziende affermate e nuovi concorrenti hardware stanno integrando l’intelligenza artificiale generativa nei sistemi operativi.

Con l’adozione dei nuovi metodi di acquisto online, l’ecosistema della pubblicità digitale potrebbe subire cambiamenti significativi nella spesa pubblicitaria per ricerca, display e marketplace.

Il TEHA – Global Innosystem Index (TEHA – GII) 2024, presentato al Technology Forum tenutosi il 30-31 maggio a Stresa da The European House – Ambrosetti, ha evidenziato nuovamente le criticità dell’Italia in tema di innovazione.

La posizione dell’Italia in termini di innovazione è un misto di progressi e sfide. Da un lato, il paese ha mostrato significativi progressi in diverse aree, come la diversificazione dell’industria nazionale e lo sviluppo dell’innovazione, in particolare nel design industriale.

Dall’altro lato, l’Italia ancora affronta diverse sfide che ostacolano la sua capacità innovativa. La capacità del paese di attrarre investimenti diretti esteri è un’area di preoccupazione principale. Inoltre, l’ambiente imprenditoriale italiano è ostacolato da procedure burocratiche complesse, che rendono difficile l’ingresso nel mercato per nuove aziende, come startup.

Il Paese si posiziona al 24º posto tra i 37 Paesi ad alta performance innovativa, una classifica dominata da Singapore, Israele ed Estonia. Gli indicatori che vedono l’Italia in maggiore difficoltà sono quelli relativi all’innovazione dell’ecosistema e al capitale umano, dove si colloca rispettivamente al 32º e al 28º posto.

Nonostante questi risultati, l’Italia dimostra una buona efficacia dell’ecosistema innovativo, piazzandosi al 10º posto per produzione di nuove idee e il loro impatto economico.