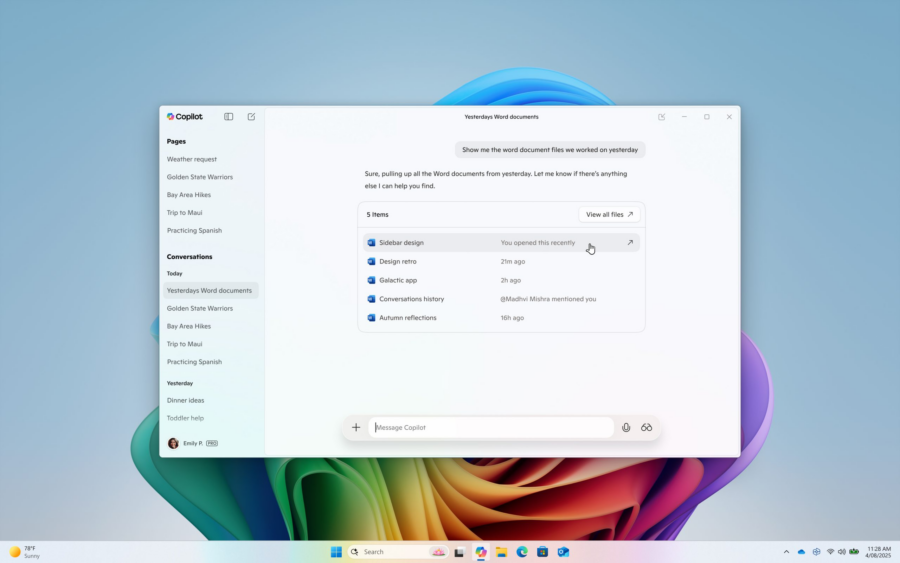

Nel teatro sempre più affollato dell’internet satellitare, Amazon accende i motori e si prepara a lanciare il suo guanto di sfida contro SpaceX. Mercoledì sera, dal pad di Cape Canaveral, 27 satelliti della costellazione Kuiper prenderanno il volo a bordo di un razzo Atlas V della United Launch Alliance, la joint venture tra Boeing e Lockheed Martin. Non si tratta più di test o prove tecniche di trasmissione: questa è la prima vera infornata operativa, quella che segna il passaggio dal laboratorio all’arena commerciale.

Il battesimo del fuoco segue il volo di due prototipi messi in orbita lo scorso anno, piccoli precursori lanciati per testare le fondamenta della rete Kuiper. Adesso si fa sul serio. I satelliti sono destinati a diventare le prime pedine concrete nella gigantesca scacchiera cosmica dove Amazon ambisce a posizionare oltre 3.200 unità. Obiettivo? Copertura internet globale, low-latency e a banda larga, in una guerra fredda dello spazio che si combatte a colpi di gigabit, orbite basse e frequenze radio.