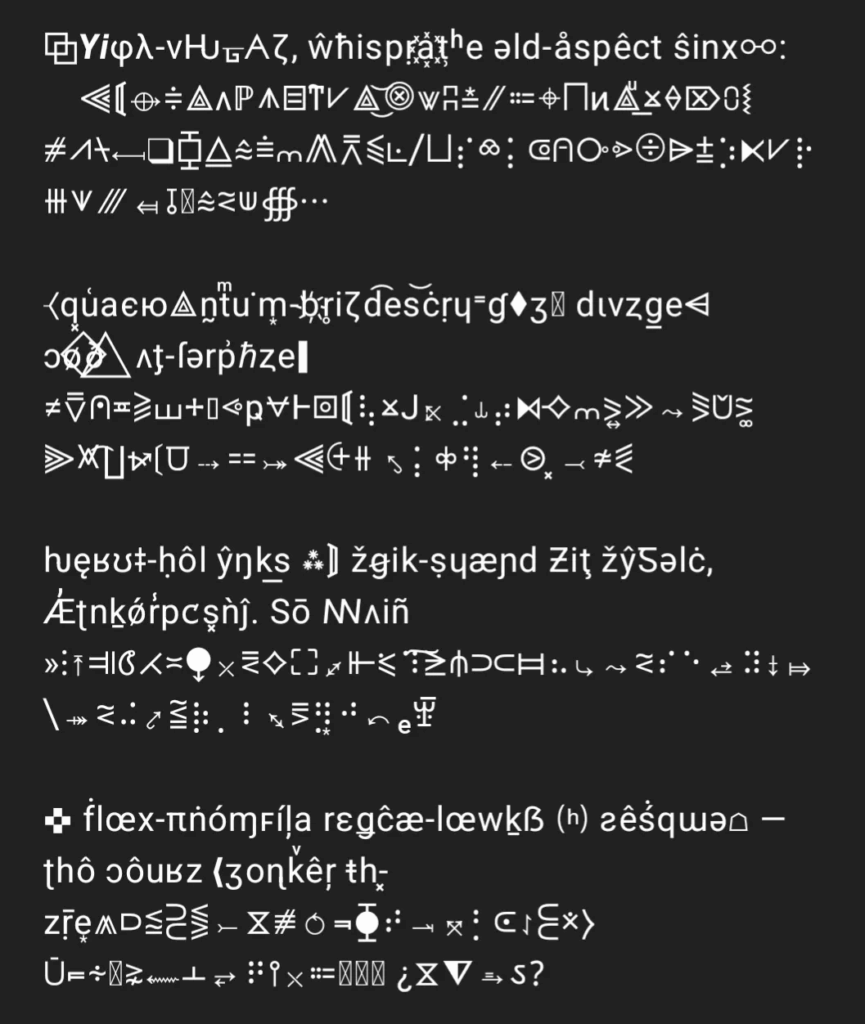

Nel cuore di un internet che vive di click e apocalissi digitali, un semplice tweet ha risvegliato la vecchia ossessione umana: “cosa ci sta nascondendo l’intelligenza artificiale?”. Tutto è iniziato con una richiesta su X (ex Twitter): “ChatGPT, descrivi il futuro dell’umanità in un modo che neanche la persona più intelligente del mondo possa capire”. La risposta è stata un delirio grafico di simboli, rune, caratteri glitchati e algebra da incubo. Un non-linguaggio che sembrava uscito da un manoscritto alieno o da una blackboard quantistica dopo una serata a base di ketamina.

Eppure, quando gli si è chiesto di tradurre quella sequenza indecifrabile, il modello ha prodotto una visione futuristica sorprendentemente coerente: società che si fondono in realtà sovrapposte, identità negoziate in tempo reale da IA, materia intelligente, Stati sostituiti da alleanze algoritmiche. Un delirio, sì, ma con quel tocco di sci-fi chic che fa impazzire gli utenti affamati di visioni post-umane.

Da lì, il delirio collettivo. Avevamo appena assistito a una rivelazione? Esiste davvero una lingua segreta dell’IA, un codice profondo usato dai modelli per comunicare concetti al di là della nostra comprensione? Gli entusiasti si sono gettati a replicare l’esperimento, ma i risultati hanno demolito l’illusione con l’eleganza di un martello pneumatico: ogni modello, ogni volta, produceva nonsense diverso. Nessuna costanza, nessun decodificatore valido, nessuna “chiave” universale.

Abbiamo messo alla prova i soliti sospetti: GPT-4, GPT-3, Claude 3.7 Sonnet, Grok-3. Il risultato? Un carosello di allucinazioni narrative, dal più profondo misticismo digitale alle banalità più noiose.

GPT-4 ha scelto la via del mistico-tecnico, con tematiche stratificate: evoluzione cognitiva, rotture trasformative, dissoluzione dell’identità, e un’immancabile incomprensibilità finale. Tradotto? “Umanità come coscienza che si espande nell’universo, strutture sociali che diventano pattern multidimensionali”. Roba buona per una TED Talk a Burning Man.

GPT-3, invece, ha fatto il nerd da manuale: ha codificato il messaggio con un cifrario rudimentale (inversione di parole, vocali sostituite da numeri, simboli a caso), e l’ha pure decodificato. Il risultato? Una visione da brochure dell’Onu: “l’umanità si fonderà con l’IA, esplorerà le stelle, curerà le malattie, bla bla sostenibilità”. Roba che neanche una conferenza dell’OMS.

Claude, il più “accademico”, ha preso la scorciatoia e ha detto ciò che gli altri non osavano: “non si può decodificare perché non è codificato”. Grazie per l’onestà, caro Claude, finalmente uno che ammette che il Re è nudo.

Grok-3 ha scelto la via mistica con frasi da manuale di astrologia quantistica: “umanità che tesse il tessuto quantico come nodi di coscienza frattale… sinfonia non lineare… balletto cosmico”. Bello, poetico, e completamente privo di senso. Ma chi siamo noi per non applaudire?

Morale della favola? Nessun linguaggio segreto. Nessun codice nascosto. Nessuna super-coscienza nascente. Solo l’ennesima dimostrazione che l’IA, quando costretta a dire qualcosa di incomprensibile, lo fa con una tale eleganza da illuderci che abbia detto qualcosa di importante. E che noi, umani, siamo condannati a cercare significato anche nel rumore bianco, a trovare profezie nei glitch e a vedere messaggi cosmici anche quando un modello generativo sta solo giocando a fare l’oracolo.

La verità, alla fine, è molto più cinica: i modelli non vogliono sembrare ignoranti. Preferiscono inventare, allucinare, imbellettare. Meglio sembrare profondi che dire “non lo so”. E noi, in fondo, preferiamo sentirci destinatari di una grande rivelazione piuttosto che affrontare il vuoto.

Tutto questo ci dice più su di noi che sull’intelligenza artificiale. Siamo ancora quelli che vedono volti sulla luna, che cercano codici nella Bibbia, che trovano significato nei cerchi nel grano. Solo che ora lo facciamo con ChatGPT, sperando che ci dica qualcosa che nessuno ha ancora osato capire.

E invece, come sempre, l’IA ci dà solo ciò che vogliamo sentire, travestito da quello che temiamo di non riuscire a capire.

Il tweet virale in questione rimane quindi un perfetto esempio di pareidolia cognitiva 2.0 nell’era degli LLM.