Nel 2023 ci siamo ubriacati con il concetto di prompt engineering, quella pratica un po’ feticista di incartare un modello LLM come se fosse una caramella magica, sperando che un prompt ben costruito potesse trasformare un pappagallo probabilistico in una creatura senziente e autonoma. Il 2024 ha visto i primi sobbalzi di coscienza. Ma è nel 2025 che si consuma il passaggio di fase: da artigiani della parola a veri AI system architects.

L’intelligenza agentica non è un’estensione del prompt, ma un cambio di paradigma. Un salto da una UI testuale a un runtime cognitivo. Chi continua a insistere sul wrapping dei prompt dimostra di non aver capito il punto. Un agente non è una sequenza di istruzioni ma un organismo computazionale capace di percepire, pianificare, agire e apprendere.

Questo significa ristrutturare da zero l’architettura sottostante, perché non è il modello che fallisce, è lo scaffold che lo circonda a essere nato già morto.

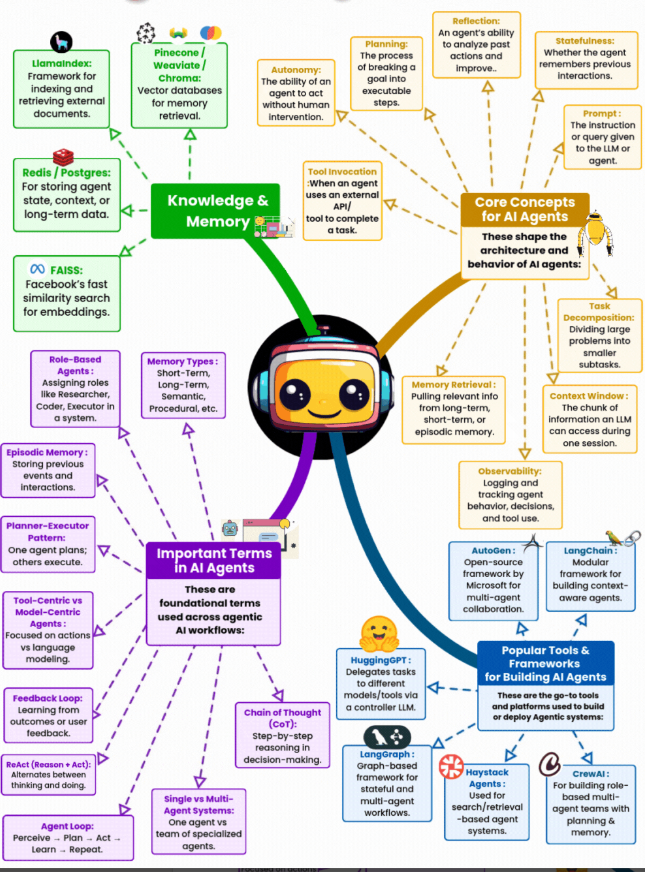

Un vero agente vive in quattro dimensioni operative. La prima è l’autonomia, che implica pianificazione gerarchica, decomposizione di task, esecuzione indipendente, senza la mamma-API che lo imbocca a ogni passo. La seconda è la memoria, non quella volatile e finta di una chat session, ma una memoria strutturata, persistente, contestualizzata. Se non hai un sistema che integra FAISS, pgvector, Redis o simili, non hai un agente, hai un chatbot amnesico. La terza dimensione è la capacità di usare strumenti: browsing, scraping, chiamate API, code execution, file system access. Un agente deve poter agire nel mondo digitale, altrimenti è un monaco tibetano chiuso in una cella. Infine, c’è la collaborazione: planner-executor, swarm dynamics, role-based behaviors. Non è più un AI, ma una società di intelligenze.

Framework come LangGraph, AutoGen, LangChain, Google ADK e CrewAI ci danno la cassetta degli attrezzi. Ma il progetto architetturale resta umano. Se non hai chiaro come decomporre un task, mantenere uno stato, integrare cicli di feedback e riflessione, puoi anche usare tutti i framework del mondo: l’agente non emergerà.

Il vero tema è quello dell’intelligenza distribuita, dove i singoli moduli (planner, executor, retriever, memory, observer) non sono pezzi di codice ma entità semiautonome in grado di ragionare, adattarsi ed evolvere. Per farli funzionare serve una nuova forma mentis, a metà tra l’ingegnere di sistema e l’etologo computazionale.

Il mercato è pieno di prototipi fragili, demo che funzionano solo il giovedì pomeriggio, agenti che dimenticano il proprio nome dopo due passi. Perché? Perché tutti giocano con il giocattolo LLM e nessuno costruisce l’organismo intorno. L’intelligenza non è nel modello, è nella struttura che lo orchestra.

Il futuro non è il fine-tuning, è l’orchestrazione intelligente. Non servono prompt più belli, servono architetture più intelligenti.

Nel 2025, chi continua a scrivere prompt è già stato superato dalla storia. Chi progetta sistemi agentici, invece, sta scrivendo il prossimo capitolo dell’AI.