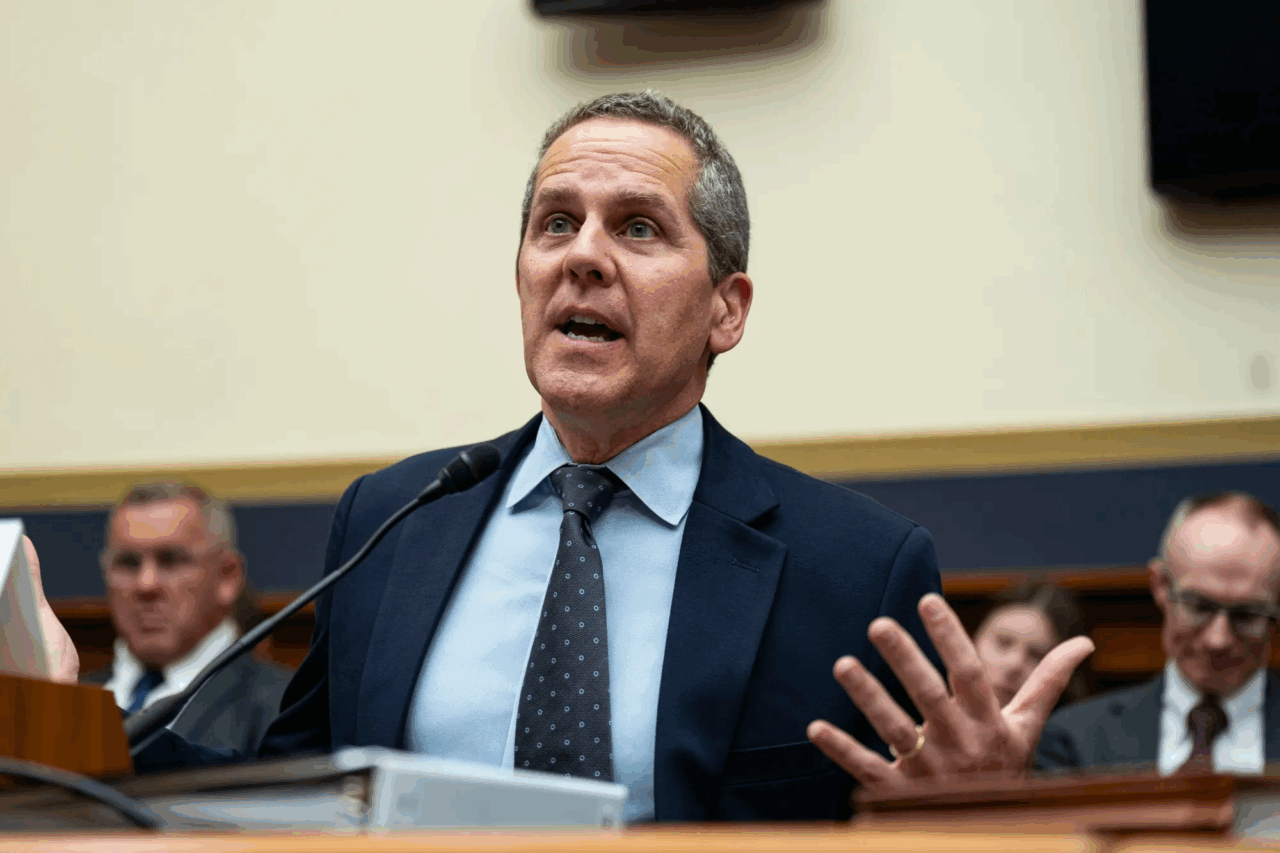

La dichiarazione di Michael Barr, Governatore della Federal Reserve, non è passata inosservata. In un mondo dove la minaccia non ha più un volto ma un algoritmo, Barr ha lanciato un appello ai banchieri: svegliatevi, abbracciate l’intelligenza artificiale o sarete carne da macello per i nuovi truffatori digitali.

Nel suo intervento alla Federal Reserve Bank di New York, Barr ha tracciato un quadro che definire allarmante è poco. Le tecnologie deepfake quelle meraviglie del diavolo capaci di replicare perfettamente volto, voce e movimenti di una persona reale non sono più una curiosità accademica o uno scherzo da social. Sono armi. E come ogni arma che si rispetti, puntano dritte al cuore: le identità bancarie.

Non si tratta solo di qualche truffatore in un garage che prova a frodare un conto PayPal. Barr parla di un’intera nuova infrastruttura di frode digitale, alimentata dall’AI, che si muove come un virus intelligente tra i sistemi bancari, difficile da rilevare, ancora più difficile da fermare. È una minaccia simmetrica che rende obsoleti i sistemi di autenticazione classici, dal codice OTP alla password con simboli e maiuscole. Un viso falso, una voce replicata, un comportamento simulato possono aprire conti, spostare fondi e superare i controlli senza che nessun umano si accorga di nulla. O peggio, troppo tardi.

La risposta? Secondo Barr, è combattere il fuoco con il fuoco: biometria comportamentale, riconoscimento facciale, analisi vocale, e soprattutto, sistemi di intelligenza artificiale in grado di prevedere, rilevare e bloccare in tempo reale qualsiasi anomalia, anche minima, che possa indicare un attacco. Una rivoluzione copernicana nel mondo della sicurezza bancaria, dove il concetto stesso di “cliente” non è più una persona, ma un insieme dinamico di pattern digitali da analizzare in millisecondi.

Già oggi, le banche soprattutto quelle che hanno più da perdere stanno collaborando tra loro per condividere pattern di attacco, definire contromisure comuni, e, come sottolinea Barr, costruire una sorta di intelligenza collettiva che permetta di reagire prima che il danno sia fatto. Ma questo non basta. L’AI deve diventare parte integrante non solo dei sistemi di sicurezza delle banche, ma anche dei regolatori stessi.

È un’idea che suona quasi distopica, eppure è maledettamente concreta: anche la vigilanza bancaria ha bisogno di strumenti per leggere i segnali nel rumore, scovare attacchi su larga scala, intercettare azioni coordinate prima che diventino titoli sui giornali.

E parlando di titoli, uno è già esploso in tutta la sua inquietudine: secondo un’indagine di Bloomberg, hacker hanno spiato per oltre un anno le email di circa 100 regolatori dell’Office of the Comptroller of the Currency. Dentro quelle email c’erano discussioni interne, valutazioni sensibili, dettagli bancari. Una rete vulnerabile dove l’intelligenza artificiale criminale ha già dimostrato di poter giocare in casa, mentre i difensori usano ancora mappe cartacee.

Nel mondo post-truth, dove ogni immagine può essere falsa e ogni voce può essere replicata, la fiducia non si costruisce più con la firma su un documento, ma con algoritmi che sanno distinguere tra umano e copia. È una sfida tecnica, sì, ma prima ancora culturale. Perché serve una mutazione genetica del sistema bancario, che abbandoni definitivamente l’illusione del controllo manuale e abbracci una sorveglianza automatizzata, dinamica, paranoica per design.

Non è un caso se Barr parla di rendere ogni attacco “più costoso” per l’aggressore. Non si può più evitare ogni violazione, ma si può renderla così difficile, così dispendiosa, così incerta, da farla fallire per logoramento. Una nuova logica di deterrenza digitale che ha più a che fare con l’ingegneria che con la giurisprudenza.

E mentre i banchieri più conservatori continueranno a dibattere su etica, consenso e privacy, i criminali AI-driven non staranno certo ad aspettare. La domanda vera è: chi arriverà prima?