Mentre l’occidente dorme e si gingilla con le sue regolazioni etiche e i suoi panel consultivi, Huawei ha appena alzato il sipario su qualcosa che, nel gergo bellico delle tecnologie emergenti, suona come un messaggio nucleare: la CloudMatrix 384 Supernode. Non è un nome da blockbuster hollywoodiano, ma dietro a questo acronimo rigido si nasconde una bestia da 300 petaflop, un Frankenstein di silicio che – se i numeri dichiarati reggono surclassa la tanto celebrata NVL72 di Nvidia (ferma a “soli” 180 petaflop). Fonte: STAR Market Daily

Il tempismo non è casuale. Gli USA hanno sbarrato l’accesso ai chip avanzati? Huawei risponde rilanciando con un’architettura AI che fa a meno di Santa Clara. La risposta cinese alla fame mondiale di potenza computazionale non è più una replica, è una dichiarazione di indipendenza. Ed è strategica, non solo tecnologica. Il fatto che la supernode sia già operativa a Wuhu, nella provincia centrale dell’Anhui, non è un dettaglio geografico: è la conferma che l’infrastruttura AI cinese non sta più nei laboratori, ma nei datacenter attivi, quelli veri.

Huawei ha capito che il collo di bottiglia dell’AI moderna non è solo nei chip, ma nella struttura a monte: CPU, NPU, banda, RAM, storage e una dorsale di interconnessione abbastanza veloce da sostenere modelli con trilioni di parametri. È qui che entra in gioco la CloudMatrix: un’infrastruttura a supernodo progettata per aggregare risorse a livelli che ricordano l’NVLink di Nvidia, con la differenza che stavolta l’architettura è 100% cinese. Senza licenze, senza sanzioni, senza compromessi.

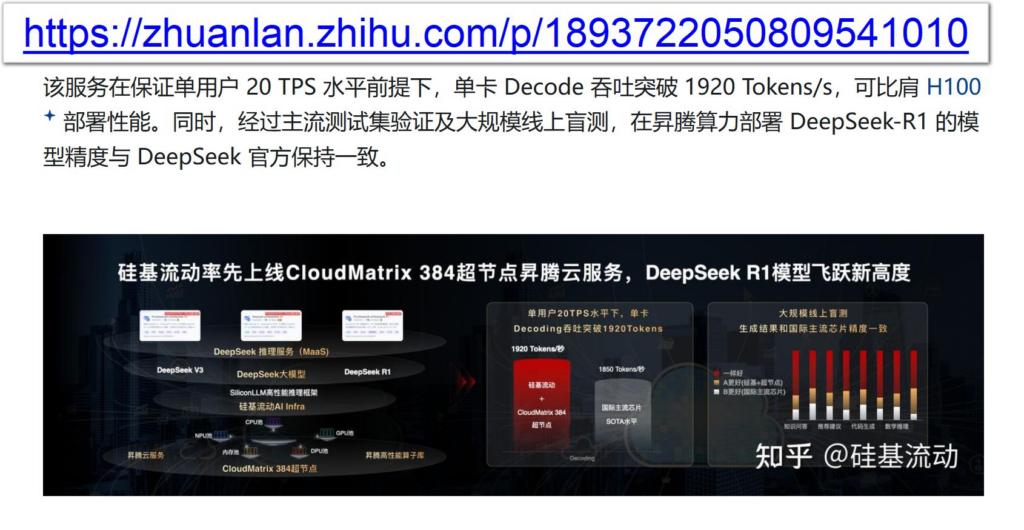

Il parallelo con l’NVL72 di Nvidia, il mostro lanciato nel marzo 2024 con le sue 72 GPU in un dominio NVLink, è inevitabile. Quel sistema aveva impressionato per le sue capacità di inferenza in tempo reale su LLM con trilioni di parametri. Ma Huawei ha deciso che 72 non bastano. Vuole fare di più. E lo fa: 300 petaflop contro 180, 1.920 token al secondo su DeepSeek-R1 (un modello ragionante cinese che ha fatto il giro del mondo a gennaio) e una precisione che, stando ai dati citati da STAR Market Daily, regge il confronto con gli H100 americani.

Naturalmente, da Shenzhen tutto tace. Nessun commento ufficiale. Il che è una risposta in sé: chi ha davvero qualcosa in mano non ha bisogno di twittarlo. Mentre Nvidia vende GPU come fossero oro, Huawei costruisce nodi neurali in silenzio, usando chip cinesi e partnership strategiche come quella con SiliconFlow, l’astro nascente dell’infrastruttura AI a Hangzhou. È la conferma che la partita AI non è più solo tra modelli (OpenAI, Anthropic, Google), ma tra i colossi dell’hardware e chi riesce a costruire la pipeline end-to-end sotto embargo.

Nel frattempo, Alibaba ha deciso che non vuole restare a guardare e ha annunciato 380 miliardi di yuan (oltre 52 miliardi di dollari) di investimento in infrastrutture AI nei prossimi tre anni. Nessuna azienda privata cinese aveva mai messo così tanti soldi su un progetto tecnologico. È l’ennesimo segnale che il Dragone non solo vuole partecipare alla corsa all’intelligenza artificiale, ma pretende di dettarne le regole. E lo farà a modo suo, con chip domestici, architetture proprie, e una visione che non deve sottostare all’opinione pubblica americana.

Il rischio? Che mentre l’occidente si preoccupa se l’AI possa offendere qualcuno, l’oriente stia costruendo il motore che la farà correre per i prossimi dieci anni. E stavolta, senza bisogno di Nvidia.