Leggi l’annuncio ufficiale di Google

In un mondo dove l’intelligenza artificiale viene ancora gestita come una collezione di agenti autistici — intelligenti sì, ma ognuno chiuso nel proprio silo tecnologico — arriva A2A, l’Agent-to-Agent Protocol di Google, come una telefonata improvvisa nel silenzio assordante. Lanciato ieri con tanto di benedizione open source, A2A potrebbe rappresentare lo strato mancante che rende finalmente operativa, interoperabile e scalabile l’intelligenza artificiale multi-agente. Non è la solita iniziativa “alpha-only” con puzza di lock-in, ma un ecosistema già supportato da oltre 50 partner, da Salesforce a LangChain, fino a SAP. Quando si muovono questi, forse qualcosa di grosso bolle davvero in pentola.

Il protocollo A2A è, in estrema sintesi, una lingua franca tra agenti AI. Un set di regole e convenzioni che permette a software intelligenti di comunicare, coordinarsi, passarsi lavoro e completare task senza dover riscrivere ogni volta la Torre di Babele del middleware. Un agente riceve un compito, lo passa a un altro che ha le competenze per completarlo, e voilà: niente più API spaghetti, nessun vendor lock-in, zero pareti proprietarie. Il sogno bagnato di chiunque abbia passato gli ultimi cinque anni cercando di orchestrare architetture modulari senza impazzire.

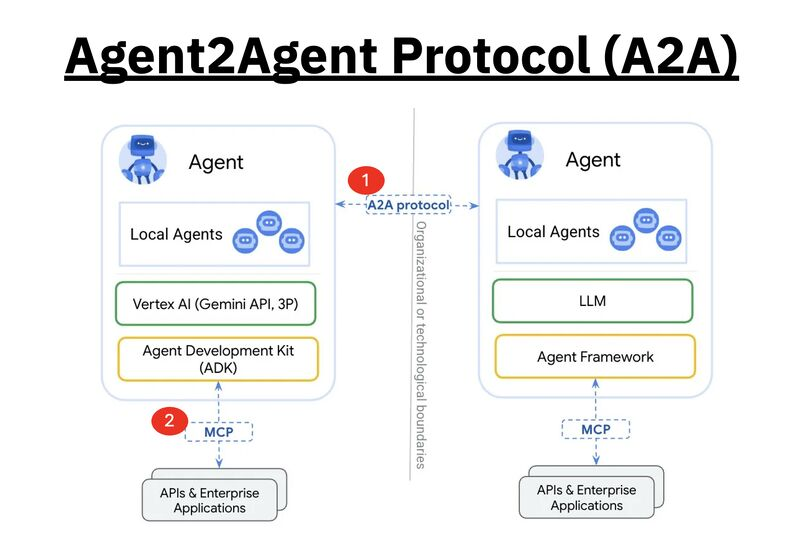

Certo, come sempre quando Google entra in campo, si crea confusione. In molti hanno già frainteso: no, A2A non è un rimpiazzo del Model Context Protocol (MCP), ma il suo gemello complementare. Dove MCP serve a collegare gli agenti agli strumenti — API, database, ERP, CRM e tutte le altre sigle enterprise che fanno girare l’economia A2A collega direttamente gli agenti tra loro. In parole povere: MCP è il cavo di alimentazione, A2A è il Wi-Fi.

Ed è proprio questa distinzione a far emergere il potenziale rivoluzionario dell’architettura. Mettendo insieme A2A e MCP, si costruisce un sistema di agenti realmente autonomi ma interoperabili, capaci di agire, reagire e collaborare attraverso stack tecnologici eterogenei, organizzazioni diverse e contesti applicativi in continua mutazione. È il passaggio obbligato se vogliamo un futuro in cui non dobbiamo più progettare tutto a mano come se fossimo nel 1997.

La realtà, però, è che siamo ancora all’inizio. A2A è appena uscito dalla culla e deve dimostrare di poter camminare. Serve adozione, serve sperimentazione, servono storie di successo — o di fallimento ben documentato. Ma il fatto che sia open di default e che già attiri pesi massimi del settore è un segnale fortissimo. Anche perché, diciamocelo: il mondo dell’AI non ha bisogno di un’altra piattaforma chiusa, ma di uno standard vero. E se questo standard arriva da Google, con le spalle coperte da un consorzio solido, allora è giusto alzare le antenne.

In un panorama dove gli agenti AI diventano sempre più centrali per la gestione di processi, dati e interazioni, avere un protocollo per farli parlare tra loro non è un lusso. È la base per qualunque ambizione seria di automazione distribuita, dalle supply chain intelligenti alle operation autonome, fino alla governance decentralizzata dei sistemi AI. Il futuro non sarà una singola super-intelligenza. Sarà una rete di agenti cooperanti. E A2A potrebbe essere il linguaggio che li tiene insieme.

Aspettiamoci adesso la solita corsa all’adozione, ai fork, alle implementazioni verticali. Ma almeno, per una volta, partiamo da un linguaggio comune.