Ant Group, il colosso fintech affiliato ad Alibaba, sta riscrivendo le regole del gioco nell’intelligenza artificiale. Mentre gli Stati Uniti impongono restrizioni sempre più rigide sull’export di chip avanzati, la Cina risponde con innovazione e adattamento. Il team Ling di Ant ha dimostrato che è possibile addestrare modelli linguistici di grandi dimensioni (LLM) utilizzando GPU di produzione locale, riducendo così la dipendenza da Nvidia e abbattendo i costi di training del 20%. La notizia, che potrebbe ridisegnare il mercato AI, è stata pubblicata su arXiv, una piattaforma di ricerca scientifica open-access.

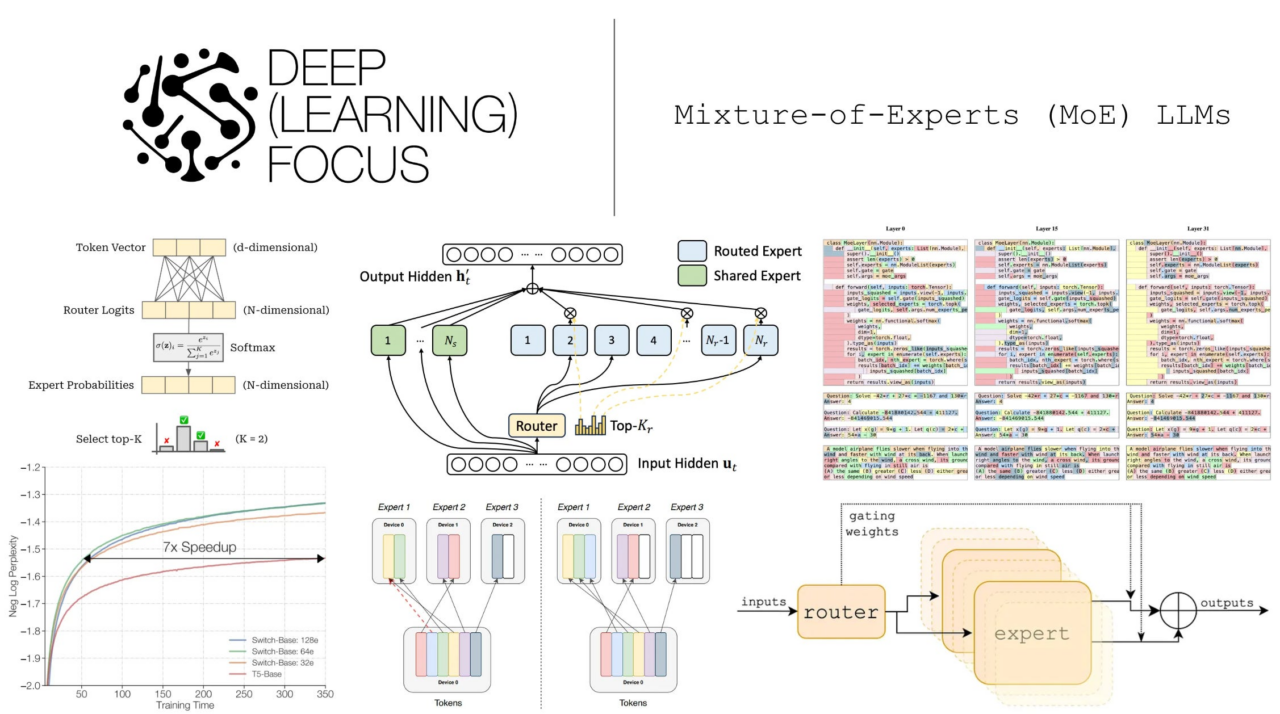

L’approccio si basa su un modello Mixture-of-Experts (MoE) da 300 miliardi di parametri, il Ling-Plus-Base, in grado di essere “efficacemente addestrato su dispositivi a bassa prestazione”. Tradotto in termini di mercato, significa che l’AI può evolversi senza l’ossessione per le GPU top di gamma, permettendo ai big cinesi di scalare le proprie capacità senza piegarsi alle sanzioni di Washington.

Secondo il paper, questo modello riesce a garantire performance paragonabili a competitor del calibro di Qwen2.5-72B-Instruct e DeepSeek-V2.5-1210-Chat, il tutto riducendo sensibilmente i costi computazionali nella fase di pre-training. È un colpo diretto alle restrizioni USA: se i cinesi riescono a costruire LLM avanzati senza i chip di Nvidia, il valore strategico delle sanzioni americane crolla. Non è un caso che altre aziende del settore, come ByteDance e DeepSeek, stiano seguendo la stessa strada.

L’MoE non è un’invenzione di Ant Group, ma è ormai una tecnica consolidata tra i giganti dell’AI: da OpenAI a Google, passando per Grok, DeepSeek e Qwen. Consente di scalare modelli fino a trilioni di parametri senza far esplodere i costi computazionali. La vera novità è che il team di Hangzhou ha dimostrato che il paradigma funziona anche su hardware meno potente, garantendo un approccio più flessibile e accessibile.

Non è chiaro quali siano esattamente i chip utilizzati, ma Bloomberg ha rivelato che Ant ha sfruttato processori sviluppati in casa da Alibaba e Huawei. Tuttavia, l’azienda continua a utilizzare GPU Nvidia per lo sviluppo AI, segno che il passaggio alla completa indipendenza hardware è ancora in corso. Di certo, il messaggio è chiaro: la Cina sta trovando il modo di aggirare i blocchi USA con la propria tecnologia.

Nel frattempo, Ant ha annunciato anche un aggiornamento significativo alle sue soluzioni AI per il settore sanitario. Basate su modelli specializzati nella diagnostica e nell’interazione multimodale, queste “macchine all-in-one” potrebbero rivoluzionare l’assistenza sanitaria automatizzata.

La corsa all’autosufficienza tecnologica è diventata una questione di sopravvivenza per le big tech cinesi, mentre il braccio di ferro tra Washington e Pechino si intensifica. La domanda ora è: quanto tempo servirà alla Cina per rendere Nvidia un semplice spettatore in questa guerra tecnologica?