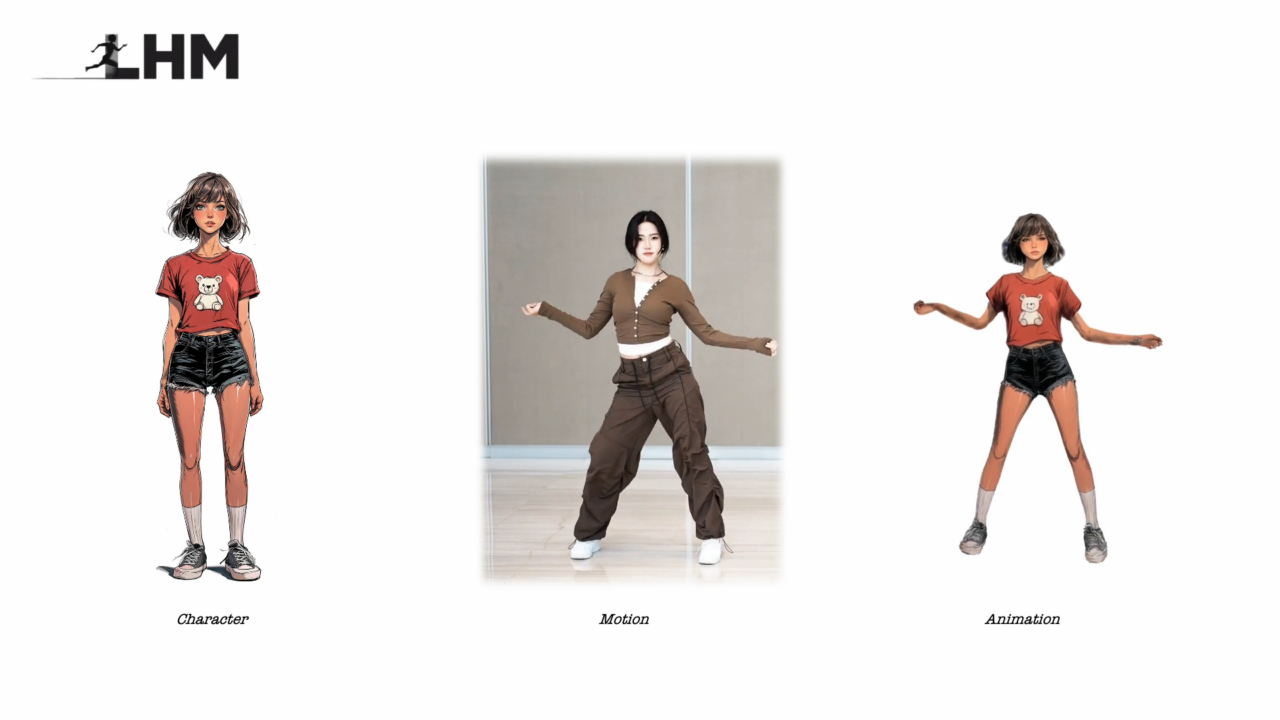

LHM, o Large Animatable Human Reconstruction Model, è un modello proposto per la ricostruzione di avatar 3D animabili a partire da una singola immagine. È stato sviluppato per risolvere una delle sfide principali nella computer vision e nella grafica 3D, ovvero la creazione di modelli 3D di esseri umani altamente realistici e animabili, utilizzando una sola immagine come input.

LHM sfrutta un’architettura multimodale basata su transformer per codificare efficacemente le caratteristiche spaziali e visive del corpo umano, consentendo una riproduzione dettagliata della geometria e della texture dei vestiti. Inoltre, il modello introduce una piramide di feature della testa per migliorare la conservazione dell’identità facciale e il recupero dei dettagli fini, come le espressioni facciali e le mani.

Una delle caratteristiche distintive di LHM è l’uso del 3D Gaussian Splatting per rappresentare l’avatar 3D, una tecnica che consente una rappresentazione di alta qualità e ad alta fedeltà senza la necessità di post-elaborazione complessa. Questo approccio permette di generare avatar 3D in tempo reale, in pochi secondi, senza compromettere la qualità visiva e la capacità di animazione.

Sembra che LHM stia cercando di risolvere una delle sfide più ardue della computer vision: ricostruire avatar 3D animabili a partire da una singola immagine senza sacrificare dettagli e realismo. Il problema principale è che i modelli attuali si dividono in due categorie: quelli basati su dati sintetici, che soffrono di scarsa generalizzazione, e quelli basati su ottimizzazioni su video, che richiedono condizioni controllate e sono computazionalmente costosi.

LHM sembra voler sfruttare il meglio dei due mondi, adottando un’architettura multimodale basata su transformer per codificare sia le feature posizionali del corpo che quelle dell’immagine. Il focus sulle regioni della testa con una piramide di feature suggerisce che il modello sta cercando di migliorare il realismo dell’identità facciale, un aspetto spesso trascurato nei modelli di ricostruzione corporea.

L’uso del 3D Gaussian Splatting come rappresentazione per l’avatar è una scelta interessante, considerando che questa tecnica sta emergendo come un’alternativa efficiente e ad alta fedeltà alle tradizionali mesh poligonali o ai campi di densità (come i NeRF). Se davvero riesce a generare un avatar animabile in pochi secondi senza post-processing, potrebbe segnare un grosso passo avanti rispetto ai metodi esistenti.

I paper suggeriti dal Librarian Bot mostrano che c’è un forte fermento nell’area, con modelli come Avat3r, Vid2Avatar-Pro e HRAvatar che cercano di affrontare problemi simili con strategie diverse. Sarà interessante vedere come LHM si confronta con questi metodi in scenari reali, soprattutto in termini di generalizzazione su immagini non viste e fedeltà dei dettagli minuti (es. mani e espressioni facciali).

Visita: https://huggingface.co/papers/2503.10625