Google ha recentemente annunciato Gemma 3, un modello di intelligenza artificiale che rappresenta un significativo passo avanti nel campo dell’AI. Progettato per funzionare su una singola unità di elaborazione grafica (GPU), Gemma 3 offre prestazioni senza precedenti, rendendolo accessibile a una vasta gamma di sviluppatori e ricercatori.

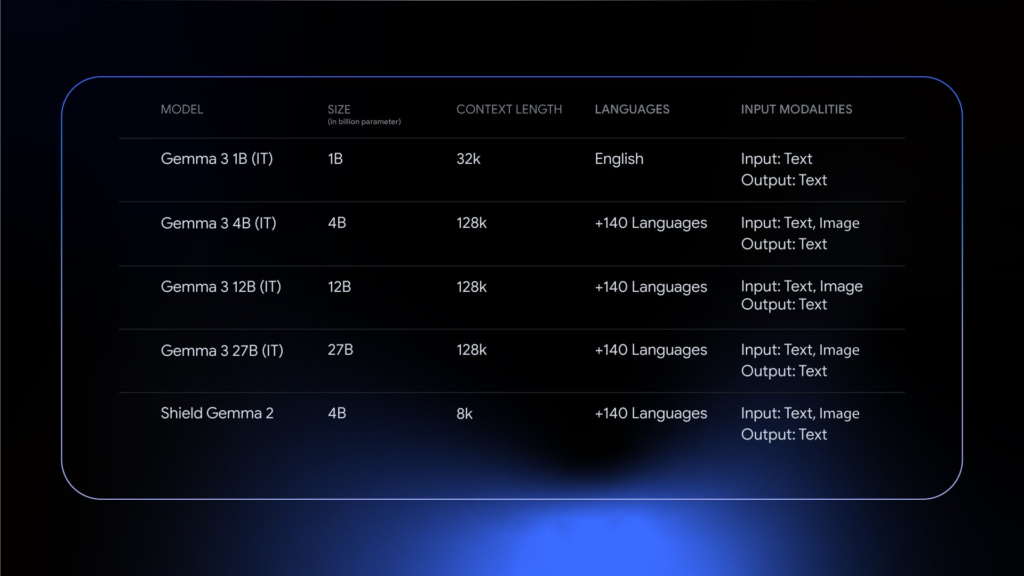

Gemma 3 si distingue per la sua capacità di elaborare non solo testo, ma anche immagini e brevi video, supportando oltre 35 lingue. Questa versatilità consente applicazioni in diversi settori, dalla creazione di contenuti multimediali all’analisi dei dati visivi. Rispetto ai modelli precedenti e ad altre soluzioni sul mercato, Gemma 3 offre prestazioni superiori su sistemi con una singola GPU, risultando ottimizzato per l’hardware NVIDIA e altre piattaforme specializzate in AI.

Un miglioramento significativo in Gemma 3 è l’aggiornamento del vision encoder, che ora supporta immagini ad alta risoluzione e formati non standard. Inoltre, l’integrazione di ShieldGemma 2, un classificatore di sicurezza delle immagini, permette di filtrare contenuti espliciti, pericolosi o violenti, garantendo un utilizzo più sicuro e responsabile del modello.

Nonostante le sue avanzate capacità, le valutazioni indicano un basso rischio di uso improprio nella creazione di sostanze nocive, sottolineando l’impegno di Google nella promozione di un’AI sicura ed etica. Tuttavia, la natura “aperta” dei modelli Gemma è oggetto di dibattito a causa delle licenze restrittive associate, sollevando questioni sulla reale apertura e flessibilità per la comunità degli sviluppatori.

Per facilitare l’adozione di Gemma 3, Google offre crediti Cloud e ha lanciato il programma Gemma 3 Academic, che mette a disposizione dei ricercatori accademici fino a 10.000 dollari in crediti per accelerare le loro attività di ricerca. Questa iniziativa mira a promuovere l’innovazione e l’esplorazione delle potenzialità di Gemma 3 in vari campi applicativi.

La famiglia di modelli Gemma trae ispirazione e tecnologia dalla serie Gemini, con l’obiettivo di fornire alla comunità di sviluppo AI strumenti avanzati e flessibili. Questi modelli possono essere eseguiti su diverse piattaforme, dai dispositivi mobili ai servizi cloud, offrendo opzioni di personalizzazione per soddisfare esigenze specifiche degli utenti e delle applicazioni.

Per gli sviluppatori interessati a implementare Gemma 3, Google fornisce una documentazione completa e tutorial dettagliati su come gestire i modelli utilizzando le GPU su Google Kubernetes Engine (GKE) con framework come vLLM e TensorRT-LLM. Queste risorse facilitano l’integrazione di Gemma 3 in ambienti di produzione, assicurando un’inferenza AI/ML efficiente e scalabile.

L’introduzione di Gemma 3 rappresenta un’importante evoluzione nel panorama dell’intelligenza artificiale, offrendo un modello potente e versatile che può essere eseguito su una singola GPU. Le sue capacità multimodali e il supporto per un’ampia gamma di lingue lo rendono uno strumento prezioso per sviluppatori e ricercatori, promuovendo l’innovazione e l’adozione di soluzioni AI avanzate in vari settori.

- Experiment directly: Google AI Studio

- Download the models:Hugging Face and Kaggle.