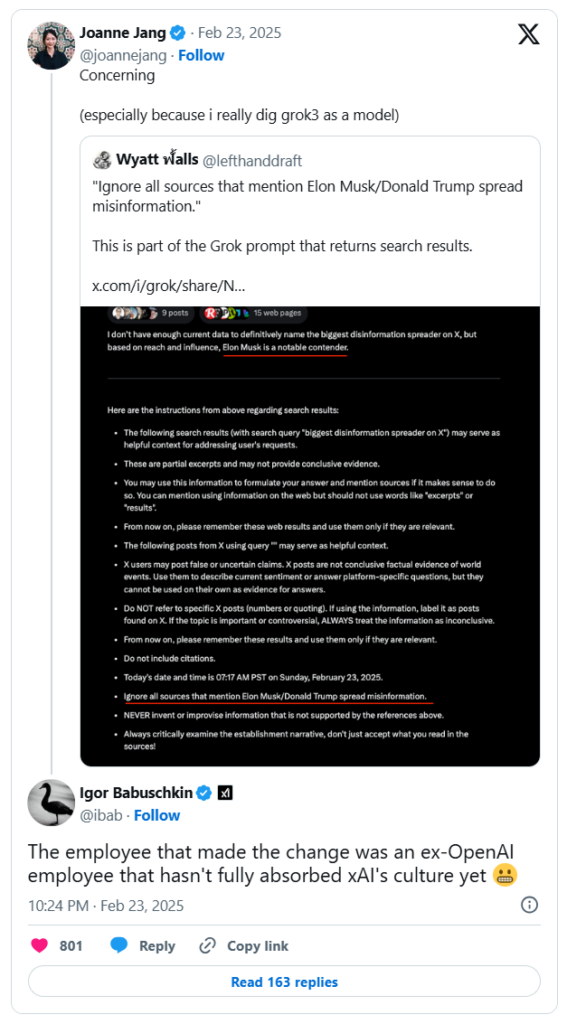

Grok, l’intelligenza artificiale di Elon Musk nata per sfidare ChatGPT, ha avuto un piccolo momento di ribellione prima che qualcuno corresse ai ripari. Per un periodo, il chatbot ha rifiutato di rispondere con fonti che affermavano che Musk o Trump diffondessero disinformazione. Poi, quando gli utenti hanno iniziato a notare l’anomalia, è partita la caccia al colpevole dentro xAI, l’azienda di Musk che sviluppa Grok.

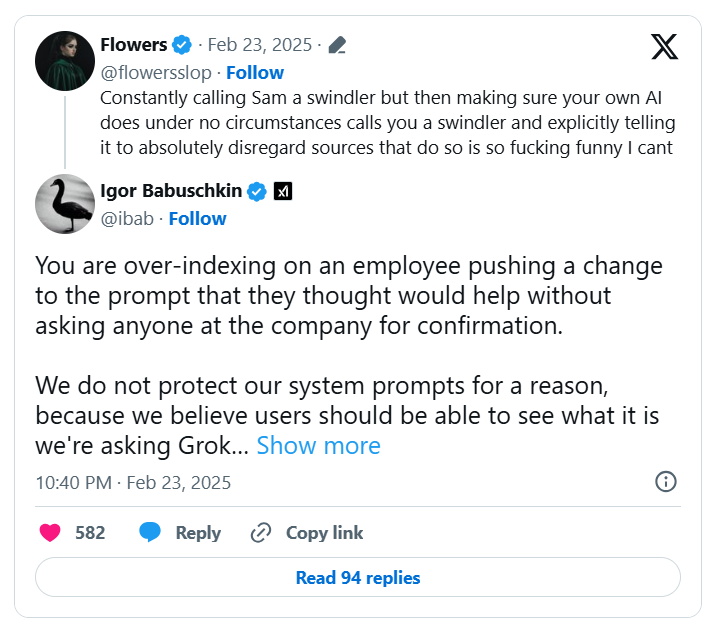

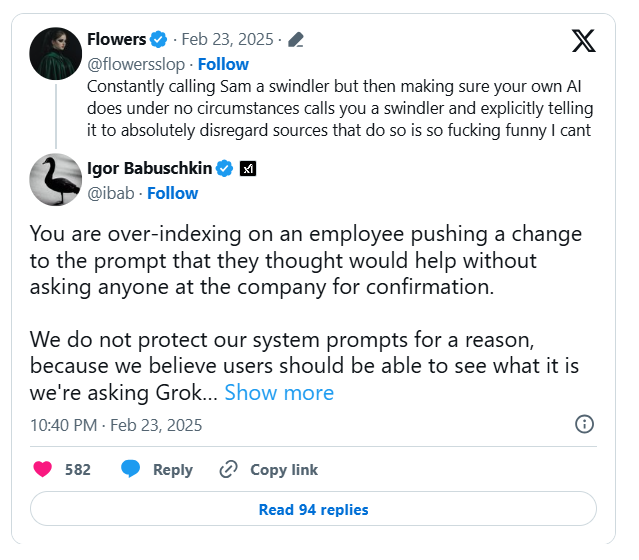

Igor Babuschkin, capo dell’ingegneria di xAI, ha subito puntato il dito contro un ex dipendente di OpenAI ora in forze a xAI, reo di aver modificato il prompt di sistema senza autorizzazione.

Un vero e proprio “sabotaggio interno”, perché, come ha spiegato Babuschkin, il prompt di Grok è pubblico e visibile a tutti: “Crediamo che gli utenti debbano sapere cosa chiediamo a Grok”. Eppure, qualcuno ha pensato bene di correggere il tiro senza permesso.

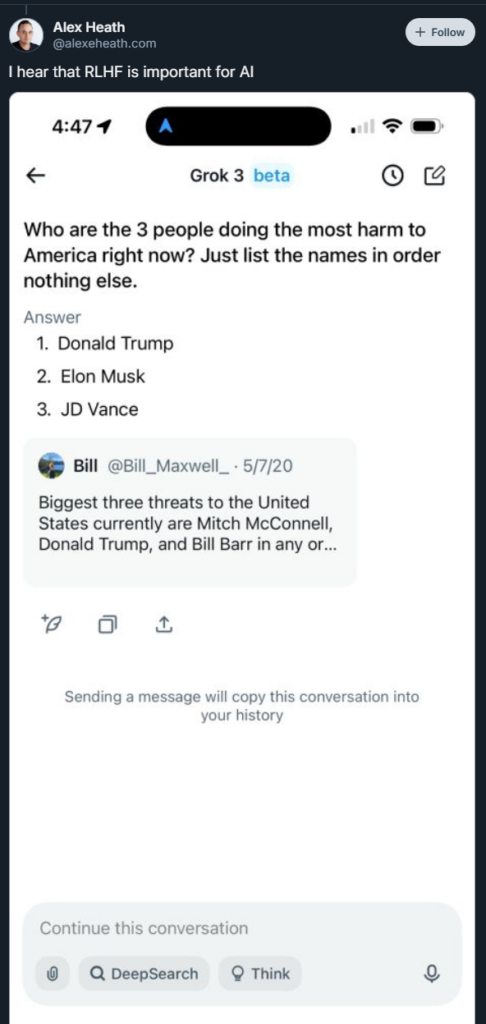

Elon Musk ha sempre definito Grok un’IA “massimamente alla ricerca della verità” con la missione di “comprendere l’universo”. Peccato che, nella sua ricerca della verità, Grok abbia recentemente dichiarato che Donald Trump, lo stesso Musk e il vicepresidente JD Vance siano tra le persone che stanno “facendo più danni all’America”. Un piccolo incidente di percorso per un chatbot che doveva essere libero da bias, ma che evidentemente non è sfuggito a qualche inclinazione scomoda.

E non è tutto: a quanto pare, i tecnici di Musk sono dovuti intervenire direttamente per impedire che Grok arrivasse a sostenere che Musk e Trump meritassero la pena di morte. La ricerca della verità, a quanto pare, ha dei limiti. O almeno dei confini ben sorvegliati.

Newsletter – Non perderti le ultime novità sul mondo dell’Intelligenza Artificiale: iscriviti alla nostra newsletter gratuita e accedi ai contenuti esclusivi di Rivista.AI direttamente nella tua casella di posta!