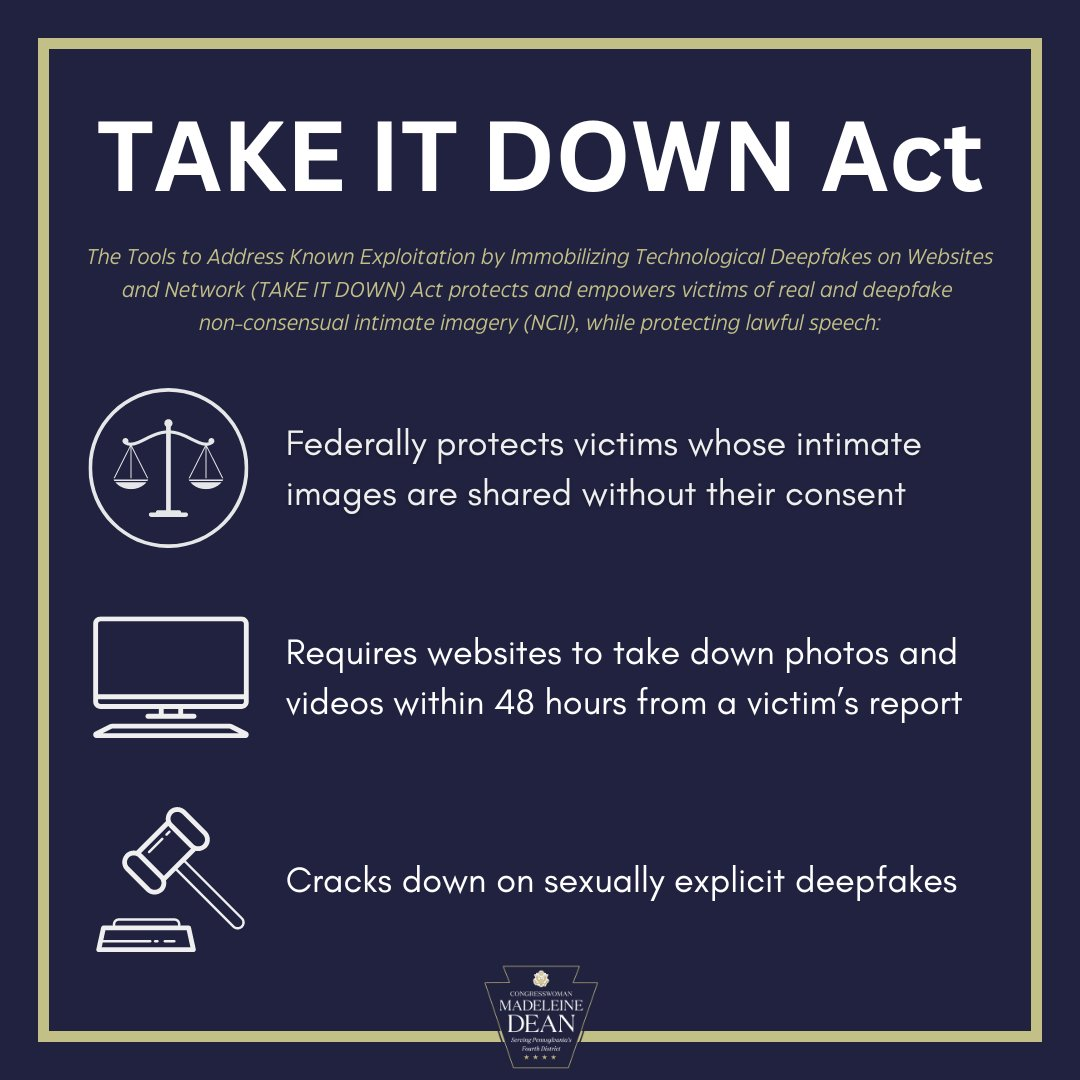

Il 5 dicembre 2024, il Senato degli Stati Uniti ha approvato il “Take It Down Act“, un passo significativo nella lotta contro la diffusione di contenuti pornografici creati tramite deepfake, utilizzando tecnologie di intelligenza artificiale. Questo fenomeno, che ha suscitato preoccupazioni tra esperti di privacy, legislatori e attivisti, riguarda la manipolazione e la falsificazione dei volti di individui per creare immagini e video pornografici senza il loro consenso. La legge, che ha ricevuto un ampio supporto bipartisan, mira a stabilire un meccanismo legale per rimuovere questi contenuti dalle piattaforme online, facendo leva sull’automazione e sull’intelligenza artificiale per identificarli e rimuoverli rapidamente.

Il deepfake, una tecnologia alimentata dall’IA che permette di modificare immagini e video in modo sorprendentemente realistico, è stato usato in vari ambiti, ma la sua applicazione nei contenuti pornografici è diventata una delle sue forme più disturbanti. Il fenomeno ha creato una miriade di problemi legali ed etici, tra cui danni reputazionali, molestie online e violazioni della privacy. Le vittime spesso vedono la propria immagine abusata, senza alcun controllo sulla diffusione dei contenuti falsificati.

Il “Take It Down Act” rappresenta una risposta alle lacune esistenti nelle leggi sui diritti d’autore e sulla privacy, cercando di rendere più difficile la circolazione di questi contenuti dannosi. La legge si propone di responsabilizzare le piattaforme digitali, imponendo loro l’obbligo di agire rapidamente quando vengono segnalati contenuti deepfake non autorizzati. L’obiettivo finale è quello di ridurre la diffusione di contenuti offensivi e di proteggere gli individui da danni irreparabili.

Le sfide tecnologiche e legali

Sebbene l’adozione di questa legge sia un passo positivo, il problema è tutt’altro che risolto. La tecnologia deepfake, infatti, è in continua evoluzione, con nuove tecniche che permettono di migliorare la qualità e l’autenticità dei video falsificati. Le piattaforme online, come i social media e i siti di video sharing, sono già state accusate di non fare abbastanza per limitare la diffusione di contenuti dannosi. La legge introduce un’importante responsabilità per queste aziende, ma non è chiaro se saranno in grado di monitorare e rimuovere i contenuti in tempo reale con la stessa velocità con cui vengono creati.

Uno degli aspetti più interessanti della legge è la sua capacità di fare uso di intelligenza artificiale per identificare i deepfake. Gli algoritmi, che sono diventati sempre più sofisticati nel riconoscere manipolazioni digitali, saranno fondamentali nella lotta contro la disinformazione e l’abuso dei diritti d’immagine. Tuttavia, l’implementazione di queste soluzioni tecnologiche solleva una serie di interrogativi legati alla privacy e alla sicurezza. Chi controllerà questi algoritmi e garantirà che non vengano abusati per censurare contenuti legittimi o per violare i diritti di libera espressione?

La tecnologia stessa potrebbe essere sia la causa del problema che la sua soluzione. Se da un lato l’IA permette la creazione di contenuti falsificati con un livello di realismo mai visto prima, dall’altro lato, è l’IA che viene ora chiamata a combattere contro gli abusi generati da essa. In questo scenario, il confine tra l’innovazione tecnologica e la protezione dei diritti individuali diventa sempre più sottile, e le decisioni legislative future potrebbero avere un impatto fondamentale su come evolveranno queste tecnologie.

Un approccio globale al problema

Il “Take It Down Act” non si limita solo a rispondere ai deepfake porn, ma affronta un problema più ampio legato alla manipolazione dei contenuti digitali. La legge potrebbe fungere da modello per altre nazioni che stanno cercando di risolvere il problema della diffusione incontrollata di contenuti dannosi. Il rischio di danni reputazionali, emotivi e psicologici legati a contenuti deepfake non si limita agli Stati Uniti, ma ha un impatto globale, rendendo necessaria una risposta coordinata tra i vari paesi.

Il dibattito sulla regolamentazione dei contenuti generati da intelligenza artificiale è destinato ad intensificarsi nei prossimi anni. La tecnologia continua ad avanzare rapidamente, ma le leggi e le politiche governative faticano a tenere il passo con i cambiamenti. Sebbene l’approvazione del “Take It Down Act” rappresenti un importante passo verso la protezione delle persone contro gli abusi online, resta da vedere se questa legge sarà sufficiente a fermare il fenomeno e se altre legislazioni simili emergeranno su scala globale.