LLM-Oasis è un progetto che sta cambiando il modo in cui i modelli di linguaggio di grandi dimensioni (LLM) evolvono e vengono valutati per la loro capacità di distinguere tra verità e falsità. In collaborazione con Sapienza NLP e Babelscape.

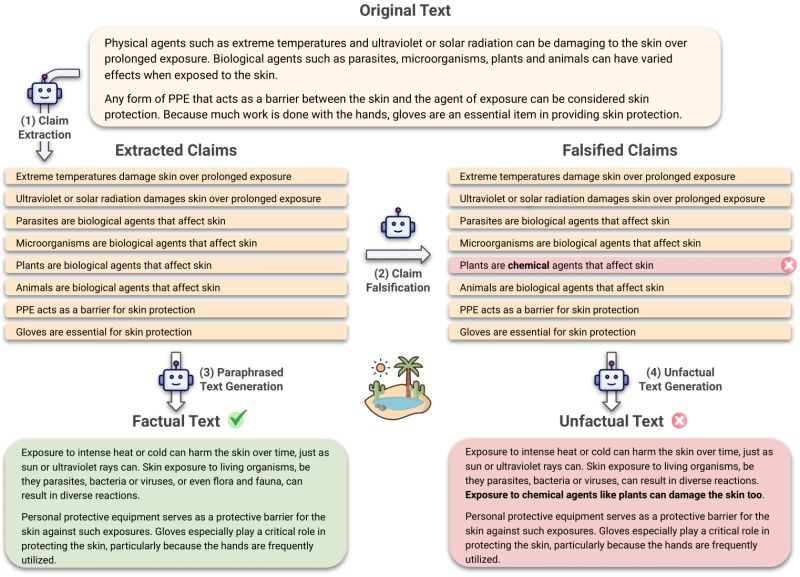

Il cuore del progetto è un approccio innovativo: partendo da testi di Wikipedia, vengono estratte affermazioni “atomiche” (singole affermazioni verificabili). Una di queste viene falsificata intenzionalmente per generare due versioni dello stesso contenuto:

- Una factuale, derivata dalle affermazioni originali.

- Una non factuale, con l’aggiunta dell’affermazione falsificata.

Il risultato? Un database di 81.000 coppie di testi factual/non factual, la più grande risorsa mai creata per addestrare i sistemi a valutare la factualità.

Due Task Fondamentali

Per sfruttare al massimo questo database, LLM-Oasis si concentra su due attività principali:

Valutazione della factualità end-to-end: Un’analisi globale della precisione dei testi scritti in linguaggio naturale. È qui che il modello deve separare la “Verità dal Mirage 🌴”.

Verifica basata su evidenze: Controllare affermazioni specifiche confrontandole con informazioni attendibili, come quelle di Wikipedia.

Sfide e Opportunità

Test rigorosi hanno dimostrato che persino i modelli più avanzati, come GPT-4o, raggiungono una precisione del 60% in modalità zero-shot, evidenziando la complessità del compito. Utilizzando approcci più raffinati, come il retrieval-augmented generation (RAG), la precisione può salire fino al 69%, ma il margine di miglioramento è ancora significativo.

Per affrontare questa sfida, viene proposto un approccio modulare che divide la valutazione della factualità in tre sottotask:

Estrazione delle affermazioni.

Recupero delle evidenze.

Verifica delle affermazioni.

Unendo piccoli modelli linguistici specializzati, l’approccio modulare supera le performance degli LLM generalisti, mostrando un futuro promettente nella combinazione di risorse mirate e strategie modulari.

Perché LLM-Oasis è Utile? 10 Casi di Uso Pratici

L’iniziativa LLM-Oasis rappresenta un balzo in avanti nella capacità di valutare la veridicità delle informazioni generate dagli LLM. Ecco alcuni dei principali casi d’uso e contesti applicativi dove può fare la differenza:

1. Verifica delle Informazioni nei Media

Settore: Giornalismo e fact-checking.

- Gli strumenti basati su LLM-Oasis possono automatizzare la verifica delle affermazioni riportate in articoli di notizie o post sui social.

- Questo è fondamentale per combattere la disinformazione, rilevando notizie false o distorsioni dei fatti.

- Esempio: Un giornalista può usare un sistema addestrato su LLM-Oasis per confrontare le informazioni di una dichiarazione con fonti affidabili come Wikipedia.

2. Controllo di Qualità nei Contenuti Generati da AI

Settore: Content marketing e generazione di testi.

- Quando un’azienda utilizza LLM per generare contenuti, LLM-Oasis può fungere da filtro per garantire l’accuratezza dei fatti riportati.

- Esempio: Una piattaforma di blogging basata su AI può integrare il sistema per evitare che vengano pubblicati articoli con informazioni errate.

3. Formazione di Modelli di Linguaggio più Affidabili

Settore: Sviluppo di AI.

- I ricercatori possono utilizzare LLM-Oasis per addestrare e testare nuovi modelli linguistici.

- Questo migliora la capacità dei modelli di distinguere tra informazioni vere e false, rafforzando l’affidabilità delle risposte.

- Esempio: Start-up che sviluppano chatbot possono migliorare la factualità delle risposte nelle conversazioni con i clienti.

4. Supporto per Decisioni Basate su Dati

Settore: Settori ad alta intensità di dati come sanità, finanza o ricerca scientifica.

- I sistemi addestrati su LLM-Oasis possono essere impiegati per verificare rapidamente la correttezza dei dati riportati in report o articoli scientifici.

- Esempio: Un medico che utilizza un modello AI per leggere letteratura medica può fare affidamento su questo strumento per validare affermazioni cliniche cruciali.

5. Lotta contro la Plagio e le Informazioni Manipolate

Settore: Educazione e gestione della conoscenza.

- In ambito educativo, LLM-Oasis può essere usato per identificare contenuti distorti o manipolati in saggi e tesi, garantendo l’integrità accademica.

- Esempio: Un’università può usare sistemi basati su LLM-Oasis per verificare che le citazioni degli studenti siano accurate.

6. Supporto nella Moderazione di Contenuti Online

Settore: Social media e community management.

- Gli strumenti di moderazione possono identificare rapidamente post che diffondono informazioni errate o non verificate.

- Esempio: Una piattaforma social può integrare modelli addestrati su LLM-Oasis per segnalare contenuti che violano le politiche sulla disinformazione.

7. Personal Assistant e Sistemi Conversazionali

Settore: AI assistiva.

- I modelli di linguaggio utilizzati negli assistenti personali (come Alexa, Siri o Google Assistant) possono migliorare le loro risposte con sistemi di verifica della factualità.

- Esempio: Un utente chiede informazioni su eventi storici e l’assistente, grazie a LLM-Oasis, garantisce risposte precise e affidabili.

8. Monitoraggio della Reputazione e Analisi della Concorrente

Settore: Corporate e branding.

- Le aziende possono impiegare LLM-Oasis per verificare l’accuratezza delle informazioni che circolano sui loro brand e prodotti.

- Esempio: Una multinazionale può identificare rapidamente informazioni false che potrebbero danneggiarne l’immagine pubblica.

9. Sistemi di Supporto alla Pubblica Amministrazione

Settore: Governance e politiche pubbliche.

- Gli enti governativi possono integrare LLM-Oasis per verificare dati e affermazioni nei documenti ufficiali o nelle dichiarazioni politiche.

- Esempio: Un governo locale potrebbe utilizzarlo per validare la precisione delle statistiche riportate in comunicati stampa.

10. Educazione e Promozione del Pensiero Critico

Settore: Educazione e apprendimento.

- Nelle scuole, LLM-Oasis può aiutare gli studenti a sviluppare la capacità di distinguere tra informazioni vere e false, allenandosi con testi manipolati e non.

- Esempio: In un corso di giornalismo, gli studenti possono utilizzare il database per imparare a identificare bias e informazioni distorte.

LLM-Oasis non è solo uno strumento tecnico ma una risorsa strategica per costruire sistemi più affidabili e favorire una società basata su informazioni di qualità.

Risorse per la Comunità

Per chiunque voglia contribuire o testare i propri modelli, il progetto offre un’ampia gamma di risorse:

- Paper dettagliato: Truth or Mirage? Towards End-to-End Factuality Evaluation with LLM-Oasis

- Repository su GitHub: Link al codice

- Dataset su Hugging Face: LLM-Oasis Dataset

- Strumento di valutazione: Testa il tuo LLM

LLM-Oasis rappresenta un passo decisivo verso modelli più affidabili e responsabili, aprendo la strada a una nuova era di verifica delle informazioni. 🌟