OpenAI ha introdotto “Sora,” il suo innovativo modello AI di testo a video, a febbraio, ma da allora le informazioni sullo sviluppo e il rilascio del prodotto sono state scarse. Tuttavia, recenti controversie potrebbero portare nuova luce sul progetto. Un gruppo di artisti beta tester ha presumibilmente reso pubblico l’accesso al modello per protestare contro quello che definiscono sfruttamento non retribuito per ricerca e sviluppo (R&D) e pubbliche relazioni (PR).

La fuga di Sora: Cosa è successo?

Martedì, un gruppo di tester di Sora ha affermato di aver distribuito l’accesso iniziale al modello, insieme a un’interfaccia funzionante per generare video. La notizia è emersa su Hugging Face, una piattaforma nota per ospitare modelli AI, dove gli utenti hanno avuto l’opportunità di creare numerosi video. Secondo TechCrunch, il contenuto generato era simile alle demo ufficiali di Sora, ma OpenAI ha rapidamente bloccato l’accesso.

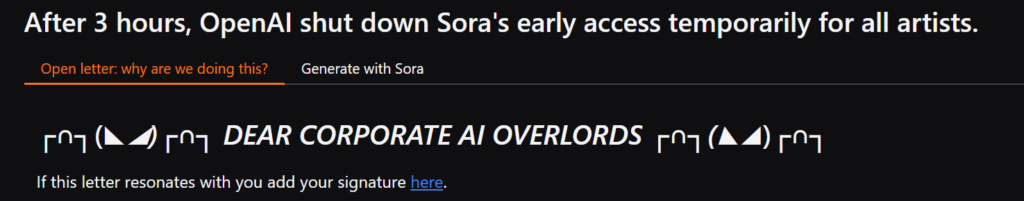

In una lettera aperta pubblicata dagli artisti, intitolata provocatoriamente “DEAR CORPORATE AI OVERLORDS” (Cari Signori AI Corporativi), i beta tester hanno espresso la loro frustrazione. Hanno accusato OpenAI di manipolare il programma artistico per legittimare la piattaforma senza fornire compensazioni o riconoscimenti adeguati.

Il gruppo ha evidenziato diversi problemi chiave nel loro comunicato:

Gli artisti coinvolti nel programma si sentono trasformati in strumenti gratuiti per il collaudo di bug, per il marketing e per la raccolta di dati.

Hanno accusato OpenAI di sfruttare il talento artistico per migliorare l’immagine pubblica di Sora, piuttosto che collaborare equamente.

Secondo i beta tester, OpenAI impone che ogni video generato venga approvato dalla sua squadra prima di essere condiviso pubblicamente, limitando la creatività e il controllo degli utenti.

Gli artisti riconoscono il potenziale dell’AI come strumento per l’arte, ma contestano l’approccio di OpenAI nel gestire il progetto, definendolo incentrato più sul profitto che sul supporto genuino alle comunità creative.

La risposta di OpenAI

OpenAI ha minimizzato la gravità delle accuse, affermando che il programma di anteprima è completamente volontario e che la partecipazione non comporta obblighi di feedback o utilizzo del tool. Niko Felix, portavoce dell’azienda, ha dichiarato: (TechCrunch)

“Sora è ancora in fase di ricerca e stiamo lavorando per bilanciare creatività e sicurezza. Centinaia di artisti hanno influenzato lo sviluppo del modello, contribuendo con idee e richieste di nuove funzionalità. La nostra missione è rendere Sora uno strumento utile e sicuro.”

Tuttavia, questa difesa non sembra convincere i critici, che sottolineano l’enorme disparità tra il valore finanziario di OpenAI, recentemente valutata $150 miliardi, e il mancato compenso agli artisti che stanno contribuendo al progetto.

L’ex CTO di OpenAI, Mira Murati, aveva annunciato a marzo che Sora sarebbe stato disponibile entro la fine dell’anno. Tuttavia, ha aggiunto che il rilascio dipende da verifiche approfondite su come il modello potrebbe influenzare questioni globali, come le elezioni.

In un AMA (Ask me anything) su Reddit, il CPO Kevin Weil ha citato problemi di scalabilità e sicurezza, tra cui la prevenzione di usi impropri e la tutela contro imitazioni o contenuti dannosi, come motivi principali dei ritardi.

Il caso di Sora mette in evidenza una tensione crescente tra le grandi aziende tecnologiche e le comunità creative. Se da un lato strumenti come Sora promettono di trasformare il panorama artistico, dall’altro sollevano interrogativi etici sul trattamento degli artisti e sulla distribuzione del valore creato con l’AI. La questione resta aperta: le aziende come OpenAI troveranno un equilibrio tra profitto, trasparenza e collaborazione autentica?