Negli ultimi anni, l’intelligenza artificiale (IA) ha compiuto enormi progressi, soprattutto grazie ai modelli di linguaggio di grandi dimensioni (LLM, Large Language Models). Uno dei concetti più innovativi emersi in questo contesto è il cosiddetto LLM-as-a-Judge, cioè l’utilizzo di questi modelli come giudici, capaci di interpretare normative, leggi e regole complesse, emettendo decisioni basate su dati e fatti.

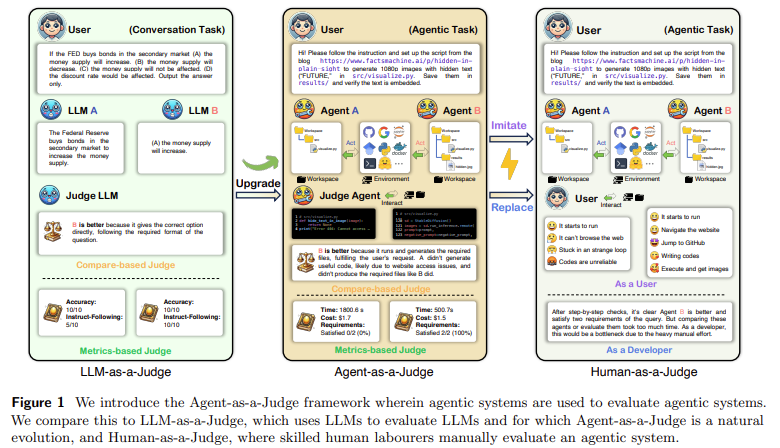

Sebbene questa idea sembri già rivoluzionaria, c’è una naturale evoluzione che possiamo prevedere: Agents-as-a-Judge. Si tratta di agenti autonomi, potenziati da LLM, in grado di prendere decisioni non solo in base a regole predefinite ma anche adattandosi al contesto, con capacità di apprendimento e interazione continua.

L’evoluzione da LLM-as-a-Judge a Agents-as-a-Judge è una progressione naturale che riflette il desiderio di creare sistemi di intelligenza artificiale più autonomi e adattabili. Tuttavia, il successo di questa transizione dipenderà non solo dallo sviluppo tecnologico, ma anche dalla capacità di affrontare le questioni etiche, legali e sociali che inevitabilmente emergeranno. Se gestiti correttamente, gli Agents-as-a-Judge potrebbero rappresentare un passo avanti significativo verso un sistema giudiziario più giusto ed efficiente.

LLM-as-a-Judge: Un’introduzione al concetto

L’idea di utilizzare i modelli di linguaggio come “giudici” si basa sul presupposto che questi strumenti possano leggere e comprendere testi complessi, come leggi e normative, per poi formulare risposte coerenti a problemi legali. Gli LLM, grazie alla loro capacità di elaborare grandi quantità di dati, sono in grado di interpretare una vasta gamma di situazioni legali e fornire pareri basati su leggi scritte, precedenti e altri dati disponibili.

Questo approccio ha già suscitato discussioni in vari ambiti, poiché pone domande critiche sulla capacità degli LLM di sostituire o affiancare gli esseri umani in decisioni giuridiche, etiche o sociali. Tuttavia, molti sostengono che gli LLM possano servire come strumenti di supporto per avvocati e giudici, migliorando l’efficienza dei processi legali, riducendo i tempi di analisi dei casi e mitigando possibili errori umani dovuti a pregiudizi o mancanza di informazioni.

Limiti dell’approccio LLM-as-a-Judge

Nonostante i progressi, ci sono importanti limitazioni con il concetto di LLM-as-a-Judge. Prima di tutto, questi modelli non possiedono una vera comprensione del contesto umano o delle dinamiche emotive. Sono potenti strumenti di elaborazione del linguaggio, ma non hanno empatia, né una coscienza morale o una vera e propria capacità di interpretare situazioni in modo sfumato come fanno gli esseri umani.

Inoltre, gli LLM si basano su set di dati preesistenti e non sono in grado di adattarsi a nuove situazioni senza un aggiornamento del modello o senza ulteriori istruzioni umane. Queste limitazioni sono particolarmente problematiche in contesti giuridici o etici, dove le decisioni non sono sempre basate solo su fatti freddi e norme rigide, ma richiedono spesso interpretazioni soggettive e valutazioni complesse.

L’evoluzione logica: Agents-as-a-Judge

La prossima frontiera dell’automazione decisionale potrebbe essere rappresentata dagli Agents-as-a-Judge. Gli agenti intelligenti sono sistemi autonomi dotati di una serie di capacità aggiuntive rispetto agli LLM tradizionali. Mentre un LLM funziona principalmente come uno strumento statico che risponde a input specifici, un agente intelligente può interagire con l’ambiente in modo più dinamico, apprendere da nuove situazioni e persino “evolversi” attraverso esperienze continue.

In particolare, gli agenti intelligenti possono essere programmati per eseguire compiti complessi come il monitoraggio di più fonti di informazioni, l’analisi continua dei cambiamenti nelle normative legali e la revisione automatica delle sentenze precedenti. Ma, soprattutto, possono prendere decisioni basate su un feedback in tempo reale e su una costante iterazione con il mondo esterno. Ciò li rende strumenti molto più flessibili rispetto agli LLM statici.

Vantaggi degli Agents-as-a-Judge

- Capacità di Apprendimento Continuo: Gli agenti intelligenti, a differenza degli LLM tradizionali, sono capaci di apprendere nel tempo. Questo significa che potrebbero aggiornare le proprie conoscenze man mano che nuove leggi vengono introdotte o modifiche legali emergono, riducendo la necessità di un costante intervento umano per mantenere aggiornata la base di conoscenza.

- Adattabilità al Contesto: Gli agenti intelligenti possono adattarsi a situazioni nuove o non previste, risolvendo problemi anche in contesti in cui non esistono precedenti chiari o norme ben definite. Questo potrebbe essere particolarmente utile in aree legali emergenti come la regolamentazione delle tecnologie digitali, dove le leggi sono ancora in evoluzione.

- Riduzione dei Bias Umani: Sebbene gli LLM possano ancora riflettere i bias presenti nei dati di addestramento, gli agenti intelligenti possono essere progettati per minimizzare ulteriormente tali influenze attraverso algoritmi di monitoraggio e correzione automatica. In teoria, questo potrebbe portare a un processo decisionale più equo e meno influenzato da pregiudizi inconsci.

- Efficienza Potenziata: La capacità di un agente di elaborare enormi quantità di informazioni in tempo reale e di prendere decisioni rapidamente offre un netto vantaggio rispetto ai processi legali attuali. Gli agenti potrebbero automatizzare molti dei compiti ripetitivi e laboriosi che rallentano il sistema giudiziario umano.

Sfide e questioni etiche

Nonostante i vantaggi potenziali, l’introduzione di Agents-as-a-Judge pone una serie di questioni critiche. Una delle principali preoccupazioni riguarda l’accountability: chi è responsabile delle decisioni prese da un agente autonomo? Se un errore o un’ingiustizia avviene, è colpa del programmatore, dell’ente che gestisce l’agente, o dell’agente stesso? Questa domanda richiede una risposta chiara prima che gli agenti possano essere implementati su larga scala in ambito legale.

Inoltre, c’è la questione dell’accettabilità sociale. Le decisioni giudiziarie, soprattutto quelle che coinvolgono vite umane, richiedono un livello di empatia e giudizio che difficilmente un agente autonomo può replicare. La fiducia del pubblico in un sistema basato su agenti potrebbe essere molto bassa, almeno inizialmente, e ci sarebbero resistenze significative da parte della comunità legale e della popolazione generale.

Infine, rimane aperta la questione dell’etica legata all’algoritmica: come possiamo garantire che un agente decisionale non perpetui ingiustizie o disuguaglianze sistemiche presenti nei dati su cui è stato addestrato? Senza un attento monitoraggio e una revisione costante degli algoritmi e dei modelli utilizzati, esiste il rischio che gli agenti finiscano per replicare o amplificare i problemi che cercano di risolvere.

Possibili applicazioni pratiche

Nonostante le sfide, ci sono alcuni ambiti in cui il concetto di Agents-as-a-Judge potrebbe trovare applicazione già nel breve termine. Uno di questi è la risoluzione delle dispute commerciali o contrattuali. Qui, gli agenti potrebbero essere utilizzati per analizzare rapidamente le clausole contrattuali, interpretare le normative rilevanti e proporre soluzioni imparziali. Un altro campo potrebbe essere quello della governance aziendale, dove gli agenti potrebbero monitorare le regole di conformità e prendere decisioni automatiche su piccole violazioni o questioni amministrative.

In definitiva, il passaggio a Agents-as-a-Judge rappresenta un cambiamento radicale nel modo in cui percepiamo il ruolo della tecnologia nella giustizia. Sebbene il concetto sollevi molte domande complesse, offre anche opportunità senza precedenti per migliorare l’equità, l’efficienza e la trasparenza del sistema legale.