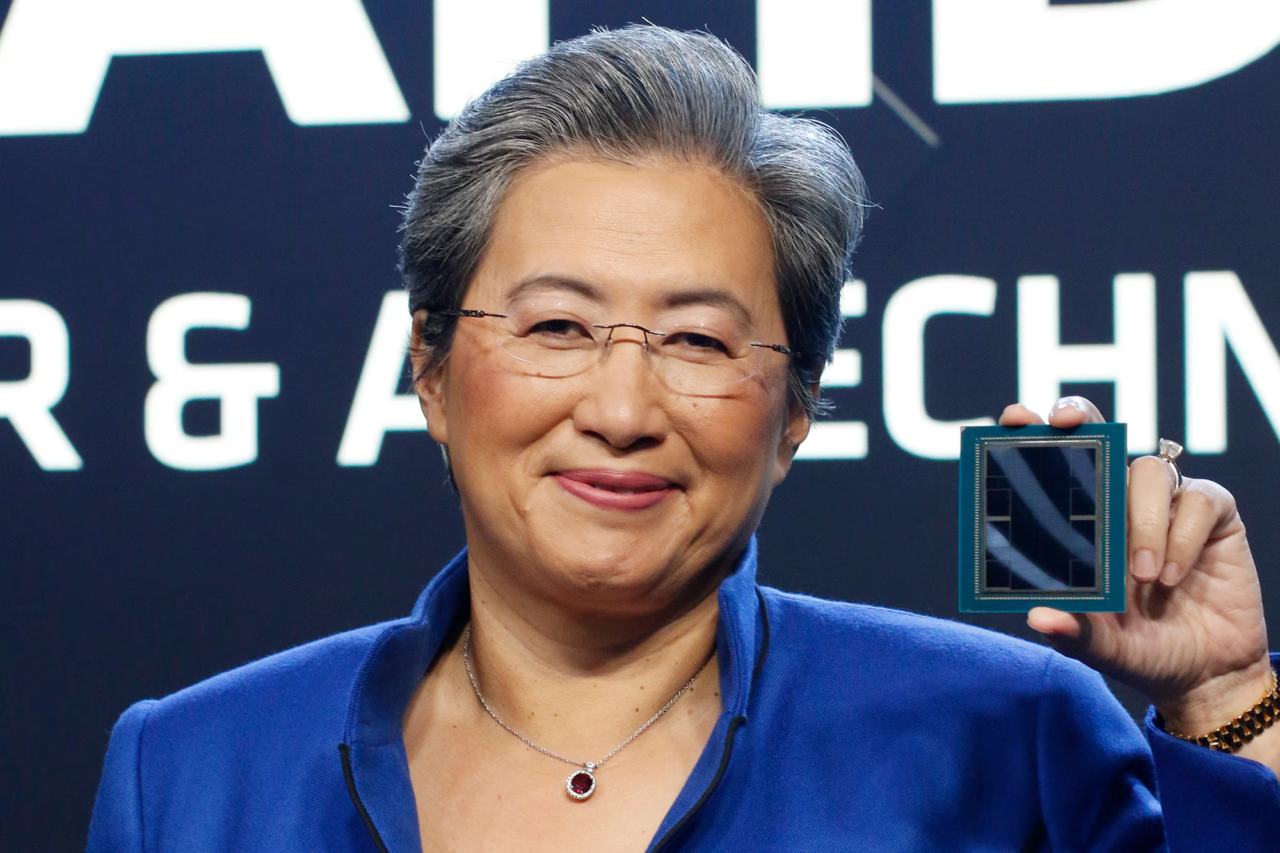

AMD ha svelato il suo ultimo chip per intelligenza artificiale, l’Instinct MI325X, durante un evento volto a sfidare il dominio di Nvidia nel mercato delle GPU per data center. Questo nuovo chip inizierà la produzione entro la fine del 2024 ed è progettato per competere direttamente con i prossimi chip Blackwell di Nvidia, che si prevede inizieranno a essere spediti all’inizio del prossimo anno.

Caratteristiche Chiave dell’Instinct MI325X

Memoria e Prestazioni: L’MI325X presenta 256 GB di memoria HBM3E e offre 6 TB/s di larghezza di banda della memoria, segnando un miglioramento significativo rispetto al suo predecessore, l’MI300X. AMD afferma che offre fino al 40% in più di prestazioni di inferenza rispetto alla GPU H200 di Nvidia, in particolare quando si utilizza il modello AI Llama di Meta.

Architettura: Costruito sulla architettura CDNA 3 di AMD, l’MI325X è ottimizzato per carichi di lavoro AI ad alte prestazioni, rendendolo adatto per applicazioni che richiedono un’elaborazione e inferenza rapida dei dati.

Strategia di Rilascio Annuale: AMD prevede di accelerare il proprio programma di rilascio dei prodotti, con chip futuri designati come MI350 per il 2025 e MI400 per il 2026, con l’obiettivo di tenere il passo con le innovazioni di Nvidia.

L’ingresso di AMD in questo panorama competitivo avviene in un momento in cui la domanda di chip AI sta aumentando, guidata dalle esigenze delle tecnologie AI generative come ChatGPT di OpenAI. Si prevede che il mercato totale per l’hardware AI raggiunga i 500 miliardi di dollari entro il 2028, e AMD si sta posizionando per catturare una quota maggiore da Nvidia, che attualmente detiene oltre il 90% del mercato delle GPU AI per data center.

Nonostante questi progressi, AMD deve affrontare ostacoli significativi:

Ecosistema Software: Il linguaggio di programmazione proprietario CUDA di Nvidia è diventato uno standard tra gli sviluppatori AI, creando una barriera per AMD. In risposta, AMD sta migliorando la sua piattaforma software ROCm per facilitare transizioni più semplici per gli sviluppatori che desiderano passare ai suoi chip.

Sentiment degli Investitori: Mentre le azioni di AMD sono aumentate solo del 20% nel 2024, quelle di Nvidia sono schizzate oltre il 175%, riflettendo la fiducia degli investitori nella posizione consolidata e nei prossimi prodotti di Nvidia.

AMD si prepara a procurarsi chip di calcolo ad alte prestazioni dalla fabbrica TSMC in Arizona, diventando così un altro cliente di questo nuovo impianto americano. La produzione è già in fase di pianificazione, con il “tape out” e la fabbricazione dei chip HPC di AMD previsti per iniziare nel 2025 utilizzando il nodo a 5nm di TSMC.

Questo sviluppo segue l’inizio della produzione dei chip A16 di Apple, che è già in corso e potrebbe portare a spedizioni entro la fine dell’anno. La presenza di AMD in Arizona rappresenta un passo significativo verso la creazione di una catena di approvvigionamento per l’hardware AI interamente negli Stati Uniti, riducendo la dipendenza dalla produzione estera.

Inoltre, TSMC e Amkor hanno annunciato una collaborazione su tecnologie avanzate di imballaggio, fondamentali per i chip AI, ma inizialmente i chip prodotti dovranno essere inviati a Taiwan per l’imballaggio fino a quando non sarà operativo un nuovo impianto di Amkor in Arizona.