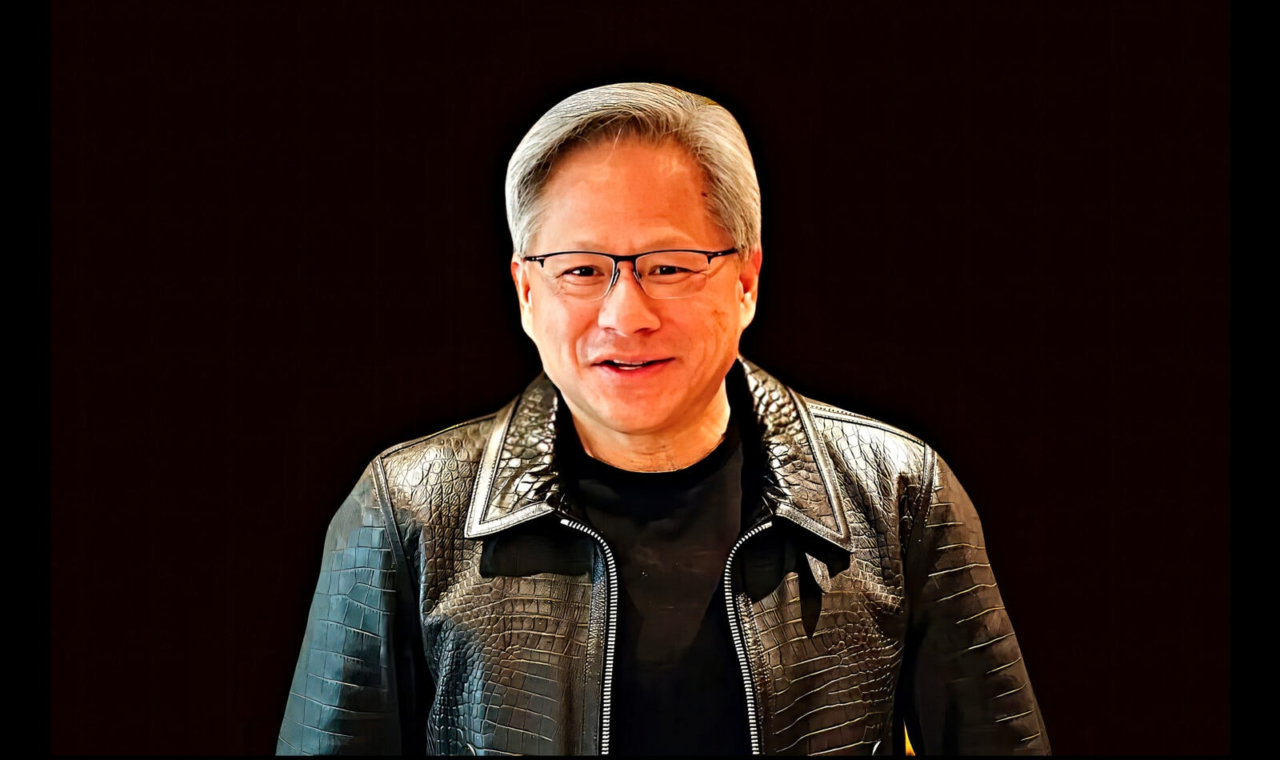

Jensen Huang, CEO di Nvidia, ha dichiarato che il futuro dell’intelligenza artificiale (AI) sarà caratterizzato da servizi in grado di “ragionare”. Tuttavia, ha sottolineato che è necessario ridurre i costi di calcolo per raggiungere questa fase, come riportato da Bloomberg News.

Durante un podcast con Rene Haas, CEO di Arm, Huang ha spiegato che i prossimi strumenti AI saranno in grado di rispondere a domande attraverso centinaia o migliaia di passaggi, riflettendo sulle proprie conclusioni. Questo approccio differenzierà il software futuro dagli attuali sistemi come ChatGPT, che Huang utilizza quotidianamente.

Huang ha aggiunto che Nvidia si impegnerà a migliorare le prestazioni dei chip ogni anno da due a tre volte, mantenendo lo stesso livello di energia e costo. Questa evoluzione cambierà il modo in cui i sistemi AI gestiscono l’inferenza, un processo in cui un modello AI produce previsioni o conclusioni. “Siamo in grado di ridurre notevolmente i costi per l’intelligenza”, ha affermato Huang, evidenziando l’importanza di abbattere i costi per consentire ragionamenti complessi durante l’inferenza.

Martedì, Nvidia ha presentato la prossima fase dell’AI durante il suo AI Summit a Washington D.C., con applicazioni che spaziano da agenti AI avanzati a fabbriche automatizzate, previsione meteorologica, cura del cancro e contatti con forme di vita extraterrestri. Questi sviluppi evidenziano l’ambizione di Nvidia di non essere solo un produttore di chip, ma anche un leader nel software AI, creando nuove opportunità di entrate oltre le vendite hardware148.