Ovis-1.6 rappresenta un significativo avanzamento nel campo dell’intelligenza artificiale, sviluppato da Alibaba Group e dall’Università di Nanchino. Questo modello affronta una delle sfide più critiche nel trattamento dei dati multimodali: il disallineamento tra dati visivi e testuali.

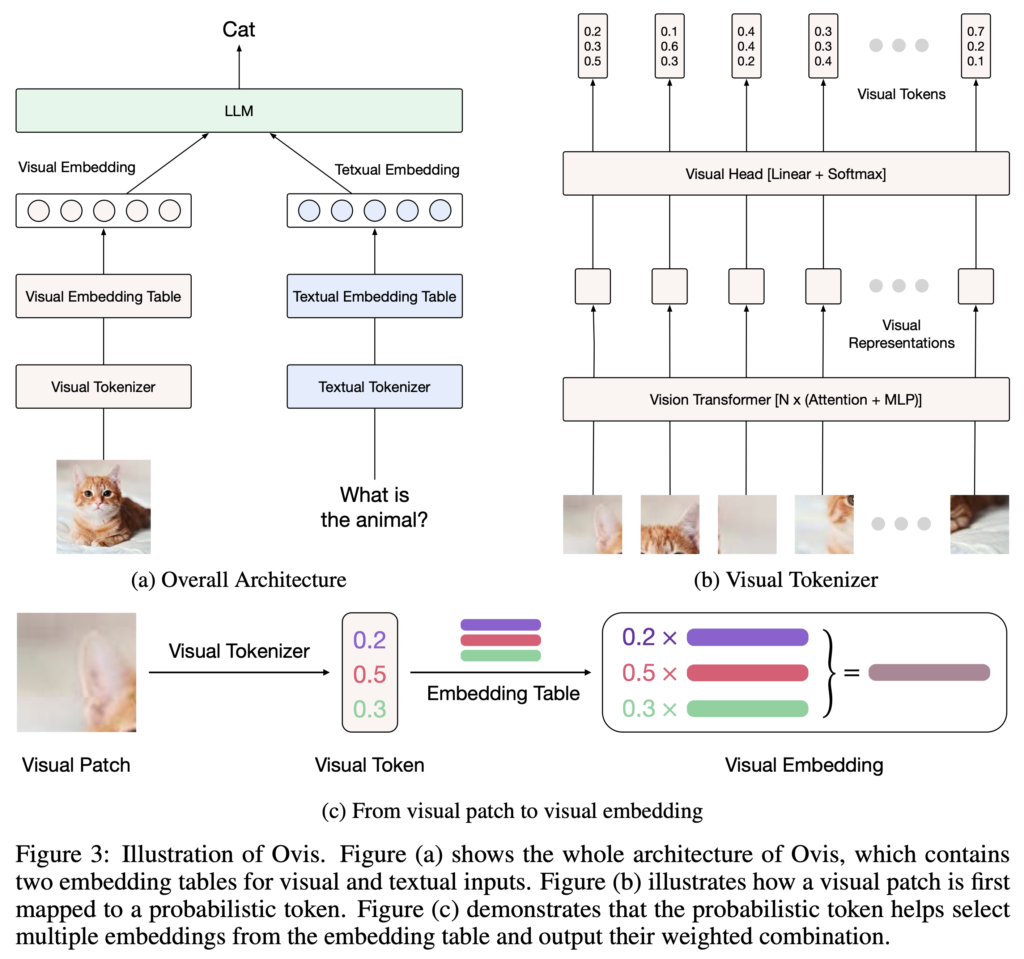

La tabella di consultazione visuale introdotta da Ovis-1.6 è una soluzione innovativa che organizza i dati delle immagini in un formato strutturato, simile a quello del testo. Questa struttura consente al modello di integrare informazioni visive e testuali in modo fluido, migliorando le prestazioni in diverse attività di intelligenza artificiale.

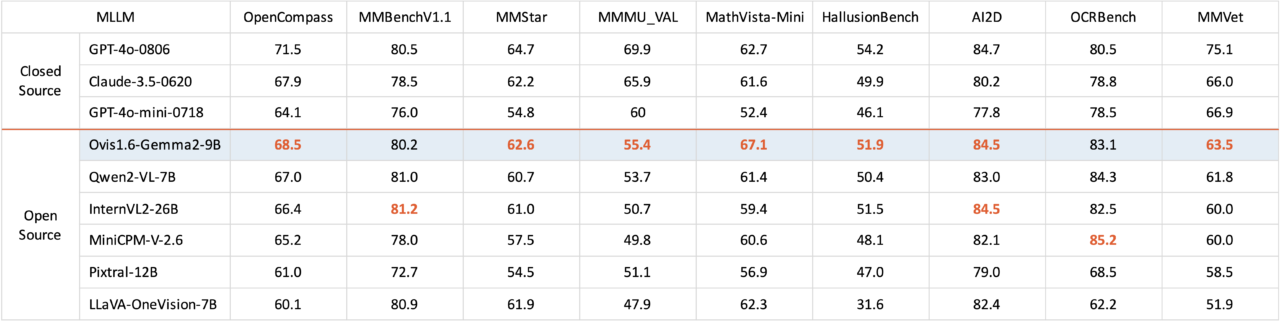

Ovis-1.6 ha ottenuto risultati impressionanti nel benchmark RealWorldQA, registrando un punteggio di 2230. Questo supera il punteggio di 2038 ottenuto da GPT-4V, evidenziando un miglioramento di 192 punti. Tali risultati dimostrano l’efficacia del nuovo approccio nella gestione dei dati multimodali e la capacità del modello di affrontare compiti complessi con maggiore precisione.

L’implementazione di Ovis-1.6 potrebbe avere ampie implicazioni per vari settori, inclusi quelli della ricerca, dell’educazione e dell’industria. La capacità di combinare efficacemente dati visivi e testuali potrebbe aprire nuove strade per applicazioni pratiche, come assistenti virtuali più intelligenti e sistemi di raccomandazione avanzati.

In sintesi, Ovis-1.6 non solo migliora la comprensione e l’elaborazione dei dati multimodali, ma segna anche un passo avanti significativo verso modelli di intelligenza artificiale più integrati e reattivi alle esigenze umane.