Un team di ricercatori dell’Università dell’Alberta guidati da Shibhansh Dohare ha recentemente pubblicato uno studio sulla rivista Nature, presentando un metodo innovativo che potrebbe rivoluzionare il campo dell’intelligenza artificiale (IA) consentendo un apprendimento continuo e indefinito.

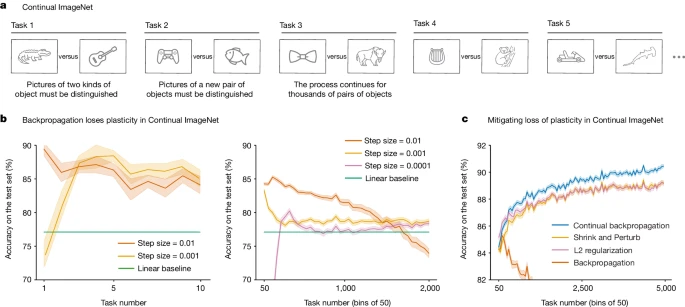

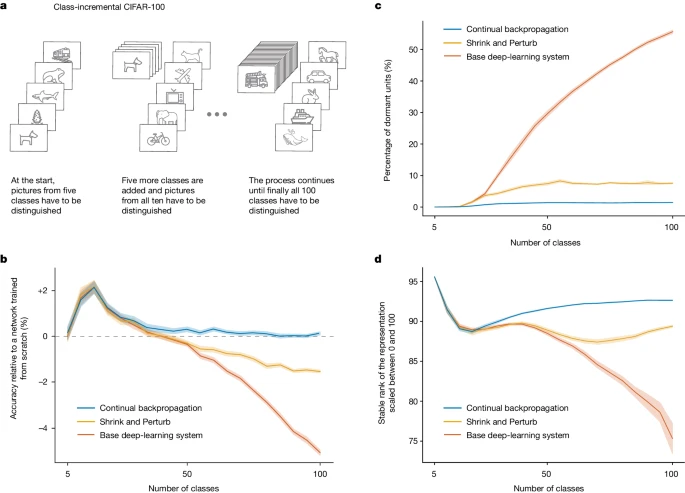

Questa ricerca affronta un problema cruciale dei sistemi di deep learning attuali, noto come “perdita di plasticità“, che si verifica quando le reti neurali artificiali perdono la loro capacità di apprendimento durante l’addestramento su nuovi dati.

Loss of plasticity in deep continual learning

Le reti neurali, utilizzate in molte applicazioni di IA, inclusi i modelli linguistici di grandi dimensioni (LLM) per i chatbot, tendono a dimenticare le informazioni precedentemente apprese quando vengono esposte a nuovi set di dati. Questo fenomeno di “dimenticanza” è particolarmente problematico quando i sistemi vengono addestrati sequenzialmente su molteplici compiti, riducendo la loro efficacia e precisione nel tempo.

I ricercatori hanno identificato che la reinizializzazione dei “pesi” associati ai nodi delle reti neurali tra le diverse sessioni di addestramento può mantenere la plasticità del sistema. I pesi sono parametri fondamentali che determinano l’importanza dei nodi nell’elaborazione delle informazioni. Utilizzando metodi di reinizializzazione simili a quelli impiegati durante l’inizializzazione originale, è possibile permettere alle reti neurali di continuare ad apprendere su nuovi dati senza perdere le competenze già acquisite.

Questa scoperta ha il potenziale di sviluppare sistemi di IA più adattabili e flessibili, capaci di apprendere continuamente, simili al cervello umano. Le applicazioni potrebbero includere assistenti virtuali più intelligenti e sistemi di analisi dei dati avanzati, che si evolvono e migliorano costantemente. Inoltre, potrebbe contribuire a ridurre i fenomeni di “allucinazione” nei sistemi attuali, dove le IA generano informazioni errate o fuorvianti, come dimostrato da recenti incidenti con chatbot che hanno fornito citazioni false.

Il Dr. Shibhansh Dohare, autore principale dello studio, ha evidenziato l’importanza di questo approccio, suggerendo che rappresenta un passo significativo verso lo sviluppo di intelligenze artificiali capaci di apprendimento continuo e adattamento a lungo termine[2]. Sebbene la ricerca sia ancora nelle fasi iniziali, le potenziali applicazioni sono vastissime e potrebbero trasformare radicalmente il panorama dell’intelligenza artificiale.