Nvidia ha dominato il mercato delle GPU grazie all’esplosione dell’intelligenza artificiale, ma recenti analisi rivelano una vulnerabilità significativa nelle sue tecnologie, in particolare nella generazione di video. Questo aspetto potrebbe influenzare la sua posizione di mercato e aprire opportunità per i concorrenti.

Nvidia è stata la protagonista indiscussa nel settore delle GPU, capitalizzando sulla crescente domanda di potenza di calcolo per applicazioni di intelligenza artificiale. Le sue schede grafiche sono diventate lo standard per molte applicazioni, dai giochi ai data center, portando l’azienda a ottenere profitti record.

Tuttavia, questo successo ha attirato l’attenzione delle autorità, con il Dipartimento di Giustizia degli Stati Uniti che ha avviato un’indagine su presunti comportamenti anticoncorrenziali da parte della società.

Nonostante il predominio di Nvidia, la generazione di video rappresenta un’area in cui i suoi prodotti mostrano delle debolezze. Le tecnologie di generazione video, che stanno diventando sempre più rilevanti nell’era dell’AI, non riescono a tenere il passo con le aspettative del mercato. Questa lacuna potrebbe consentire ai concorrenti di emergere e offrire soluzioni più avanzate e competitive.

La vulnerabilità di Nvidia nella generazione di video potrebbe avere ripercussioni significative. Aziende come AMD e Intel, che stanno investendo nella ricerca e nello sviluppo di tecnologie alternative, potrebbero sfruttare questa opportunità per guadagnare quote di mercato.

La competizione si intensificherà, poiché i concorrenti cercano di capitalizzare le debolezze di Nvidia, offrendo prodotti che soddisfano meglio le esigenze emergenti nel campo della generazione video.

Di seguito sono elencate le principali criticità.

Limitazioni nella Generazione di Video

Nvidia ha sviluppato tecnologie avanzate per la generazione di video, come il DLSS (Deep Learning Super Sampling), ma ci sono limiti intrinseci a queste soluzioni. Ad esempio, il DLSS può non sempre garantire risultati ottimali in tutte le situazioni di rendering, specialmente in scenari complessi o in tempo reale. Questo può portare a una qualità dell’immagine inferiore rispetto a quanto atteso, specialmente in contesti dove la fedeltà visiva è cruciale.

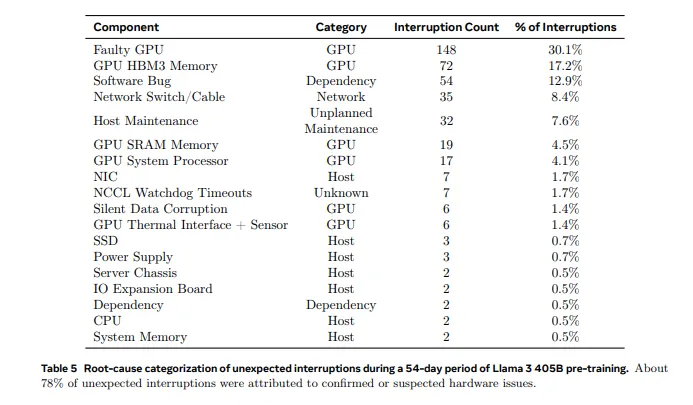

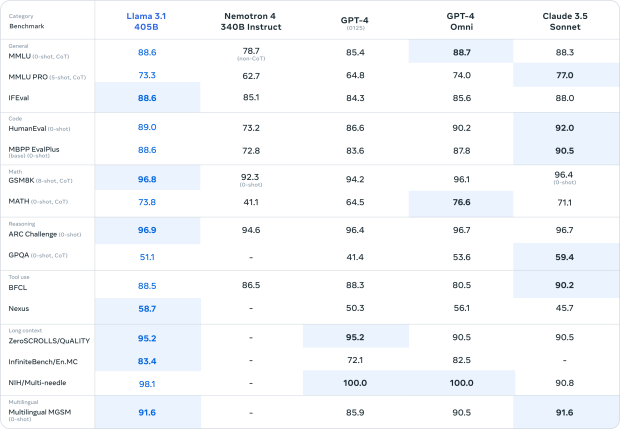

Le GPU Nvidia H100, nonostante le loro elevate prestazioni, stanno affrontando sfide significative legate alla memoria durante il training di modelli complessi.

Recenti report indicano che la memoria HBM3 delle H100 ha causato frequenti guasti nei cluster di addestramento, con un guasto ogni tre ore per un sistema composto da 16.384 GPU.

Questo problema di affidabilità è preoccupante, specialmente considerando l’uso intensivo di queste GPU in applicazioni di intelligenza artificiale generativa.Inoltre, anche se le H100 offrono capacità computazionali senza pari e sono progettate per gestire enormi set di dati, ci sono limiti pratici nella loro applicazione per il training di modelli sempre più grandi.

La necessità di una maggiore memoria per gestire modelli complessi è diventata evidente, portando a discussioni su alternative come il Gaudi 2 di Intel, che è stato presentato come una soluzione scalabile e accessibile.

Le GPU Nvidia H100 difettose e la memoria HBM3 hanno causato la metà dei guasti durante l’addestramento di LLama 3: un guasto ogni tre ore per il cluster di addestramento da 16.384 GPU di Meta

Problemi di Compatibilità

Le GPU Nvidia possono presentare problemi di compatibilità con alcuni software di editing video e di rendering. Ad esempio, in applicazioni come Photoshop, l’uso della GPU può causare crash o malfunzionamenti se non sono soddisfatte specifiche condizioni di compatibilità hardware e software. Questo è particolarmente problematico per i professionisti che necessitano di un flusso di lavoro fluido e senza interruzioni.

Elevato Consumo Energetico

Le schede grafiche Nvidia, in particolare quelle di fascia alta, tendono a consumare una quantità significativa di energia durante l’elaborazione video. Questo non solo può portare a costi operativi più elevati, ma può anche limitare l’uso in ambienti con restrizioni energetiche, come i data center che cercano di ottimizzare l’efficienza energetica.

Prezzi Elevati

Le GPU Nvidia, soprattutto quelle più recenti e performanti, sono spesso vendute a prezzi molto elevati. Questo può rappresentare un ostacolo per i piccoli studi di produzione video o per i creatori di contenuti indipendenti che desiderano accedere a tecnologie avanzate senza dover affrontare spese proibitive.

Complessità nell’Utilizzo delle Funzionalità Avanzate

Le funzionalità avanzate delle GPU Nvidia, come il ray tracing e l’AI-driven video enhancement, richiedono una certa competenza tecnica per essere implementate correttamente. Gli utenti meno esperti possono trovare difficile sfruttare appieno queste tecnologie, limitando l’accessibilità e l’efficacia delle soluzioni Nvidia nella generazione di video.

Concorrenza Crescente

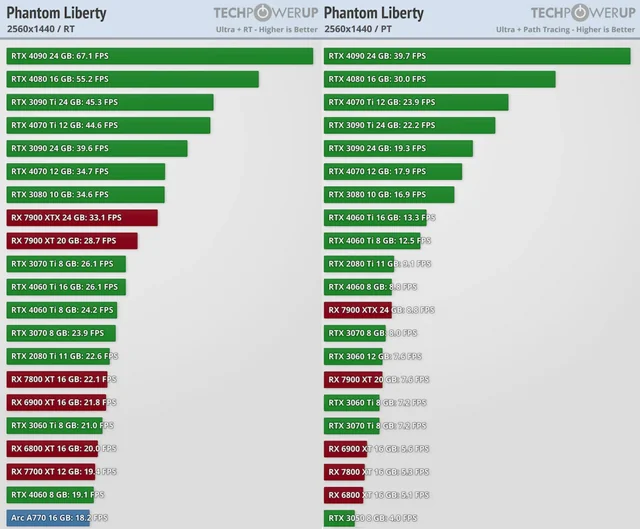

Infine, la crescente concorrenza da parte di altri produttori di GPU, come AMD, sta mettendo pressione su Nvidia. Le nuove tecnologie e approcci da parte di concorrenti possono superare le capacità attuali di Nvidia nella generazione di video, costringendo l’azienda a innovare continuamente per mantenere la sua posizione di mercato.

Cinebench 2024 Favorisce le GPU Nvidia

Cinebench 2024 sembra favorire le GPU Nvidia rispetto a quelle AMD e Intel per alcuni motivi chiave:Le GPU Nvidia dispongono di hardware dedicato per il ray tracing, ben utilizzato nel carico di lavoro di rendering di Cinebench 2024, che utilizza il renderer Redshift.

Questo si allinea con le forti prestazioni di Nvidia nei benchmark di gioco.L’API CUDA di Nvidia è meglio ottimizzata e più facile da programmare per alte prestazioni rispetto al stack HIP/ROCm di AMD.

Il percorso CUDA in Cinebench 2024 è molto più ottimizzato rispetto al percorso AMD, dando a Nvidia un vantaggio significativo.

L’architettura Ada Lovelace di Nvidia ha un riordino dell’esecuzione degli shader che fornisce un aumento delle prestazioni CUDA. Questa caratteristica non è presente nelle GPU AMD o Intel.Nei test, una Nvidia RTX 4090 si è rivelata quasi 4 volte più veloce rispetto alla GPU M2 Ultra di fascia alta in Cinebench 2024.

La M2 Ultra ha 76 core GPU rispetto ai 4090, ma rimane comunque indietro di un ampio margine.Cinebench 2024 non utilizza i core tensor o i core RT di Nvidia, quindi il vantaggio riguarda maggiormente l’ottimizzazione complessiva di CUDA e le prestazioni degli shader. Anche le GPU Nvidia più vecchie, come Pascal, possono ancora competere bene.

Cinebench 2024 non usa i resolver RT o le unità tensoriali. Funzionerà con la capacità di calcolo 5.0 e Turing (con RT e tensori) non ha molti vantaggi rispetto a Pascal (che non li usa).

È che è implementato molto meglio in CUDA che in HIP/ROCm . È anche molto più facile scrivere codice altamente performante in CUDA che in ROCm .

Ciò significa che Cinebench non è paragonabile tra Nvidia e AMD/Intel, utilizza codice GPGPU diverso. Se il codepath HIP/ROCm fosse più ottimizzato, l’hardware AMD (e Intel) ne trarrebbe vantaggio in modo sostanziale: ma non è così, e questo è molto spesso il caso nel mondo reale.

Le GPU Ada dispongono di un riordino dell’esecuzione degli shader che migliora notevolmente l’esecuzione CUDA.