Distinguersi in un mercato sovraffollato come quello degli smartphone, dove le differenze tra i prodotti sono sempre più sottili, rappresenta una sfida complessa che poche aziende riescono a superare. In questo contesto, Google ha dimostrato la sua capacità di innovare durante l’evento Made by Google, riuscendo a creare una netta differenziazione grazie all’integrazione avanzata delle capacità software basate sull’intelligenza artificiale nella nuova linea di telefoni Pixel 9. Questo approccio, focalizzato su esperienze d’uso uniche e su funzioni pratiche, rappresenta un passo significativo nell’evoluzione degli smartphone.

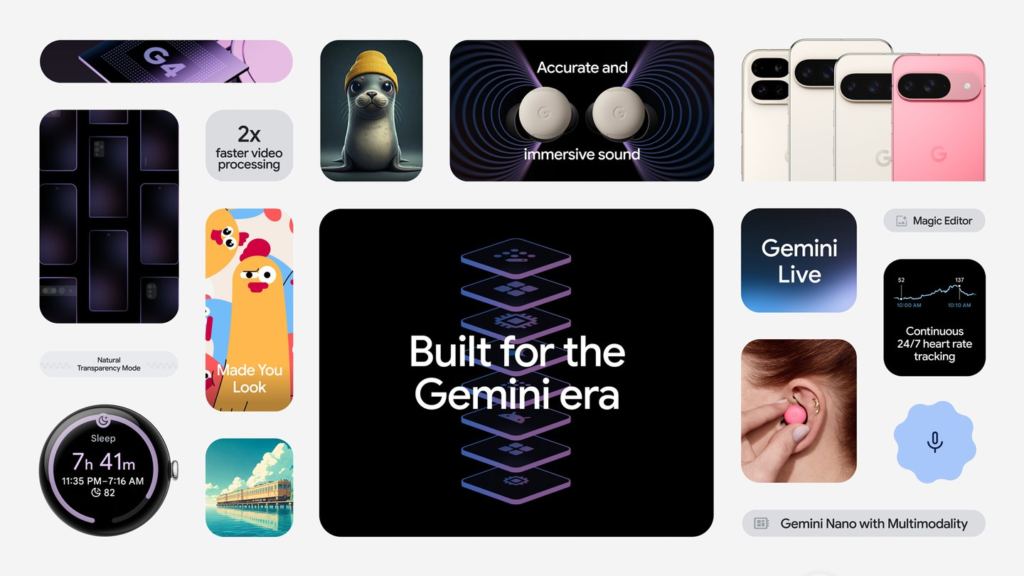

Uno degli elementi chiave che ha permesso a Google di emergere è la profonda integrazione dei modelli di intelligenza artificiale Gemini AI, che hanno trasformato la nuova linea di Pixel 9 in dispositivi non solo potenti, ma anche straordinariamente versatili. Grazie a Gemini AI, Google ha potuto offrire un ampio ventaglio di funzionalità, rendendo i Pixel 9 più che semplici telefoni: strumenti intelligenti capaci di adattarsi alle esigenze degli utenti in modo fluido e intuitivo. Ad esempio, Gemini Live, con la sua funzionalità di assistente AI conversazionale, rappresenta un progresso significativo nel modo in cui interagiamo con la tecnologia. Non si tratta più di semplici comandi vocali, ma di vere e proprie conversazioni che simulano un’interazione umana, rendendo l’uso dello smartphone un’esperienza più naturale e coinvolgente.

La funzione Call Notes, che consente di trascrivere e riassumere le chiamate vocali, è un altro esempio di come Google stia ripensando le funzionalità di base di uno smartphone per renderle più utili nella vita quotidiana. In un mondo in cui la gestione delle informazioni è sempre più cruciale, strumenti come questi possono davvero fare la differenza, facilitando l’organizzazione personale e professionale degli utenti.

Non solo software: anche sul fronte hardware Google ha saputo innovare, pur mantenendo una certa continuità con i modelli precedenti. I Pixel 9, 9 Pro e 9 Pro XL, con i loro schermi da 6,3 e 6,8 pollici, rappresentano l’evoluzione naturale del design tradizionale degli smartphone in vetro, ma con un tocco di novità nel layout della fotocamera posteriore. Questo dettaglio, apparentemente minore, contribuisce a dare ai nuovi Pixel un aspetto distintivo, pur restando fedeli alle linee classiche degli smartphone Google.

Il vero cambiamento di design, tuttavia, si manifesta nel Pixel 9 Pro Fold, dove Google ha osato di più, proponendo un dispositivo pieghevole con una forma più corta, larga e sottile rispetto ai concorrenti sul mercato. Questo non solo offre un design più elegante e pratico, ma risponde anche alle esigenze di quegli utenti che desiderano un dispositivo versatile, capace di combinare la comodità di uno smartphone tradizionale con i vantaggi di un ampio schermo pieghevole da 8 pollici. Questo aspetto rende il Pixel 9 Pro Fold non solo un’alternativa ai pieghevoli esistenti, ma una scelta innovativa che ridefinisce l’esperienza d’uso di questa categoria di dispositivi.

Sotto la scocca, i nuovi Pixel 9 sono equipaggiati con il chip Tensor G4, l’ultima evoluzione della linea di processori mobili di Google, sviluppato in collaborazione con Samsung. Il Tensor G4 non è solo un processore potente, ma rappresenta anche un perfetto esempio di come l’integrazione tra hardware e software possa portare a risultati eccezionali. I core CPU e GPU ARM standard sono affiancati dall’acceleratore AI TPU di Google, che ottimizza le prestazioni dei modelli di intelligenza artificiale, garantendo un’esperienza d’uso fluida e reattiva. Questo permette ai Pixel 9 di gestire le funzionalità AI in modo efficiente, rendendoli dispositivi all’avanguardia non solo per la potenza di calcolo, ma anche per la capacità di apprendere e adattarsi alle esigenze degli utenti.

Le fotocamere, sempre più al centro dell’esperienza smartphone, sono state ulteriormente potenziate nei modelli Pixel 9 Pro e Pro XL. Con nuovi sensori principali da 50 MP, ultrawide da 48 MP e selfie da 42 MP, questi dispositivi promettono una qualità d’immagine superiore, confermando l’impegno di Google nel migliorare continuamente le prestazioni fotografiche dei propri telefoni. Questo si abbina perfettamente con le nuove funzionalità AI come il Magic Editor e Pixel Studio, che portano l’editing fotografico a un livello successivo, sfumando sempre di più il confine tra realtà e creazione digitale.

Un’altra novità interessante è rappresentata dall’aumento della memoria RAM, con 16 GB disponibili di serie su tutti i modelli tranne il Pixel 9 base. Questa scelta è dettata dalla necessità di supportare le sofisticate funzionalità AI, che richiedono maggiori risorse per funzionare al meglio. L’introduzione di più memoria non è solo un miglioramento tecnico, ma un elemento fondamentale per sfruttare appieno le potenzialità del nuovo software basato su AI.

Il software, tuttavia, rimane il vero protagonista della nuova linea Pixel 9. La transizione da Google Assistant a Gemini è stata una mossa strategica che sottolinea quanto Google stia investendo nell’intelligenza artificiale come futuro dei suoi prodotti. Gemini non è solo un assistente virtuale, ma un’intera suite di strumenti che, sfruttando l’intelligenza artificiale, trasformano il modo in cui gli utenti interagiscono con i loro dispositivi. L’integrazione di informazioni personali come preferenze, contatti, calendario e messaggi consente a Gemini di offrire un supporto altamente personalizzato, che si adatta continuamente alle esigenze e alle abitudini dell’utente.

Gemini si presenta in diverse forme, ognuna delle quali progettata per offrire esperienze d’uso differenti, ma complementari. La versione standard di Gemini, ad esempio, utilizza il modello Gemini Nano per fornire funzionalità basate sull’intelligenza artificiale direttamente sul dispositivo, permettendo agli utenti di accedere rapidamente a informazioni e strumenti in modo efficiente e personalizzato. Gemini Nano alimenta anche le nuove app Pixel Weather e Pixel Screenshots, che estendono ulteriormente le capacità dello smartphone, consentendo di tracciare e richiamare manualmente attività e informazioni visualizzate sullo schermo.

Un’altra funzione chiave è Gemini Live, un assistente vocale avanzato che permette di avere conversazioni vocali naturali e fluide. Sebbene attualmente funzioni solo tramite cloud, richiedendo un abbonamento a Gemini Advanced, l’esperienza offerta è impressionante. Gemini Live, con le sue dieci voci diverse, è in grado di rispondere con rapidità e intelligenza, avvicinandosi sempre di più alla sensazione di parlare con una persona reale. Sebbene al momento non sia in grado di accedere alle informazioni personali memorizzate sui dispositivi, l’integrazione di queste capacità con quelle offerte dalla versione standard di Gemini è chiaramente la direzione verso cui Google si sta dirigendo, promettendo un futuro in cui l’assistenza AI sarà ancora più potente e personalizzata.

L’introduzione dei nuovi Pixel Buds 2 ha portato l’interazione con Gemini Live a un livello successivo. Con un semplice tocco sugli auricolari, gli utenti possono avviare conversazioni con l’assistente AI senza dover utilizzare il telefono, rendendo l’esperienza più naturale e comoda. Questa innovazione potrebbe cambiare radicalmente il modo in cui interagiamo con gli assistenti vocali, spostando l’interazione dal dispositivo visivo a un’interfaccia completamente audio, che potrebbe risultare più intuitiva e meno invadente.

Oltre a Gemini, Google ha introdotto altre funzionalità software esclusive per i Pixel, come il Magic Editor, che potenzia ulteriormente le già avanzate capacità di editing fotografico di Google, e Pixel Studio, che sfrutta modelli di generazione di immagini basati sull’AI sia localmente sia tramite cloud. Queste innovazioni non solo migliorano l’esperienza fotografica, ma offrono agli utenti strumenti creativi di altissimo livello, rendendo sempre più difficile distinguere tra realtà e immagine digitale.

Una delle funzioni più originali è “Aggiungimi”, che permette di creare foto di gruppo unendo due immagini diverse utilizzando la realtà aumentata, senza dover chiedere a qualcun altro di scattare la foto. Questa funzionalità non è solo divertente, ma rappresenta un esempio perfetto di come l’intelligenza artificiale possa semplificare e migliorare le interazioni quotidiane con la tecnologia.

In conclusione, l’evento di lancio di Google ha dimostrato come l’intelligenza artificiale possa essere utilizzata per creare esperienze pratiche e tangibili, in grado di attrarre un pubblico vasto e variegato. In un’epoca in cui l’entusiasmo per l’AI si alterna a scetticismo, Google ha ribadito che l’impatto della generative AI non solo